온프레미스 환경에서 LLM을 구축하는 것은 시작일 뿐입니다.

AI를 활용한 스프레드시트 분석이 목적이라면, 모델 엔드포인트만으로는 부족합니다. 비즈니스 사용자는 내부 추론 서버에 가공되지 않은 JSON 데이터를 보내는 것을 원하지 않습니다. 그들이 원하는 것은 워크북을 업로드하고, 질문을 던져 신뢰할 수 있는 답변을 얻고, 차트를 생성하며, 그 수치들이 어디서 도출되었는지 명확히 파악하는 것입니다.

이를 위해서는 모델을 뒷받침하는 견고한 아키텍처가 필요합니다.

이 가이드는 온프레미스 AI 스프레드시트 시스템을 구성하는 주요 요소들을 설명합니다.

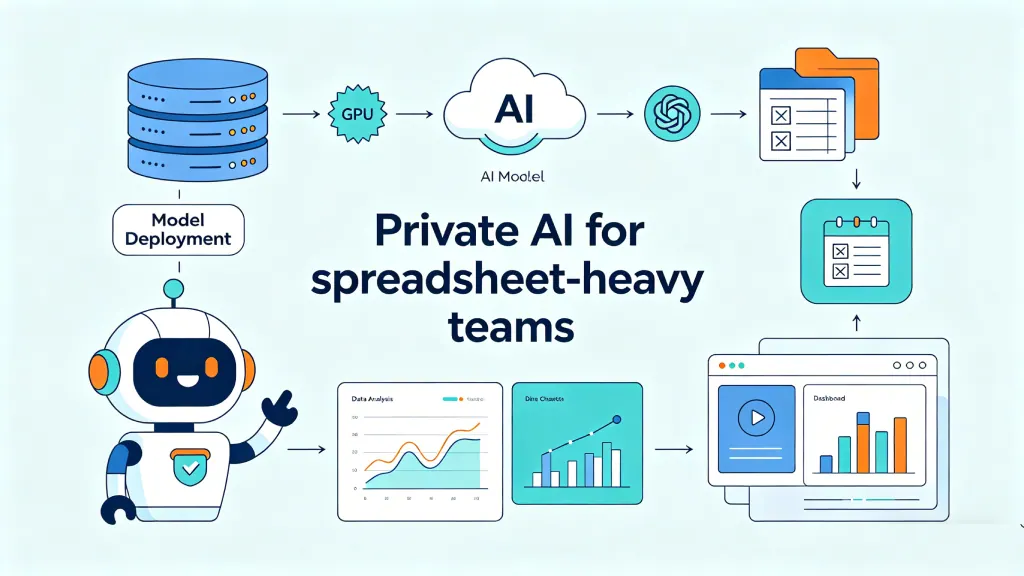

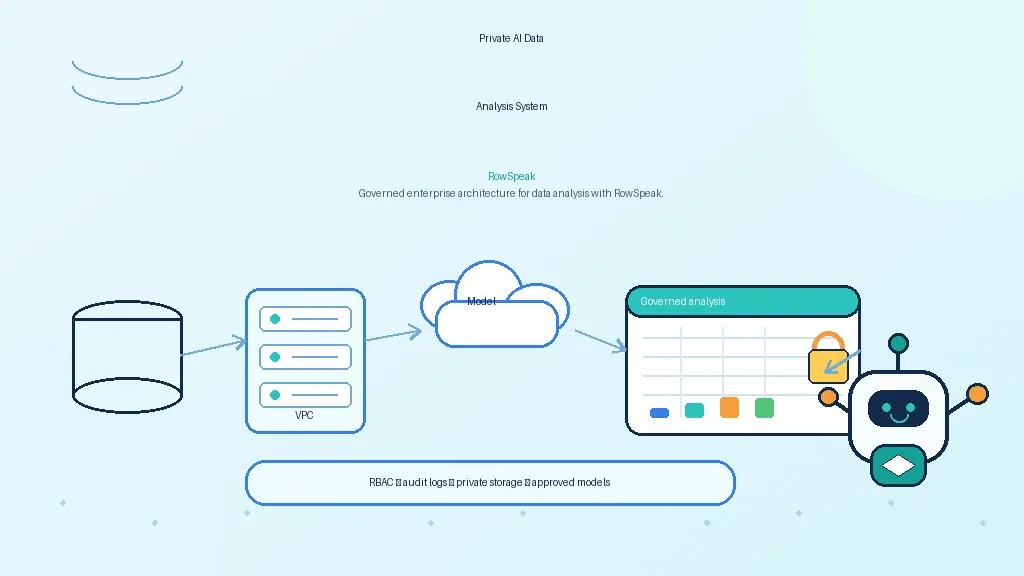

참조 아키텍처

실질적인 온프레미스 AI 스프레드시트 아키텍처는 다음과 같은 구조를 가집니다.

세부 순서는 다를 수 있지만 원칙은 동일합니다. LLM은 추론과 설명을 담당하고, 제어된 시스템이 데이터 액세스, 계산, 보안 및 감사 가능성을 처리해야 합니다.

ID 및 액세스 제어

시작은 ID 관리부터입니다.

모든 AI의 답변은 사용자, 워크스페이스, 파일 및 권한 결정과 연결되어야 합니다.

기업용 배포에는 일반적으로 다음 요소들이 필요합니다:

- SAML 또는 OIDC를 통한 SSO

- 역할 기반 액세스 제어 (RBAC)

- ID 제공업체(IdP)의 그룹 매핑

- 워크스페이스 수준의 권한

- 파일 수준의 권한

- 데이터셋 허용 리스트 (Allowlists)

- 관리자 제어 기능

시스템이 데이터베이스나 객체 스토리지에 연결될 때 기존 권한 체계를 우회해서는 안 됩니다. AI가 거버넌스를 무력화하는 지름길이 되어서는 안 되기 때문입니다.

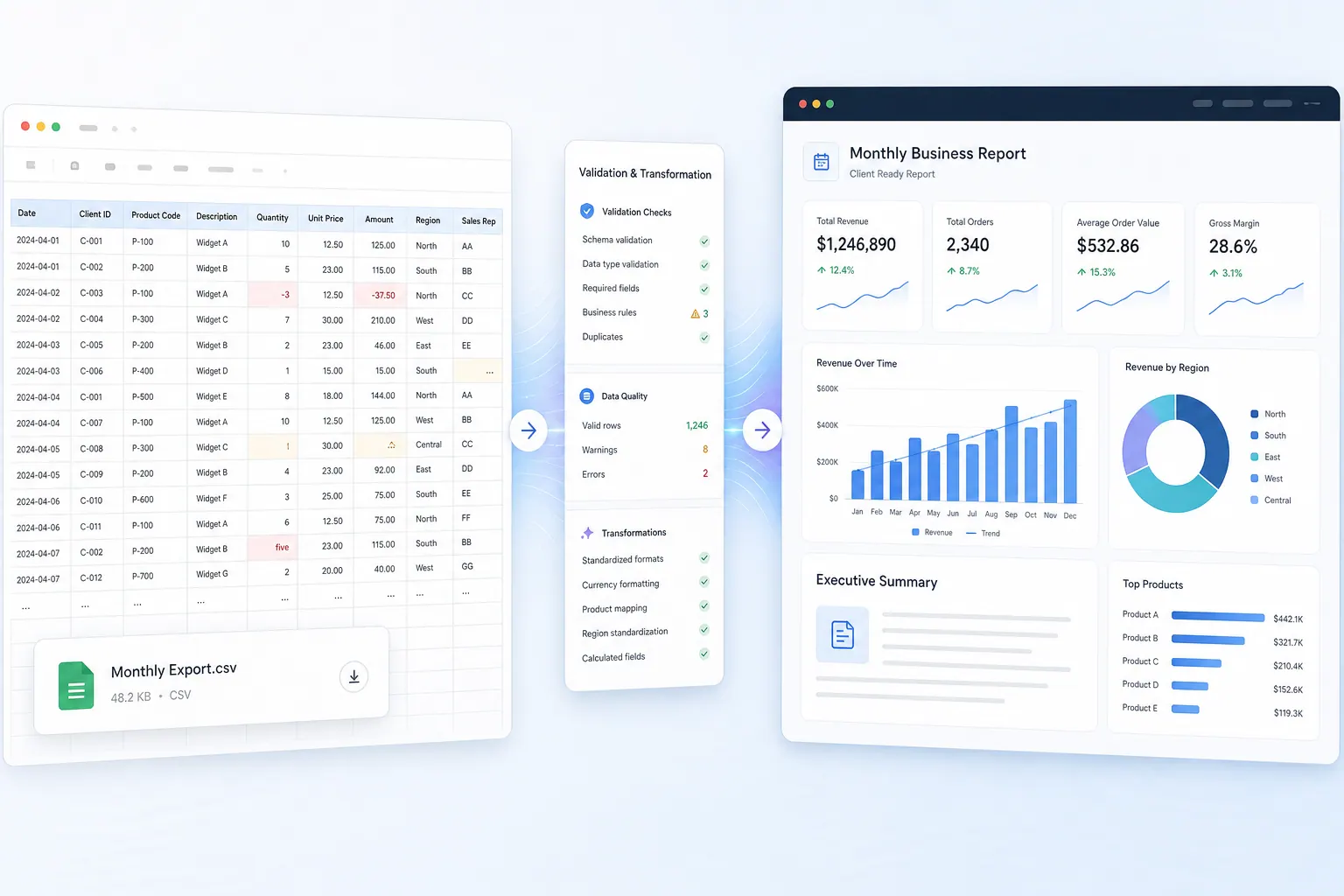

워크북 데이터 수집 (Ingestion)

스프레드시트 데이터를 수집하는 것은 보기보다 까다로운 작업입니다.

실제 워크북에는 다음과 같은 요소들이 포함될 수 있습니다:

- 다중 시트

- 숨겨진 시트

- 수식

- 병합된 셀

- 일관성 없는 헤더

- 이름이 지정된 범위

- 메모 및 댓글

- 의미가 담긴 서식

- 보호된 시트

- 차트 및 피벗 테이블

- 외부 링크

- 매크로

운영 시스템은 모델이 데이터를 왜곡해서 인식하지 않도록 이러한 구조를 충분히 파싱해야 합니다.

보안을 위해 매크로가 포함된 파일은 주의해서 다뤄야 합니다. 시스템이 코드를 실행해야 한다면 반드시 샌드박스 환경에서 수행해야 합니다. 많은 경우, 매크로는 실행하기보다 스캔 후 차단하거나 메타데이터로만 취급하는 것이 안전합니다.

스프레드시트의 이해

데이터 수집 후, 시스템은 워크북에 대한 유용한 표현(Representation)을 구축해야 합니다.

여기에는 다음 내용이 포함될 수 있습니다:

- 시트 요약

- 테이블 경계

- 컬럼명 및 추론된 데이터 타입

- 샘플 행

- 수식 의존성 맵

- 감지된 지표(Metrics)

- 날짜 범위

- 결측값

- 이상치

- 시트 또는 파일 간의 관계

모델은 이 정보를 가장 먼저 확인해야 합니다. 프롬프트에 워크북 전체를 넣는 것은 대개 리소스 낭비이며 보안상 위험합니다.

목표는 모델이 다음 단계를 계획할 수 있도록 충분한 컨텍스트를 제공하는 것이지, 파일 전체를 암기하게 하는 것이 아닙니다.

결정론적 계산 레이어 (Deterministic compute layer)

스프레드시트 AI에서 가장 중요한 구성 요소 중 하나입니다.

모델이 내부적으로 중요한 수치를 직접 계산하게 해서는 안 됩니다. 대신 도구(Tools)를 호출해야 합니다.

계산 레이어에는 다음이 포함될 수 있습니다:

- 스프레드시트 수식

- SQL

- DuckDB

- pandas

- Polars

- 데이터 웨어하우스 푸시다운 (Warehouse pushdown)

- 차트 생성

- 유효성 검사

예를 들어, 사용자가 매출 기준 상위 고객을 묻는다면 모델은 적절한 필드를 식별하고 쿼리를 생성합니다. 계산 레이어는 해당 쿼리를 실행하고, 모델은 그 결과값을 바탕으로 설명을 제공합니다.

이러한 분리를 통해 정확성, 속도 및 감사 가능성을 높일 수 있습니다.

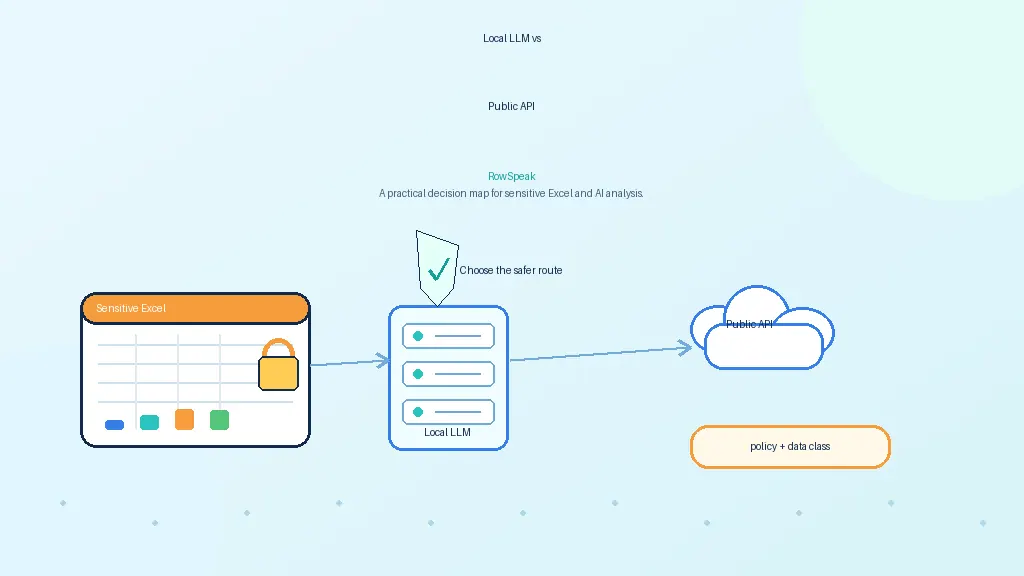

프라이빗 모델 서빙

모델 레이어는 여러 방식으로 서빙될 수 있습니다.

vLLM은 고성능 자체 호스팅 추론에 널리 사용되며 OpenAI 호환 서버를 제공합니다.

KServe는 쿠버네티스 네이티브 모델 서빙과 표준화된 추론 서비스가 필요한 조직에 적합합니다.

NVIDIA NIM은 NVIDIA 가속 인프라에 최적화된 추론 마이크로서비스를 제공합니다.

Ollama는 파일럿 프로젝트나 로컬 테스트에 유용하지만, 운영 환경에서는 더 강력한 확장성, 액세스 제어 및 관찰 가능성이 필요합니다.

모델 레이어는 다음과 같은 내부 인프라로 관리되어야 합니다:

- 인증 적용

- 버전 관리

- 모니터링 수행

- 네트워크 제어를 통한 격리

- 명확한 데이터 보존 정책 설정

- 모델 업그레이드 전 평가 수행

AI 오케스트레이션

오케스트레이션 레이어는 시스템이 모델과 도구를 어떻게 사용할지 결정합니다.

다음 업무를 담당합니다:

- 프롬프트 템플릿 관리

- 모델 선택

- 도구 선택

- 컨텍스트 구성

- 확인 질문 생성

- 쿼리 유효성 검사

- 코드 샌드박싱

- 재시도 로직

- 응답 형식 지정

이 레이어는 많은 보안 제어 기능이 위치하는 곳이기도 합니다.

예를 들어, 모델이 SQL을 생성하면 시스템은 해당 SQL이 읽기 전용인지, 허용된 테이블 범위 내에 있는지, 비용이 너무 많이 들지 않는지 검증해야 합니다. 모델이 Python 코드를 생성하면 명시적으로 허용되지 않는 한 네트워크 접속이 차단된 샌드박스에서 실행해야 합니다.

감사 가능성 (Auditability)

엔터프라이즈 환경에서 감사 로그는 필수입니다.

유용한 로그에는 다음 항목이 포함되어야 합니다:

- 사용자 정보

- 타임스탬프

- 액세스한 워크북 또는 데이터셋

- 입력된 프롬프트

- 모델 이름 및 버전

- 생성된 쿼리, 수식 또는 코드

- 도구 출력값

- 최종 답변

- 권한 결정 내역

- 오류 및 폴백(Fallback) 발생 상황

모든 민감한 데이터를 영구히 저장해야 한다는 뜻은 아닙니다. 보존 기간은 설정 가능해야 하지만, 검토, 디버깅 및 컴플라이언스 준수를 위해 충분한 추적성을 확보해야 합니다.

관찰 가능성 (Observability)

기술 팀은 인프라와 답변의 품질을 모두 모니터링해야 합니다.

인프라 지표:

- 지연 시간 (Latency)

- GPU 사용률

- 큐 깊이 (Queue depth)

- 토큰 사용량

- 모델 오류

- 도구 실행 시간

- 스토리지 사용량

품질 지표:

- 답변의 정확성

- 인용(Citation) 품질

- 수식 유효성

- 쿼리 성공률

- 사용자 수정 사항

- 환각(Hallucination) 보고

- 확인 질문 실패 사례

관찰 가능성이 확보되지 않으면, AI 분석가가 성능이 개선되고 있는지 아니면 조용히 신뢰할 수 없는 결과물을 내놓고 있는지 알 수 없습니다.

흔한 실수들

모델을 스프레드시트 엔진으로 취급하는 것

이는 수치 환각과 불안정한 답변으로 이어집니다. 계산에는 반드시 도구를 사용하세요.

먼저 데이터를 가져오고 나중에 필터링하는 것

컨텍스트가 모델에 전달되기 전에 권한 제어가 먼저 이루어져야 합니다.

워크북의 복잡성을 간과하는 것

단순한 CSV 데모가 실제 엑셀 파일을 처리할 수 있다는 증거는 되지 않습니다.

너무 많은 민감 데이터를 로깅하는 것

감사 가능성도 중요하지만, 로그 역시 데이터 보존 및 개인정보 보호 규칙을 따라야 합니다.

특정 모델에 종속되게 구축하는 것

모델은 빠르게 변합니다. 모델을 쉽게 교체할 수 있도록 워크플로를 설계하세요.

단계별 도입 계획

현실적인 도입은 단계를 거쳐 이루어집니다.

- 샘플 또는 비식별화된 스프레드시트로 프로토타입 제작.

- 일반적인 분석 작업 및 실패 사례 검증.

- 모든 수치 작업을 위한 결정론적 계산 레이어 추가.

- 실제 파일 사용 전 ID 및 권한 체계 연결.

- vLLM, KServe, NIM 등을 통한 프라이빗 모델 엔드포인트 배포.

- 감사 로그 및 모니터링 추가.

- 재무, 운영, 영업 보고 등 한 개 팀과 파일럿 실시.

- 확장 전 기정의된 정답과 비교하여 출력값 평가.

이렇게 하면 거버넌스 레이어가 갖춰지기 전에 모델 데모를 성급히 운영 시스템으로 전환하는 실수를 방지할 수 있습니다.

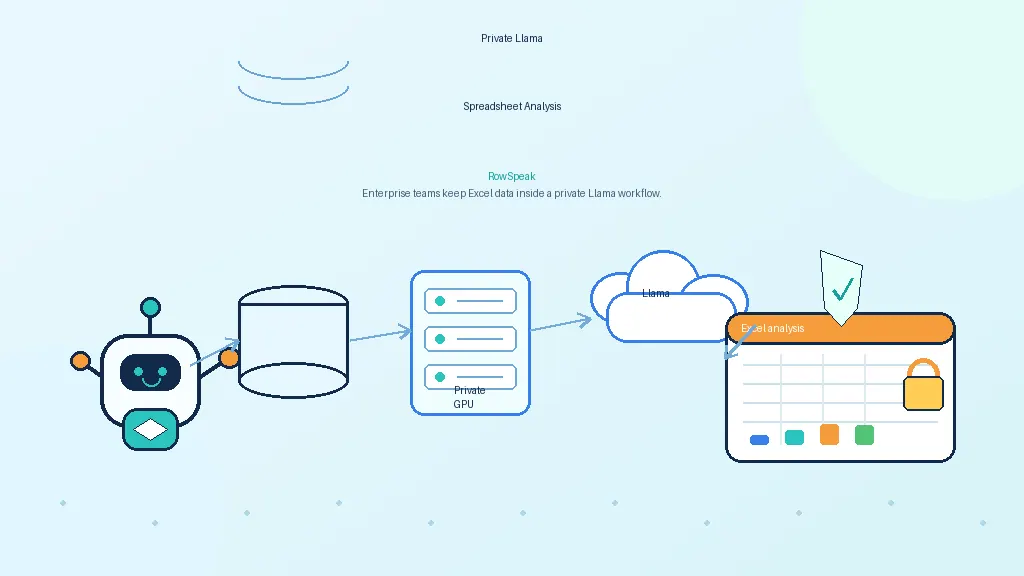

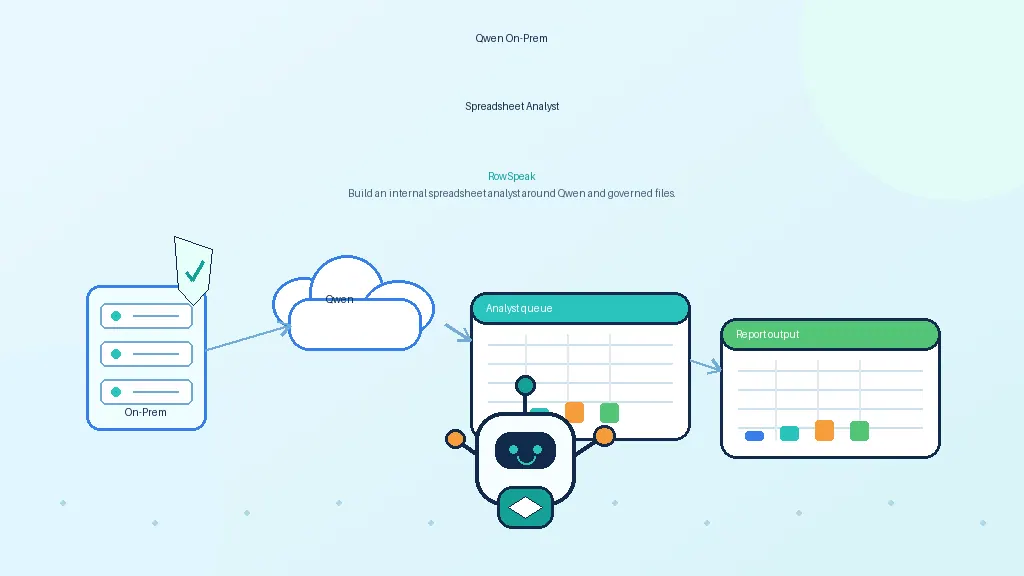

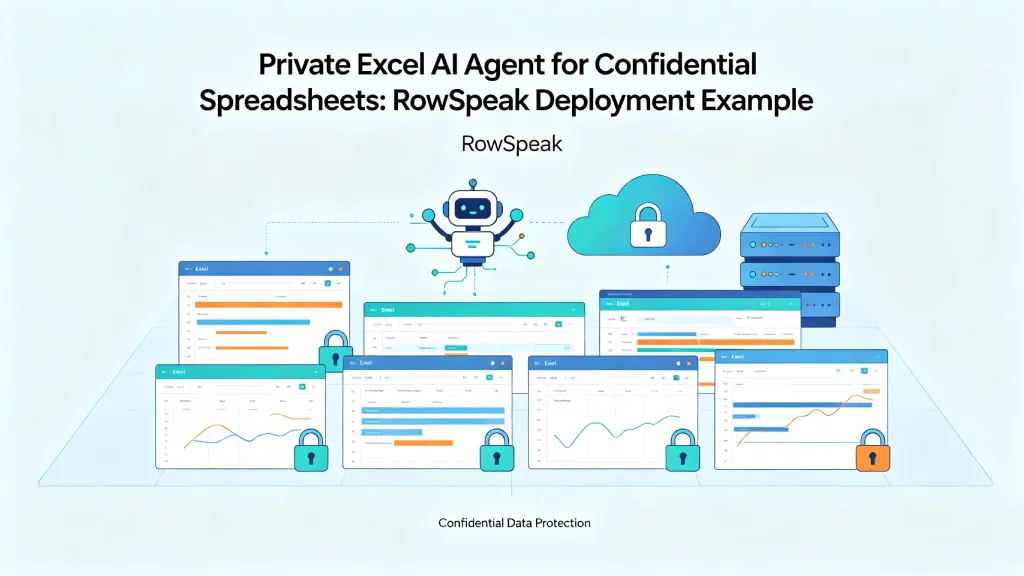

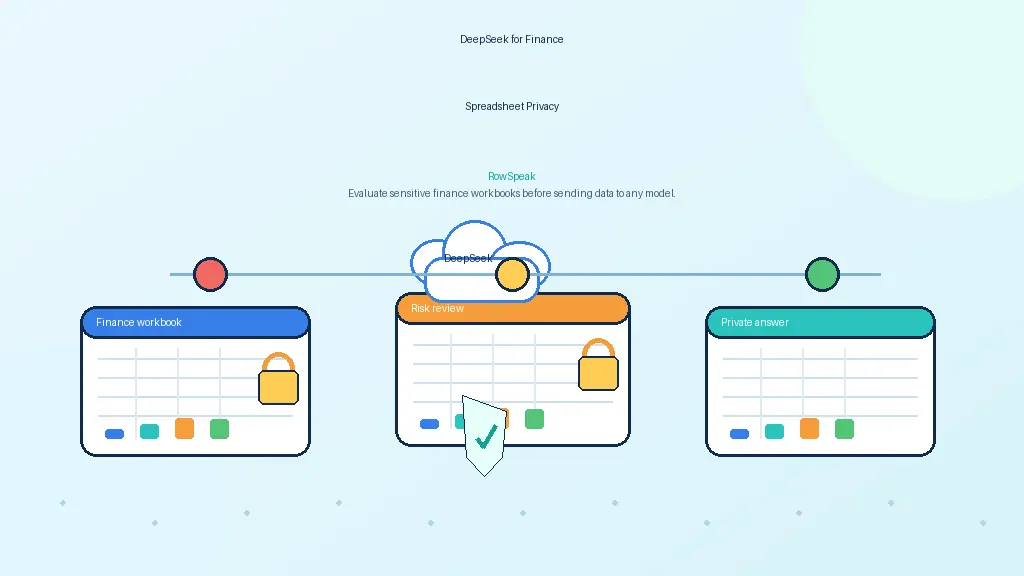

RowSpeak의 역할

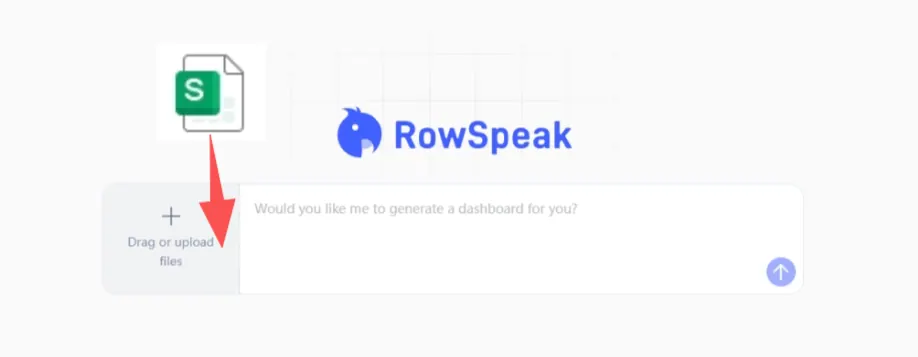

RowSpeak는 프라이빗 모델 엔드포인트와 통제된 데이터 실행 환경 위에서 워크플로 레이어 역할을 수행합니다.

모델 서버가 추론을 제공한다면, RowSpeak는 워크북 업로드, 자연어 질문, 차트, 요약, 보고서 및 주간 영업 보고와 같은 사용자 중심의 분석 흐름 등 스프레드시트 경험을 제공합니다.

온프레미스 배포에서 이러한 역할 분리는 매우 가치가 있습니다. IT 부서는 모델과 인프라를 제어하고, 비즈니스 사용자는 AI 대시보드나 재무 보고서 등 결과물이 무엇이든 API 호출이 아닌 스프레드시트 분석에 최적화된 인터페이스를 통해 작업할 수 있습니다.

마치며

온프레미스 LLM 엔드포인트는 인프라입니다. 반면 온프레미스 AI 스프레드시트 분석가는 제품 경험과 거버넌스의 결합체입니다.

모델 자체도 중요하지만, 시스템의 신뢰성을 결정하는 것은 모델을 둘러싼 아키텍처입니다. 특정 모델에 대한 사례는 RowSpeak를 위한 DeepSeek 자체 호스팅 가이드를 참조하세요.

출처 및 추가 자료

- vLLM OpenAI 호환 서버: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- KServe: https://kserve.github.io/website/

- NVIDIA NIM: https://www.nvidia.com/en-us/ai-data-science/products/nim-microservices/

- Ollama 라이브러리: https://ollama.com/library

- llama.cpp: https://github.com/ggml-org/llama.cpp