O debate sobre LLMs locais e APIs de IA públicas é, muitas vezes, simplista demais.

Um lado defende que toda empresa deveria rodar modelos localmente. O outro afirma que as APIs de IA corporativas são seguras o suficiente e muito mais fáceis de operar.

Para dados sensíveis de Excel, a resposta correta é mais prática: alinhe a arquitetura à sensibilidade da planilha, à maturidade dos seus processos de segurança e ao fluxo de trabalho que seus usuários realmente precisam.

Uma API pública, um serviço de IA corporativo, um modelo local, uma implantação em VPC privada e um fluxo de trabalho com descaracterização (redaction) podem todos estar corretos em diferentes situações.

Por que os dados do Excel precisam de cuidado especial

É fácil subestimar as planilhas.

Elas geralmente contêm dados que nunca chegaram a um sistema de BI governado:

- receita por cliente

- salários e comissões

- previsões (forecasts)

- orçamentos

- números de relatórios para a diretoria

- termos de fornecedores

- exportações de suporte

- registros fiscais

- exceções operacionais

- informações de identificação pessoal (PII)

Quando um funcionário faz o upload desse arquivo em um chatbot, a empresa pode perder o controle sobre o destino dos dados, por quanto tempo são retidos, quem pode acessá-los e se a ação está em conformidade com as políticas internas.

O risco não é apenas técnico; é processual. A maioria dos uploads de planilhas ocorre fora do caminho normal de governança de dados.

As cinco principais opções

1. Chatbot público

Este é o caminho mais fácil. Um usuário abre um chatbot, faz o upload de um arquivo e solicita uma análise.

Pode ser aceitável para dados públicos ou sintéticos. No entanto, é arriscado para arquivos confidenciais, a menos que a organização tenha aprovado explicitamente essa ferramenta e o caso de uso.

O principal benefício é a velocidade. O principal risco é a exposição descontrolada de dados.

2. API pública

Uma API pública oferece aos desenvolvedores mais controle do que um chatbot voltado ao consumidor. Eles podem construir um aplicativo interno, limitar o que é enviado e gerenciar os prompts com mais cuidado.

Mas os dados ainda saem do ambiente da empresa. Os termos de uso de dados, retenção, log e conformidade do fornecedor são cruciais aqui.

Para muitas empresas, isso pode funcionar após uma revisão do fornecedor e com o contrato adequado. Não deve ser tratado como automaticamente seguro.

3. Serviço de IA corporativo

Plataformas de IA corporativas geralmente oferecem compromissos de privacidade mais robustos, controles administrativos, criptografia, garantias de não treinamento com seus dados, opções de retenção e documentação de conformidade.

Exemplos incluem ofertas corporativas da OpenAI, Microsoft Azure OpenAI, AWS Bedrock, Google Vertex AI, Anthropic, entre outros.

Este costuma ser o melhor caminho intermediário para empresas que desejam alta qualidade de modelos sem operar sua própria infraestrutura de GPU.

A desvantagem é que o processamento ainda ocorre fora dos servidores da empresa, mesmo que sob controles corporativos rigorosos.

4. LLM Local

Um LLM local roda em um notebook, estação de trabalho, servidor ou cluster de GPU interno.

A principal vantagem é o controle. Os dados permanecem dentro da máquina ou da rede. Isso pode ser útil para protótipos, experimentos sensíveis à privacidade ou casos de uso offline.

As desvantagens são reais:

- a qualidade do modelo pode ser inferior às APIs de ponta

- a configuração pode ser instável

- GPUs podem ser caras

- o monitoramento é limitado, a menos que você o desenvolva

- o controle de acesso e os logs de auditoria são de sua responsabilidade

- "local" não significa automaticamente "em conformidade" (compliant)

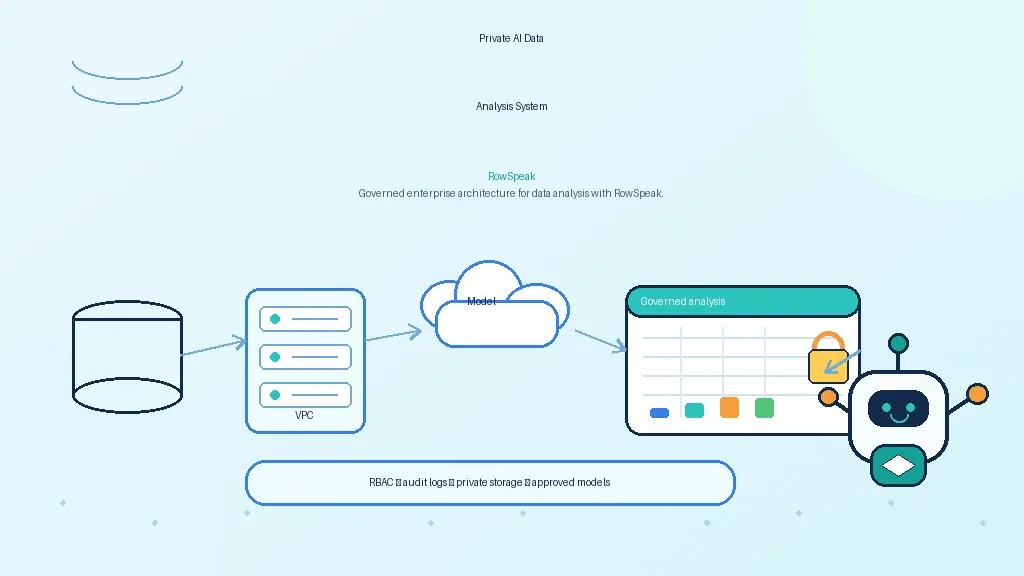

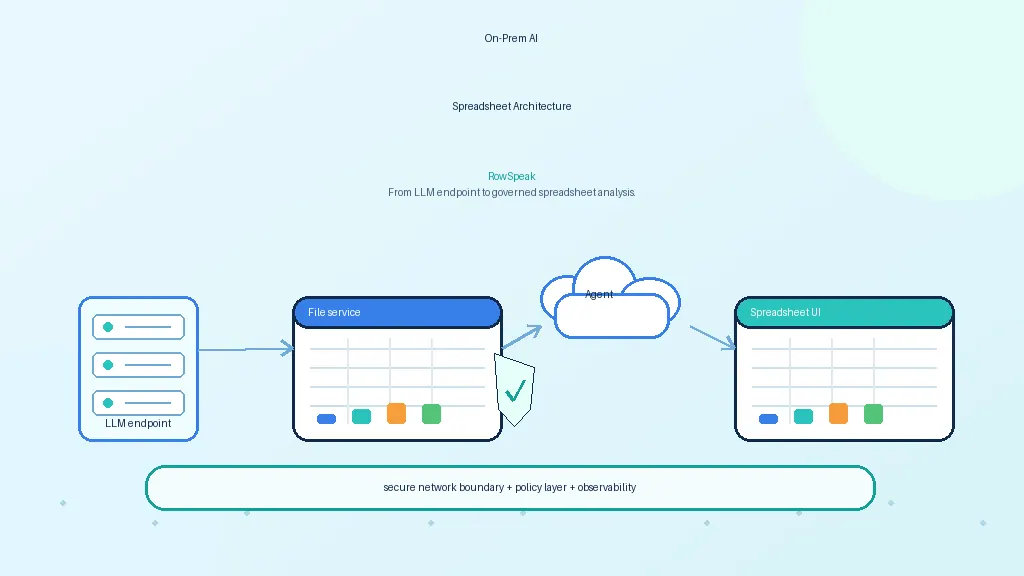

5. VPC privada ou implantação on-premise

Esta é a versão corporativa da IA local.

O modelo roda em um ambiente controlado, geralmente com políticas de identidade, rede, logs, armazenamento e segurança ao seu redor. A equipe pode expor uma API interna e conectá-la a aplicativos aprovados.

Este é o caminho mais robusto para fluxos de trabalho com planilhas altamente sensíveis, mas exige maturidade operacional.

Um framework prático de decisão

Use a sensibilidade dos dados como o primeiro filtro.

| Tipo de planilha | Caminho de IA razoável |

|---|---|

| Dados públicos ou exemplos | Chatbot público ou API |

| Dados internos de baixo risco | Serviço de IA corporativo aprovado |

| Dados de negócios confidenciais | API corporativa com controles contratuais, VPC privada ou app interno aprovado |

| Dados regulamentados ou altamente sensíveis | VPC privada, on-premise, ambiente isolado (air-gapped) ou fluxo com descaracterização |

| Sensibilidade desconhecida | Não faça upload até que seja classificado |

Em seguida, faça uma pergunta operacional: quem manterá o sistema?

Se a empresa não tem capacidade para operar GPUs, aplicar patches em servidores de modelos, monitorar logs e avaliar saídas, uma implantação totalmente local pode criar um novo risco. Nesse caso, um serviço de IA corporativo com controles fortes pode ser mais seguro do que um modelo local não gerenciado.

Local não significa automaticamente seguro

Um modelo local ainda pode vazar ou manipular dados incorretamente se o sistema ao redor for fraco.

Erros comuns incluem:

- armazenar arquivos enviados em pastas não criptografadas

- registrar logs de prompts com valores sensíveis

- dar a todos os usuários acesso a todos os arquivos

- permitir que o código gerado acesse a rede

- falhar na atualização (patch) da máquina hospedeira

- copiar resultados para ferramentas não gerenciadas

- usar modelos ou pacotes de fontes não confiáveis

A privacidade é uma propriedade da arquitetura, não apenas da localização do modelo.

API pública não significa automaticamente inseguro

O oposto também é verdadeiro.

APIs de IA corporativas podem fornecer controles rigorosos. Alguns provedores declaram que os dados de clientes empresariais ou de API não são usados para treinar modelos por padrão. Provedores de nuvem podem oferecer redes privadas, IAM, criptografia, logs de auditoria e controles de retenção de dados.

A pergunta correta deve ser específica:

- Qual plano de produto?

- Qual contrato?

- Qual configuração de retenção?

- Qual região?

- Quais logs?

- Quais usuários?

- Quais dados da planilha?

Uma API pública com controles corporativos pode ser aceitável para muitos fluxos de trabalho. Um upload em um chatbot aleatório pode não ser.

Como é um fluxo de trabalho ideal para Excel sensível

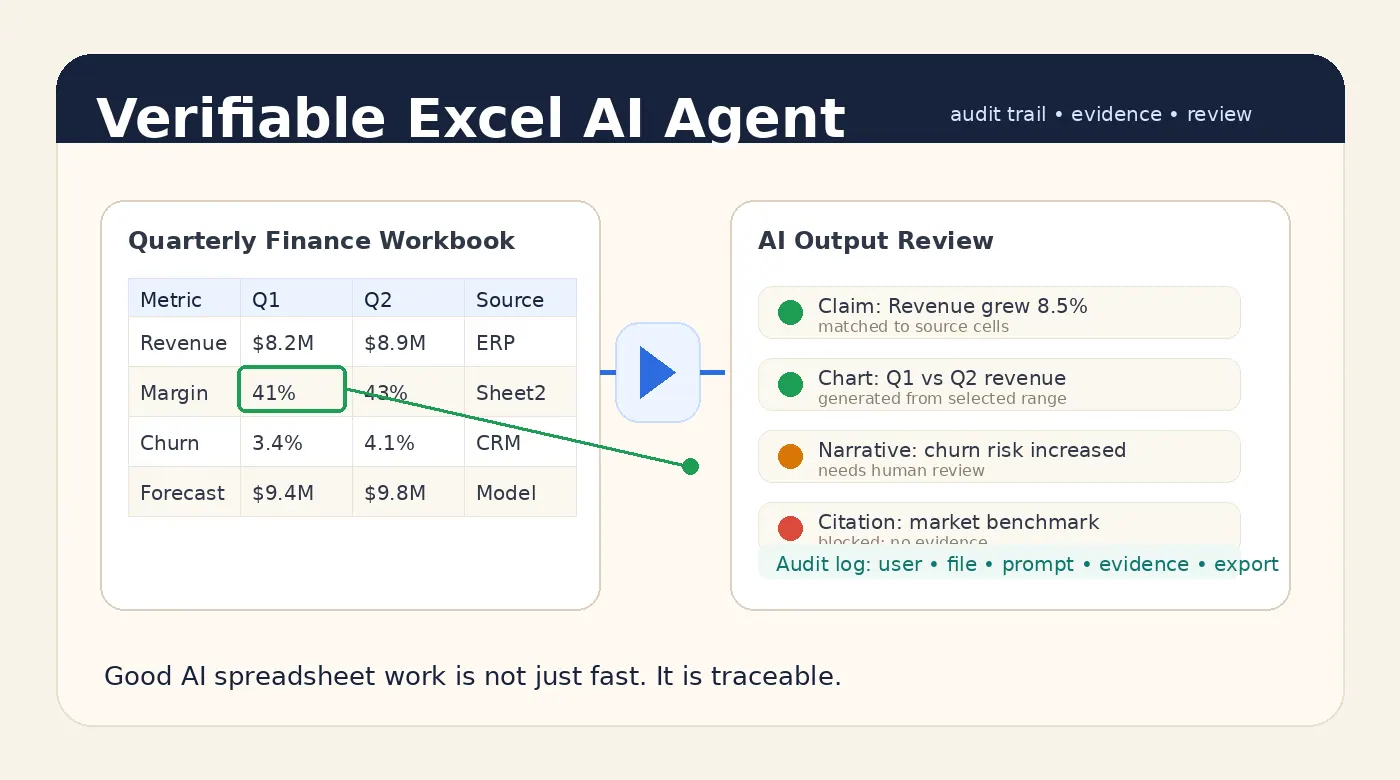

Para análise de planilhas sensíveis, um bom fluxo de trabalho deve:

- classificar os dados antes da análise

- manter os arquivos em armazenamento aprovado

- aplicar permissões de usuário

- usar ferramentas determinísticas para cálculos

- enviar apenas o contexto necessário para o modelo

- evitar vazamentos externos das ferramentas

- citar linhas, abas, fórmulas ou consultas de origem

- registrar logs de prompts, ferramentas, acesso a dados e saídas

- permitir que administradores controlem a retenção

- suportar endpoints de modelos privados ou aprovados pela empresa

Isso oferece às equipes um equilíbrio prático: a utilidade da IA sem o comportamento descontrolado de copiar e colar.

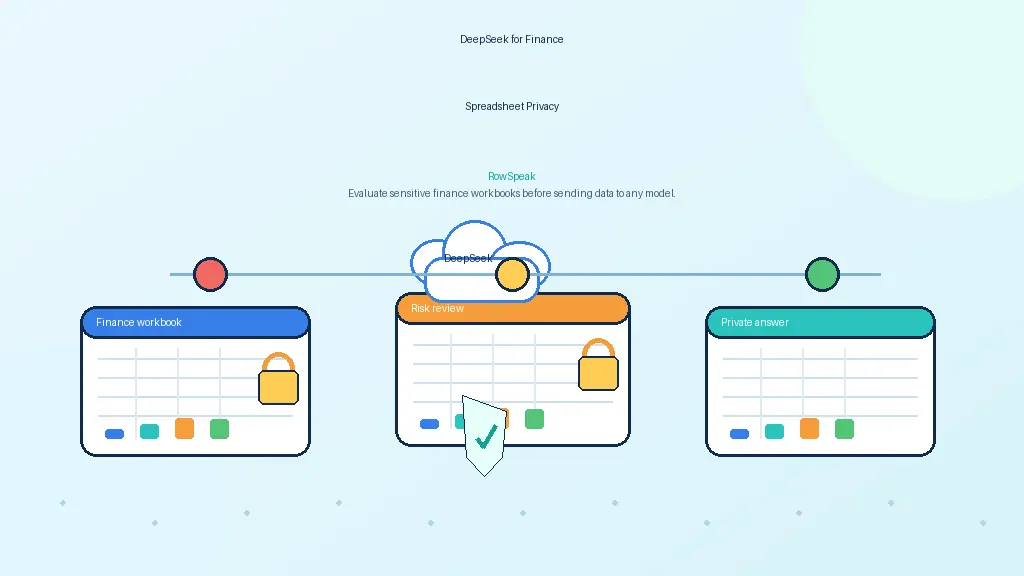

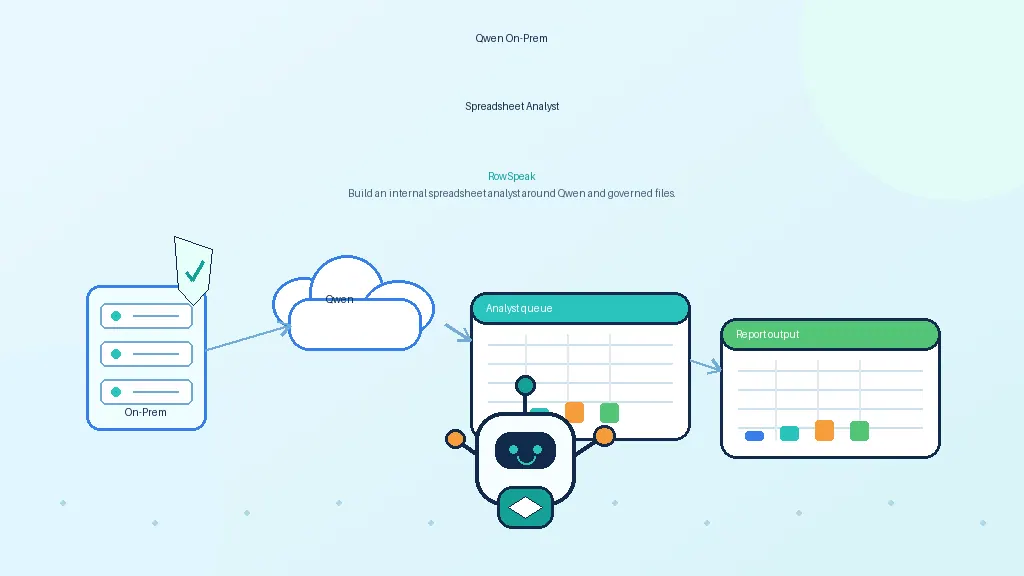

Onde o RowSpeak se encaixa

O RowSpeak é uma camada de fluxo de trabalho para análise de planilhas. Isso significa que ele pode operar sobre diferentes escolhas de modelos.

Para uma equipe de baixo risco, o endpoint do modelo pode ser uma API corporativa aprovada. Para uma implantação sensível, pode ser um LLM privado rodando na infraestrutura do cliente. Em ambos os casos, a experiência do usuário permanece focada na tarefa da planilha: carregar dados, fazer perguntas, gerar gráficos, revisar evidências e transformar arquivos Excel em dashboards com um fluxo de trabalho de Excel para dashboard.

O modelo é substituível. O fluxo de trabalho governado é a parte duradoura. É por isso que essa decisão geralmente deve acompanhar um planejamento de business intelligence com IA mais amplo, e não apenas a seleção do modelo.

Checklist final

Antes de escolher entre LLM local ou API pública para análise de Excel, responda a estas perguntas:

- Qual é o campo mais sensível na pasta de trabalho?

- A ferramenta é aprovada para essa classe de dados?

- O fornecedor treina modelos com prompts, arquivos ou saídas?

- Onde os dados são processados e retidos?

- Você pode usar amostras descaracterizadas em vez dos dados reais?

- Os usuários precisam de permissões ao nível de linha ou de arquivo?

- Os cálculos são realizados de forma determinística?

- As respostas são auditáveis?

- Quem mantém o modelo e a infraestrutura?

- O que acontece quando o modelo erra?

A melhor arquitetura raramente é a mais ideológica. É aquela que oferece ajuda analítica real aos usuários, respeitando o nível de risco da planilha. Se a dúvida principal for a adequação do fornecedor, também pode ajudar comparar opções familiares como o Copilot no Excel com ferramentas de fluxo de trabalho privado.

Fontes e leitura adicional

- Privacidade corporativa da OpenAI: https://openai.com/enterprise-privacy/

- Perguntas frequentes do AWS Bedrock: https://aws.amazon.com/bedrock/faqs/

- Governança de dados / retenção zero de dados no Google Vertex AI: https://docs.cloud.google.com/vertex-ai/generative-ai/docs/vertex-ai-zero-data-retention

- Servidor vLLM compatível com OpenAI: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Biblioteca Ollama: https://ollama.com/library