O DeepSeek-V4-Flash agora é oficial, público e de pesos abertos (open-weight).

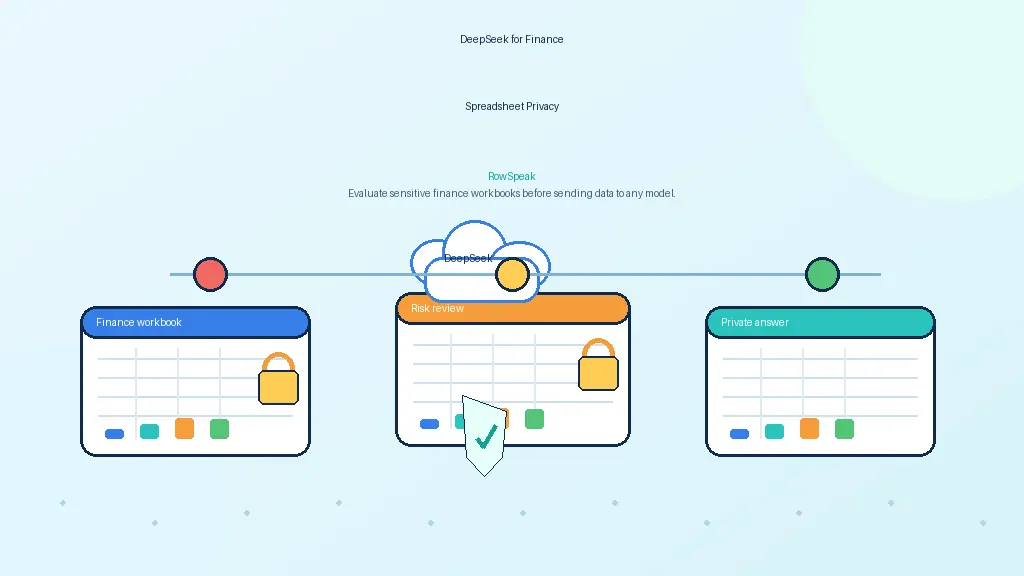

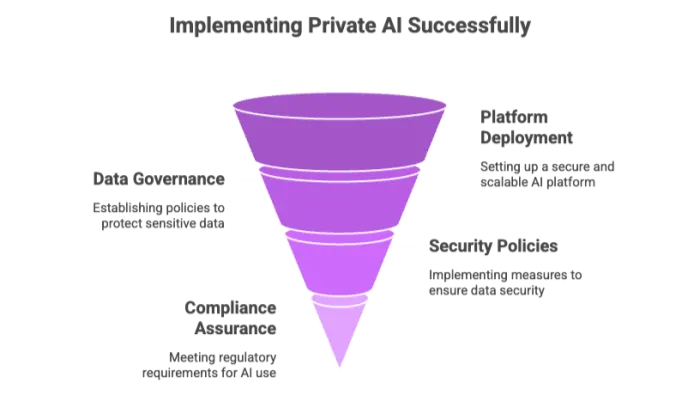

Isso é fundamental para um perfil muito específico de comprador: equipes que precisam de uma capacidade de IA robusta, mas não podem enviar dados sensíveis de planilhas para uma API externa.

Se você está avaliando IA privada para relatórios financeiros, planilhas operacionais, exportações internas ou análises recorrentes de dados, a questão não é mais apenas se um modelo como este pode rodar na sua própria infraestrutura. O verdadeiro desafio é transformá-lo em um serviço interno seguro que as pessoas realmente consigam utilizar.

Este artigo foi criado para ajudar justamente nisso.

Mais especificamente, ele detalha uma configuração prática de IA privada para análise interna de planilhas:

- Rodar o DeepSeek-V4-Flash em seu próprio servidor de GPU

- Expô-lo como uma API de inferência privada

- Validar se o endpoint funciona com prompts de estilo corporativo

- Conectá-lo a uma camada de fluxo de trabalho como o RowSpeak, para que usuários não técnicos possam analisar dados de planilhas sem lidar com chamadas brutas de modelo

Este não é um artigo sobre "conversar com um modelo". É sobre construir um servidor de IA privado capaz de suportar fluxos de trabalho reais com planilhas internas.

Por que as equipes buscam um servidor de IA privado para análise de planilhas

Quando se fala em auto-hospedagem, muitas vezes parece algo ideológico. Na realidade, a motivação costuma ser operacional e comercial.

Uma equipe financeira não quer planilhas de relatórios de diretoria passando por uma API pública se puder evitar, especialmente quando esses arquivos alimentam fluxos de trabalho de relatórios gerenciais. Uma equipe de operações não quer que rastreadores internos, exportações de receita e planilhas complexas saiam de seu ambiente apenas para realizar uma análise. E uma equipe de TI ou segurança geralmente quer algo ainda mais simples: um endpoint de modelo que eles possam controlar, monitorar, auditar e restringir como qualquer outro sistema interno.

É aí que o DeepSeek-V4-Flash se torna atraente.

O DeepSeek tornou-se rapidamente parte da conversa sobre IA privada porque as equipes agora o veem como uma base realista para implantações internas.

Ele é forte o suficiente para valer a implantação e aberto o suficiente para tornar viável um rollout de IA privada.

Se o seu caso de uso for um chat casual de consumidor, uma API hospedada ainda pode ser a escolha mais fácil.

Mas se a sua carga de trabalho real se parece mais com isto:

- Planilhas financeiras

- Relatórios semanais de vendas

- Tabelas de BI exportadas

- Dumps de CSV de sistemas internos

- Planilhas operacionais complexas que ainda orientam decisões importantes

então o caminho do servidor privado começa a parecer muito mais convincente.

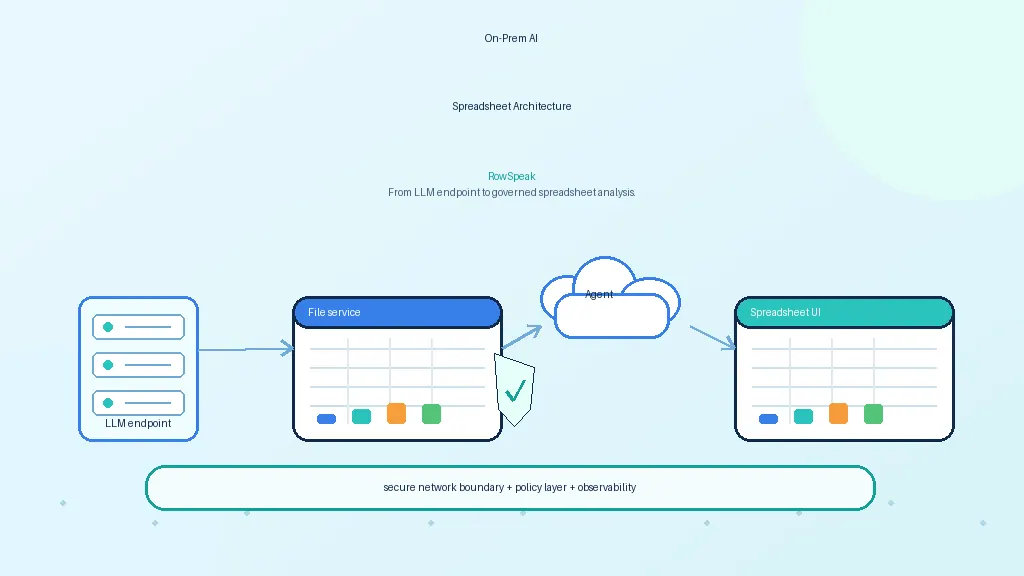

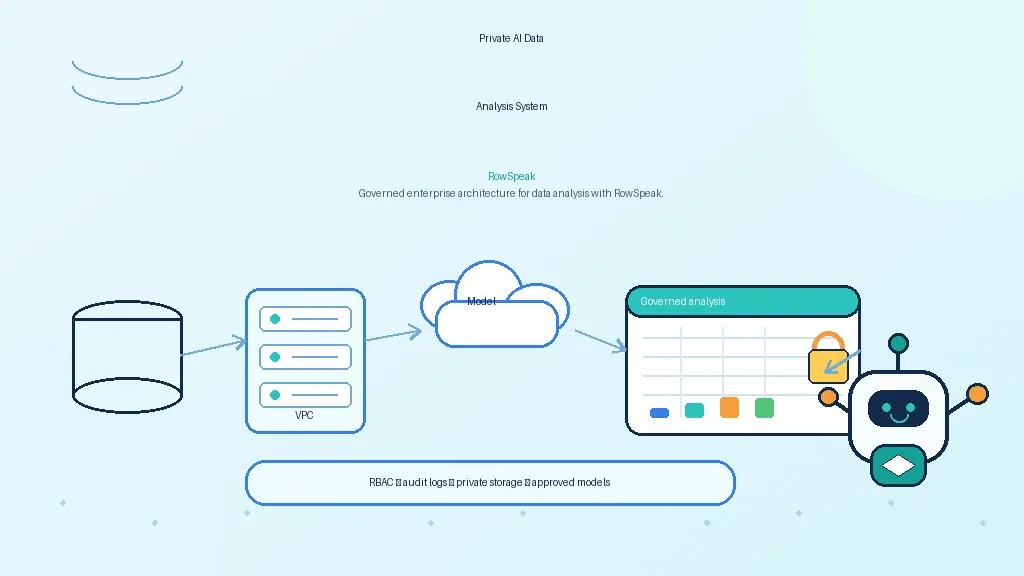

O que você está realmente construindo

A boa notícia é que a arquitetura em si é simples.

Você não precisa de uma plataforma de IA gigante para obter valor. Você precisa de quatro coisas:

- Um servidor de GPU sob seu controle

- Um runtime de modelo

- Um endpoint de API privado

- Uma camada de fluxo de trabalho sobre esse endpoint para os usuários finais

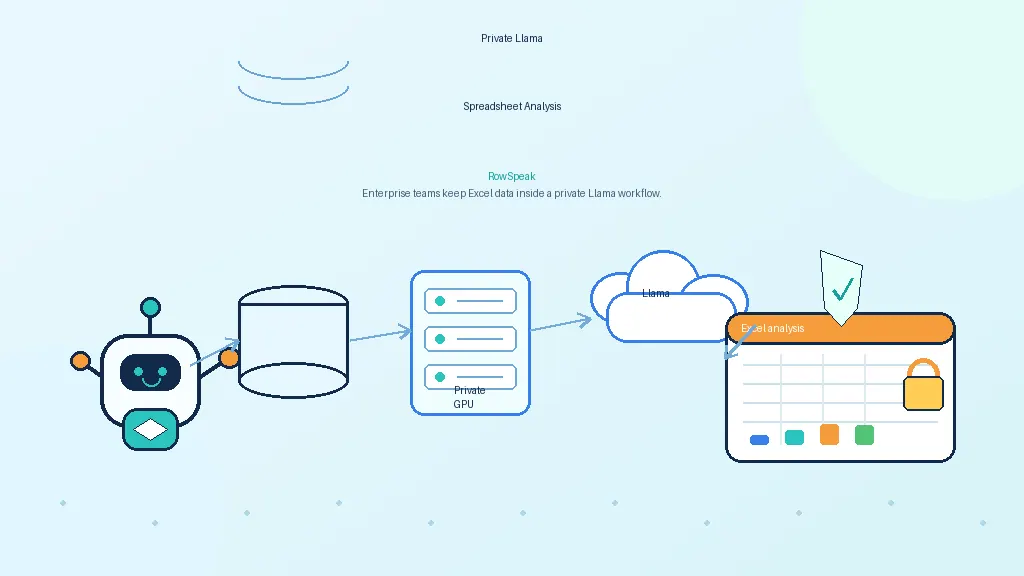

Nesta configuração:

- DeepSeek-V4-Flash é o modelo

- vLLM ou Ollama é a camada de serviço (serving)

- RowSpeak é a camada de fluxo de trabalho que transforma o acesso ao modelo em tarefas de análise de planilhas

Essa separação é importante porque mantém cada camada focada.

O servidor do modelo cuida da inferência. A camada de fluxo de trabalho lida com a realidade complexa do uso corporativo: upload de arquivos, contexto de planilha e perguntas em linguagem natural, resumos e saídas prontas para gráficos.

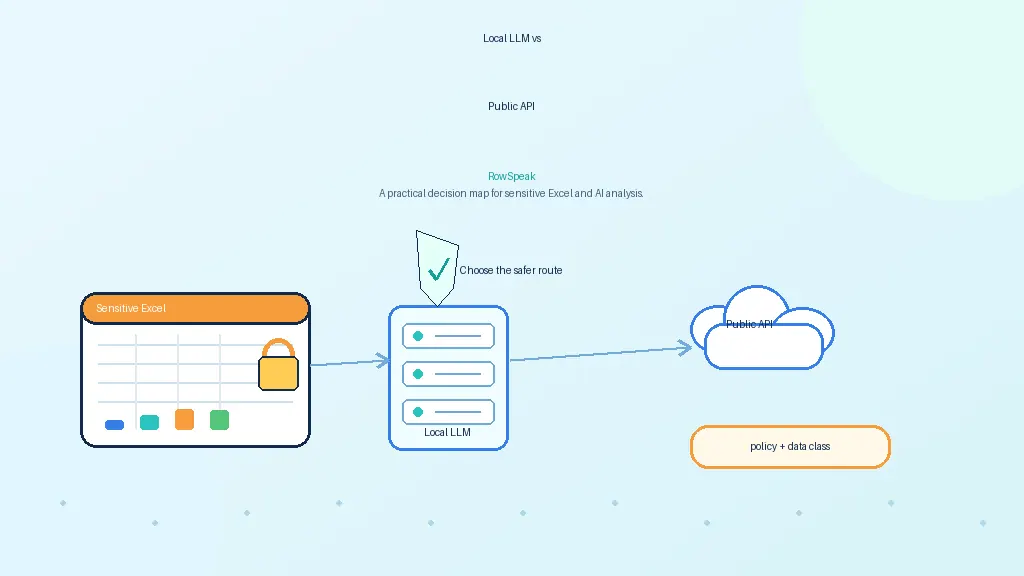

Qual rota de implantação faz mais sentido?

Existem duas rotas realistas, e a escolha certa depende do tipo de serviço interno que você pretende operar.

Opção 1: vLLM

Se você está construindo um endpoint de IA interno sério para uso comercial repetido, esta é a rota que eu recomendaria primeiro.

O motivo é direto: o vLLM é uma stack de serviço orientada para produção, e sua API compatível com OpenAI torna a integração mais limpa. Se o seu objetivo é colocar o DeepSeek-V4-Flash por trás de um fluxo de análise de planilhas, a compatibilidade da API e o controle de implantação importam muito.

Opção 2: Ollama

O Ollama é a opção mais conveniente quando o empacotamento do modelo e o suporte de runtime se alinham com o que você deseja implantar.

É mais fácil de colocar em funcionamento e, para cenários internos mais leves ou provas de conceito rápidas, pode ser uma escolha sensata.

Mas se eu tivesse que resumir a decisão em uma frase, seria esta:

Use vLLM quando quiser um servidor de IA privado com padrão de produção, e use Ollama quando a velocidade e a simplicidade forem mais importantes que o controle da infraestrutura.

Antes de começar: verifique o servidor, não apenas a ideia

O hardware exato necessário depende do artefato específico do DeepSeek-V4-Flash que você escolher, da precisão desejada, do comprimento do contexto e de quanta concorrência você espera.

É por isso que conselhos genéricos do tipo "você precisa de X GPUs" costumam ser enganosos.

A melhor abordagem é começar pelo artefato oficial do modelo e dimensionar a máquina em torno do que você planeja servir.

No mínimo, seu servidor deve ter:

- Linux sob seu controle

- GPUs NVIDIA

- Instalação de drivers saudável

- Um ambiente CUDA funcional

- Python instalado

- VRAM suficiente para o artefato do modelo escolhido

Antes de fazer qualquer outra coisa, execute um teste de sanidade:

nvidia-smi

python3 --version

Parece básico, mas vale a pena fazer. Um número surpreendente de problemas de implantação não são problemas do modelo. São problemas de driver, de ambiente ou simples erros de preparação da máquina.

Implantando com vLLM

Se você quer o caminho mais limpo para uma "implantação real", comece aqui.

Passo 1: Instale o vLLM em um ambiente limpo

python3 -m venv .venv

source .venv/bin/activate

pip install --upgrade pip

pip install vllm

Documentação útil:

Passo 2: Use o artefato oficial do DeepSeek

Este é um daqueles pontos onde um pequeno atalho pode gerar muita dor de cabeça depois.

Não comece por mirrors aleatórios se puder evitar. Comece pela página oficial de lançamentos do DeepSeek e siga a coleção oficial do Hugging Face linkada lá.

Isso garante uma trilha de procedência mais limpa e reduz as chances de implantar a versão errada.

Página oficial de lançamento do DeepSeek anunciando o V4-Flash como parte do lançamento do DeepSeek V4 Preview.

Passo 3: Inicie o servidor da API

Um lançamento típico do vLLM se parece com isto:

python -m vllm.entrypoints.openai.api_server --model deepseek-ai/DeepSeek-V4-Flash --host 0.0.0.0 --port 8000

Dependendo do artefato do modelo e da máquina, você também pode precisar ajustar:

- Paralelismo de tensores (tensor parallelism)

- dtype

- Comprimento máximo do modelo

- Utilização da memória da GPU

Mas a ideia básica permanece a mesma. Inicie o modelo, exponha o endpoint e certifique-se de que a camada de serviço esteja estável antes de tocar no lado da aplicação.

Passo 4: Teste o endpoint como uma API, não como uma demo

Antes de conectar o RowSpeak ou qualquer outra coisa, verifique se o servidor do modelo responde corretamente por conta própria.

Por exemplo:

curl http://YOUR_SERVER_IP:8000/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "deepseek-ai/DeepSeek-V4-Flash",

"messages": [

{"role": "user", "content": "Resuma os benefícios de auto-hospedar um LLM para análise de planilhas."}

]

}'

Se o servidor retornar uma resposta válida, você tem o caminho principal de serviço funcionando.

Neste ponto, resista à tentação de complicar demais o teste. Você ainda não está fazendo um benchmark de todo o sistema. Você está verificando se o endpoint está ativo, se o modelo carrega corretamente e se a API se comporta como o seu app espera.

Implantando com Ollama

O Ollama é o caminho mais leve e, quando o empacotamento se ajusta, pode ser a maneira mais rápida de colocar uma implantação utilizável para rodar.

O importante é não tratá-lo como uma resposta universal. É a opção certa quando a build exata do DeepSeek que você deseja está disponível em um formato que o Ollama possa servir de forma limpa.

Documentação oficial:

Instale-o primeiro:

curl -fsSL https://ollama.com/install.sh | sh

Em seguida, faça o pull ou registre o modelo no formato que sua configuração do Ollama suporta e teste-o diretamente antes de tentar integrá-lo em qualquer outro lugar.

Um teste local mínimo se parece com isto:

ollama run SEU_MODELO_DEEPSEEK

Se você estiver expondo-o através da API do Ollama, teste essa API diretamente primeiro.

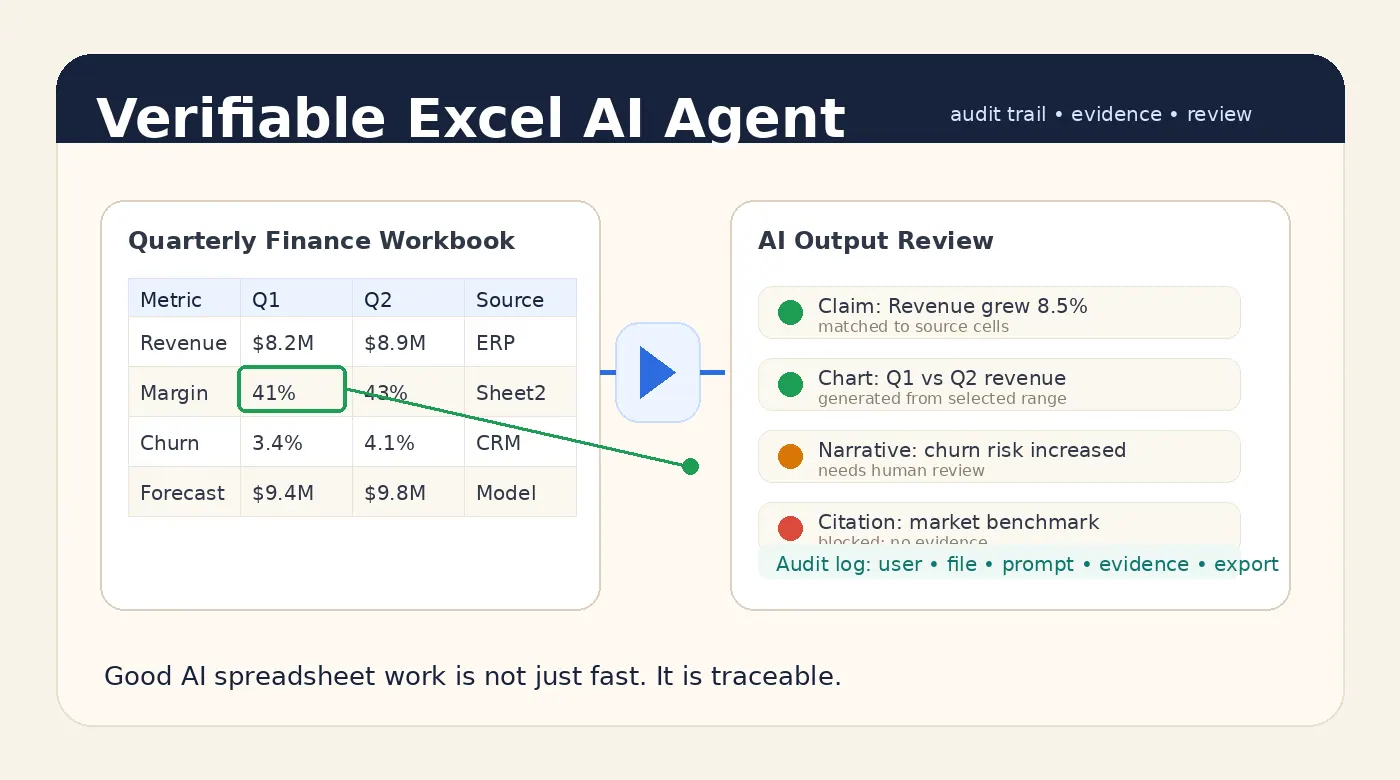

Teste com um prompt de negócios, não um prompt de brinquedo

Esta parte é fácil de subestimar.

Muitas implantações de IA privada são declaradas "funcionais" porque alguém pediu ao endpoint para dizer olá, resumir um parágrafo ou contar uma piada. Isso não diz quase nada sobre se o sistema é útil para o trabalho interno que realmente importa.

Se o seu objetivo é análise de planilhas, o teste mais inteligente é usar o tipo de prompt que suas equipes de finanças, operações ou relatórios de IA realmente usariam.

Por exemplo:

Tenho uma planilha de vendas semanal com colunas para região, representante, receita, unidades e margem.

Encontre as regiões com pior desempenho, identifique os representantes com margem em queda e recomende três gráficos para um resumo executivo.

Esse tipo de teste é muito mais revelador. Ele diz se o modelo está apenas "vivo" ou se ele pode suportar a análise interna de planilhas de uma forma que seja realmente útil para o negócio.

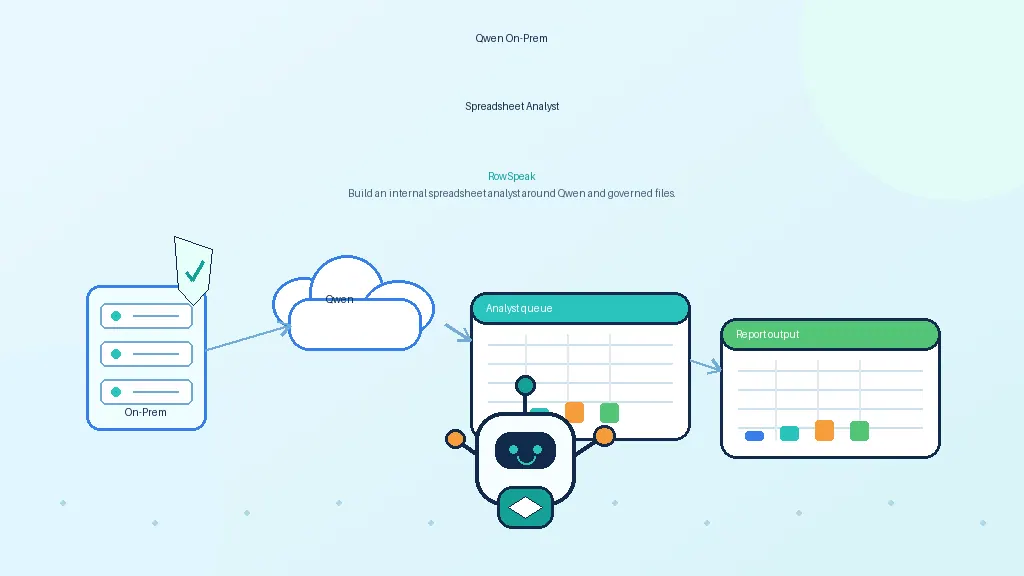

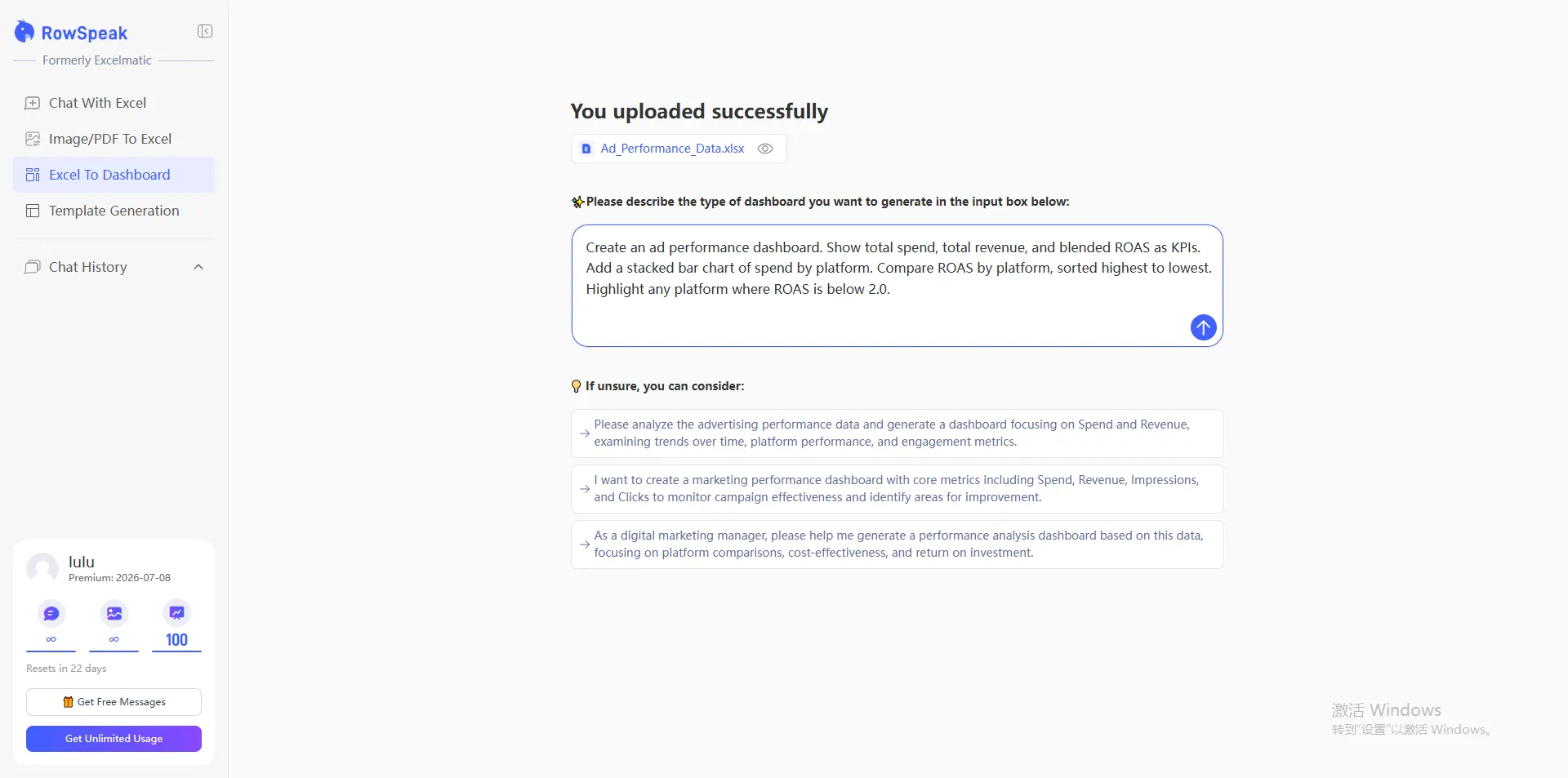

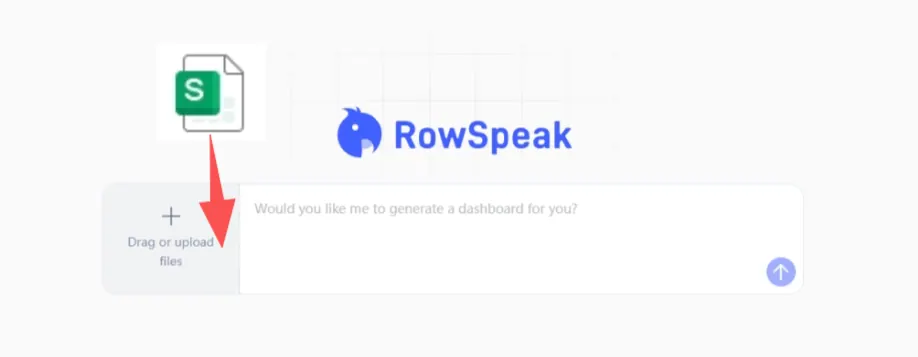

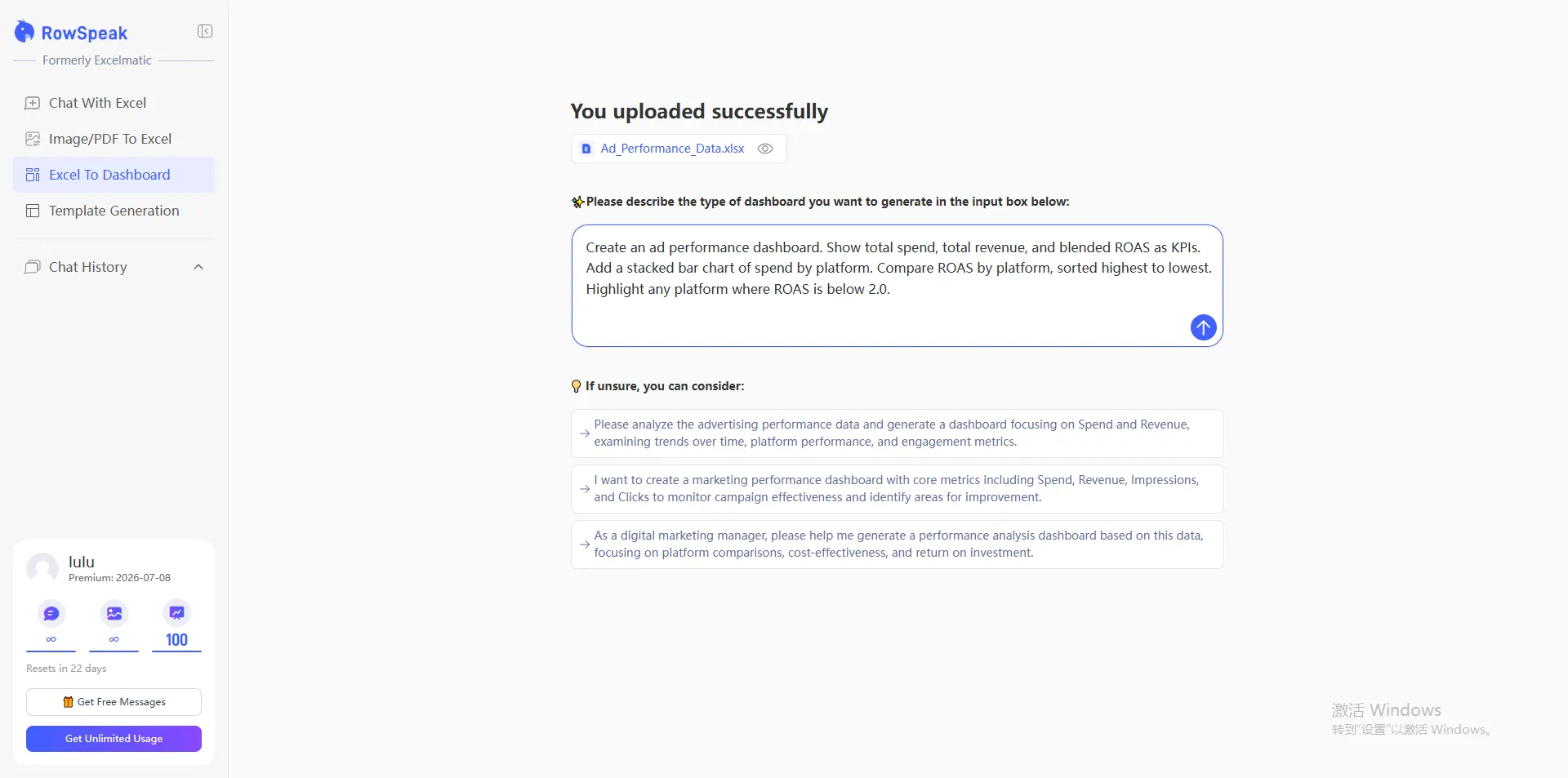

Onde o RowSpeak se encaixa

Uma vez que o endpoint do modelo privado funciona, o RowSpeak torna-se a camada que torna todo o sistema utilizável para equipes reais.

Em vez de forçar os usuários a pensar em requisições de inferência brutas, o RowSpeak oferece a eles um fluxo de trabalho em torno de arquivos e tarefas de análise de planilhas.

Isso significa que eles podem:

- Fazer upload de planilhas

- Fazer perguntas de análise em linguagem natural

- Gerar resumos

- Criar saídas orientadas a gráficos

- Trabalhar com dados de negócios complexos de forma mais natural

Este é o enquadramento mais importante de todo o artigo:

O valor não é "conversar com um CSV".

O valor é pegar dados internos de planilhas bagunçados, roteá-los através de um servidor de IA privado que você controla e transformar os resultados em saídas que as pessoas possam realmente usar para relatórios gerados por IA, suporte à decisão e fluxos de trabalho internos.

![]()

Validação final: o que realmente importa

Antes de considerar a implantação concluída, verifique os pontos que importam em um rollout interno real:

- O endpoint permanece estável sob requisições repetidas?

- A latência é aceitável para uso interno real?

- O nome do modelo está configurado corretamente no app?

- As regras de rede e controles de acesso estão corretos?

- As saídas de análise e gráficos são realmente úteis em tarefas reais de planilhas?

Esse último ponto é o que as pessoas ignoram com mais frequência.

Uma implantação de IA privada não é bem-sucedida apenas porque o servidor está rodando. Ela é bem-sucedida quando os usuários internos podem confiar nela para o trabalho real com planilhas sem enviar dados sensíveis para fora do seu ambiente.

![]()

O resumo prático

O DeepSeek-V4-Flash agora é oficial, público e de pesos abertos. Se você deseja rodar IA privada para análise interna de planilhas, o caminho mais limpo é implantá-lo em seu próprio servidor de GPU com vLLM primeiro (ou Ollama, onde essa rota se encaixar melhor), verificar a API com prompts de estilo corporativo e, em seguida, conectar uma camada de fluxo de trabalho como o RowSpeak por cima.

Então, em suas variáveis de ambiente, defina orchestrator_model=deepseek-v4-flash, e você poderá usar o RowSpeak para análise de dados interna e geração de gráficos sem rotear o trabalho por uma API de modelo pública.

FAQ

O DeepSeek-V4-Flash é uma boa opção para implantações de IA privada?

Sim — se o seu objetivo é rodar um modelo capaz dentro do seu próprio ambiente para casos de uso internos, como análise de planilhas, suporte a relatórios ou fluxos de trabalho operacionais. O principal motivo pelo qual as equipes buscam o DeepSeek-V4-Flash é que ele oferece uma opção de modelo mais forte sem forçar dados internos sensíveis através de uma API pública.

Devo usar vLLM ou Ollama para uma implantação interna?

Se você deseja um servidor de IA interno com padrão de produção, comece com o vLLM. Se você quer uma prova de conceito mais rápida ou um caminho de implantação local mais simples, o Ollama pode ser uma boa escolha. Na prática, muitas equipes usam o Ollama para explorar e o vLLM para operacionalizar.

O que devo testar antes de considerar a implantação bem-sucedida?

Não pare no "o servidor respondeu". Teste se o endpoint permanece estável, se a latência é aceitável, se os controles de acesso estão corretos e se as saídas são realmente úteis em tarefas reais de análise de planilhas de equipes de finanças, operações ou relatórios.

Isso é realmente sobre análise de planilhas ou apenas chat geral?

Para a maioria dos compradores corporativos, o valor não é o chat genérico. O valor é usar um servidor de IA privado para ajudar as equipes internas a trabalhar com planilhas, exportações de CSV, relatórios e outros dados de negócios estruturados sem expor esse trabalho fora do ambiente da empresa.

Onde o RowSpeak se encaixa nesta arquitetura?

O RowSpeak é a camada de fluxo de trabalho sobre o endpoint do modelo privado. Em vez de pedir aos usuários para interagir com uma API bruta, ele oferece uma interface focada em planilhas para uploads, perguntas, resumos e saídas prontas para gráficos.

Precisa de uma implantação privada para sua equipe?

Se você deseja rodar IA para análise interna de planilhas sem enviar dados sensíveis para uma API de modelo pública, o RowSpeak pode ajudá-lo a transformar um modelo auto-hospedado em um fluxo de trabalho interno utilizável.

Uma configuração empresarial típica pode incluir:

- Opções de implantação privada ou on-premise

- Conexão com seu próprio endpoint de modelo

- Fluxos de trabalho de análise focados em planilhas

- Suporte para equipes de finanças, operações e relatórios

- Controles alinhados com os requisitos internos de segurança de dados

Se você está avaliando um rollout de IA privada e quer um caminho funcional — não apenas uma demo de modelo — entre em contato com o RowSpeak para discutir seu caso de uso.