Muitas equipes estão fazendo uma pergunta simples agora: podemos usar o Llama para analisar planilhas sem enviar arquivos confidenciais para um serviço de IA público?

A resposta curta é sim, mas com uma ressalva importante. O Llama pode ser a camada de raciocínio dentro de um sistema privado de análise de planilhas. Ele não deve ser tratado como o sistema completo.

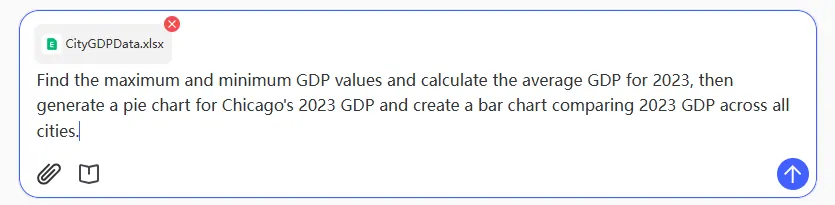

Um modelo pode explicar tendências, gerar fórmulas, escrever SQL, sugerir gráficos e transformar perguntas de negócios complexas em um plano. Mas o trabalho com planilhas corporativas também exige análise de arquivos (parsing), cálculos determinísticos, verificações de permissão, logs de auditoria e um fluxo de trabalho que as equipes de finanças ou operações possam realmente utilizar.

Essa distinção é fundamental. A maioria dos pilotos de IA para planilhas que fracassam ocorre porque a equipe tenta fazer o modelo ser banco de dados, calculadora, camada de segurança e analista ao mesmo tempo.

Por que as empresas estão interessadas no Llama para análise de planilhas

O Llama é atraente porque pode ser executado em ambientes controlados pela própria empresa. A Meta mantém repositórios oficiais do Llama no GitHub, e os modelos Llama são amplamente suportados em stacks de inferência auto-hospedadas.

Para uma empresa com dados sensíveis em planilhas, isso abre um caminho viável:

- Executar o modelo em uma VPC privada ou ambiente on-premise

- Expô-lo por meio de uma API interna

- Manter as pastas de trabalho dentro de um armazenamento aprovado

- Evitar o "copia e cola" improvisado em chatbots públicos

- Construir um analista de IA interno que siga as regras da empresa

Os casos de uso costumam ser práticos, não experimentais.

Uma equipe financeira quer entender por que a margem bruta mudou por região. Uma equipe de operações de vendas quer resumir as mudanças no pipeline a partir de uma exportação semanal. Uma equipe de relatórios quer um rascunho de comentário de uma planilha antes de uma reunião de diretoria. Esses são exatamente os tipos de fluxos de trabalho onde a IA pode economizar tempo, mas também são onde a exposição de dados é crítica.

O que o Llama faz bem

Para análise de planilhas, o Llama é útil quando a tarefa envolve linguagem, raciocínio ou planejamento de fluxo de trabalho.

Ele pode ajudar a:

- Interpretar perguntas do usuário em linguagem natural

- Identificar colunas e métricas prováveis

- Gerar fórmulas de Excel ou SQL

- Explicar uma variação ou tendência

- Sugerir gráficos para um relatório

- Resumir resultados de um cálculo

- Redigir comentários gerenciais

- Transformar uma pergunta vaga em um plano de análise estruturado

Por exemplo, um usuário pode perguntar:

Qual categoria de produto causou a queda na margem no último trimestre e qual gráfico devo usar no relatório executivo?

Um bom sistema de IA pode usar o Llama para interpretar a solicitação, decidir quais campos importam, acionar uma ferramenta de cálculo e explicar o resultado de forma clara.

A frase-chave aqui é "acionar uma ferramenta de cálculo".

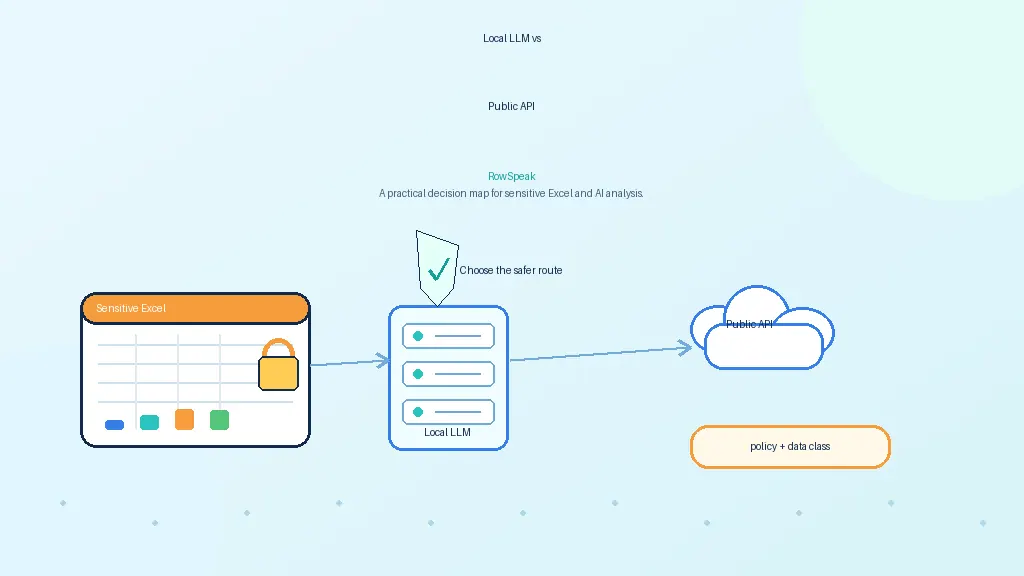

O que o Llama não deve fazer sozinho

Um sistema de planilhas não deve pedir ao Llama para calcular totais lendo milhares de linhas dentro de um prompt. Isso é lento, caro e pouco confiável.

LLMs podem alucinar números. Eles podem ignorar linhas ocultas, confundir colunas com nomes semelhantes ou produzir uma explicação plausível baseada em um contexto incompleto.

Isso não torna o Llama inadequado. Significa apenas que a arquitetura precisa ser honesta sobre as limitações do modelo.

Use o Llama para entender a intenção, raciocinar, gerar código ou consultas e explicar resultados. Use sistemas determinísticos para aritmética e operações de dados.

Esses sistemas determinísticos podem incluir:

- SQL

- DuckDB

- pandas ou Polars

- Um motor de fórmulas compatível com Excel

- Uma camada semântica de BI

- Uma consulta governada em um data warehouse

O modelo planeja e explica. A camada de computação calcula.

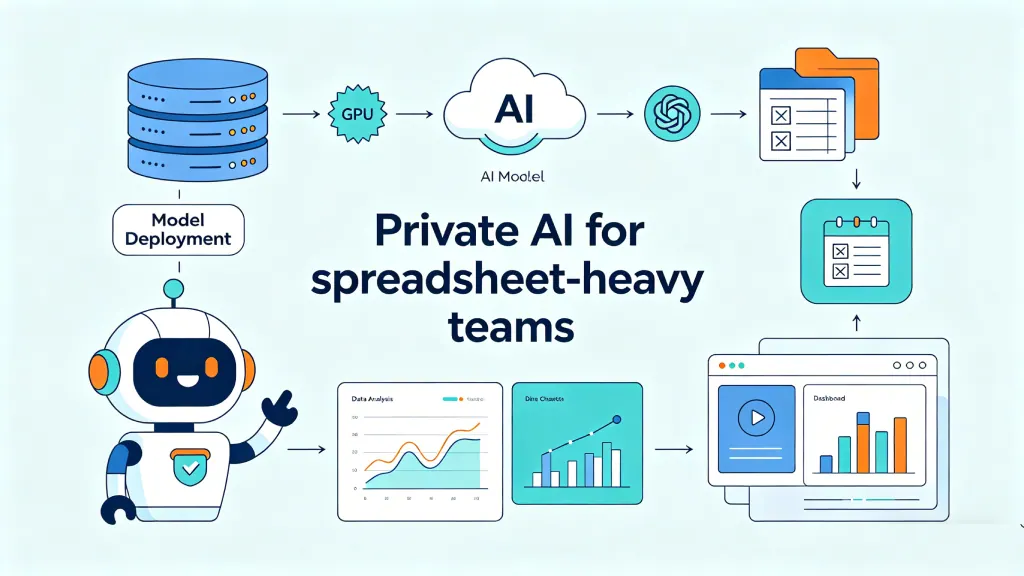

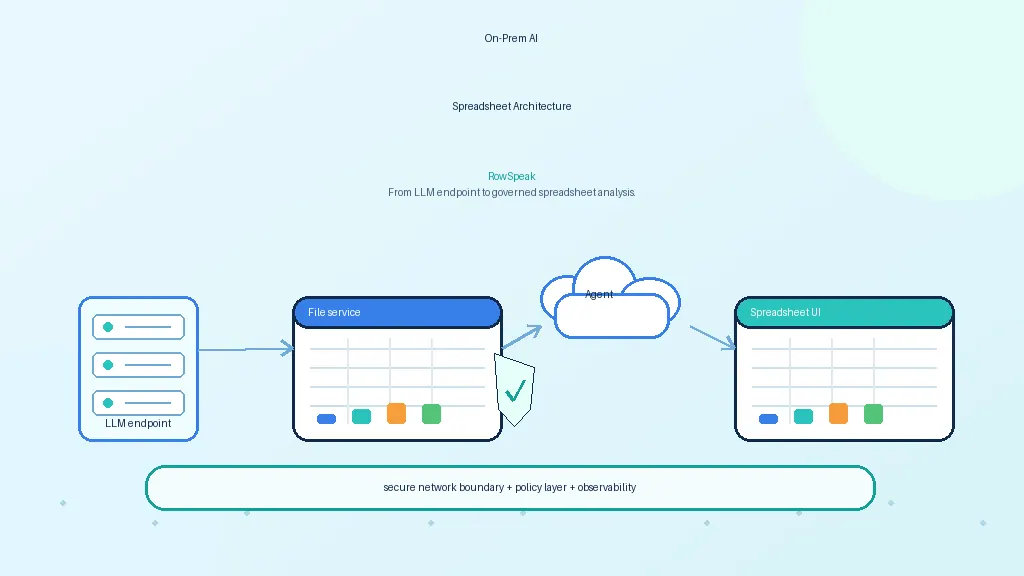

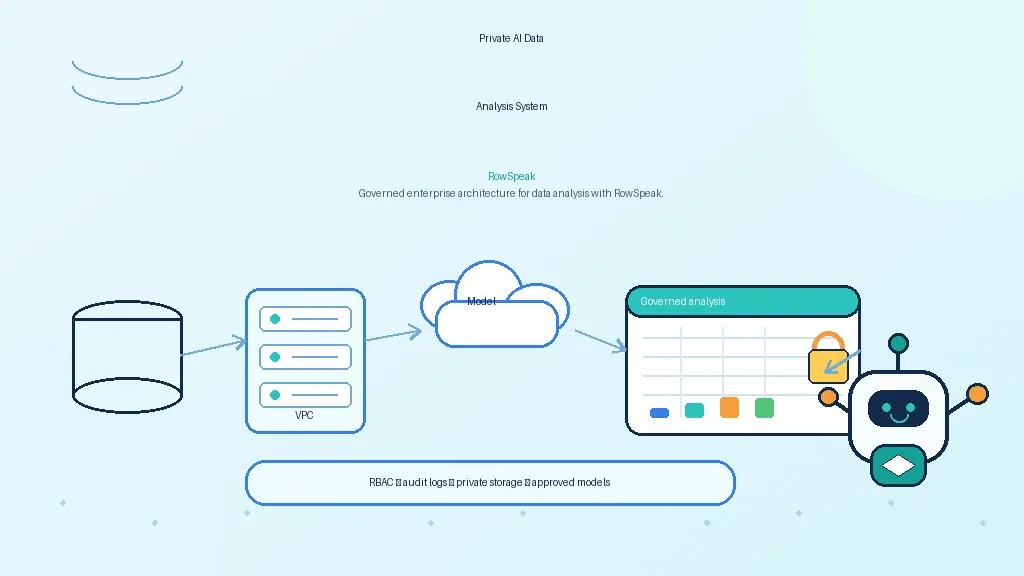

Uma arquitetura privada prática

Um sistema privado de planilhas com Llama geralmente precisa destas camadas:

Ingestão privada de arquivos

Pastas de trabalho, CSVs e exportações são carregados dentro do ambiente da empresa.Compreensão da planilha

O sistema extrai abas, colunas, fórmulas, intervalos nomeados, tipos de dados e estrutura de tabelas.Camada de computação

Os cálculos são executados via SQL, Python, fórmulas de planilha ou outro motor determinístico.Endpoint do modelo

O Llama é executado através de um servidor de inferência privado.Camada de fluxo de trabalho

Os usuários fazem perguntas, revisam resultados, criam gráficos e geram relatórios sem chamar a API do modelo diretamente.Camada de governança

O sistema aplica permissões, registra logs de acesso aos dados, controla a retenção e documenta qual resposta foi produzida a partir de quais dados.

É por isso que o modelo sozinho não basta. O Llama pode ser poderoso, mas os usuários de negócios não querem um endpoint bruto /v1/chat/completions. Eles querem uma experiência de analista.

vLLM, Ollama ou llama.cpp?

O runtime ideal depende do estágio do projeto.

Ollama é excelente para testes locais e protótipos rápidos. É fácil de rodar e bom para validar prompts e ideias de fluxo de trabalho.

vLLM é mais adequado quando a equipe precisa de serviço em GPU para produção, processamento em lote (batching) e uma API compatível com OpenAI. O projeto vLLM documenta um servidor compatível com OpenAI, o que facilita a conexão da infraestrutura de serviço do modelo às camadas da aplicação.

llama.cpp é útil para inferência local quantizada, experimentos em CPU ou Apple Silicon e ambientes com recursos limitados.

Para análise de planilhas corporativas, um caminho comum é simples: prototipar com Ollama, validar o fluxo de trabalho e depois migrar a implantação interna séria para vLLM ou outra stack de produção.

O problema da precisão tem solução, mas exige design

A precisão na IA para planilhas não vem de pedir ao modelo para "ser mais cuidadoso". Ela vem do embasamento (grounding) do modelo em ferramentas e evidências.

Um analista de planilhas privado deve:

- Inspecionar o esquema (schema) antes de responder

- Fazer perguntas de esclarecimento quando as colunas forem ambíguas

- Executar cálculos fora do modelo

- Retornar referências de linhas, abas ou consultas

- Mostrar tabelas intermediárias quando for útil

- Separar fatos de interpretações

- Manter um log da fórmula, SQL ou código gerado

Isso torna a resposta auditável. Um analista financeiro pode ver de onde veio o número. Uma equipe de TI pode ver quais dados foram acessados. Um gestor pode confiar no processo mais do que em um resumo de "caixa preta".

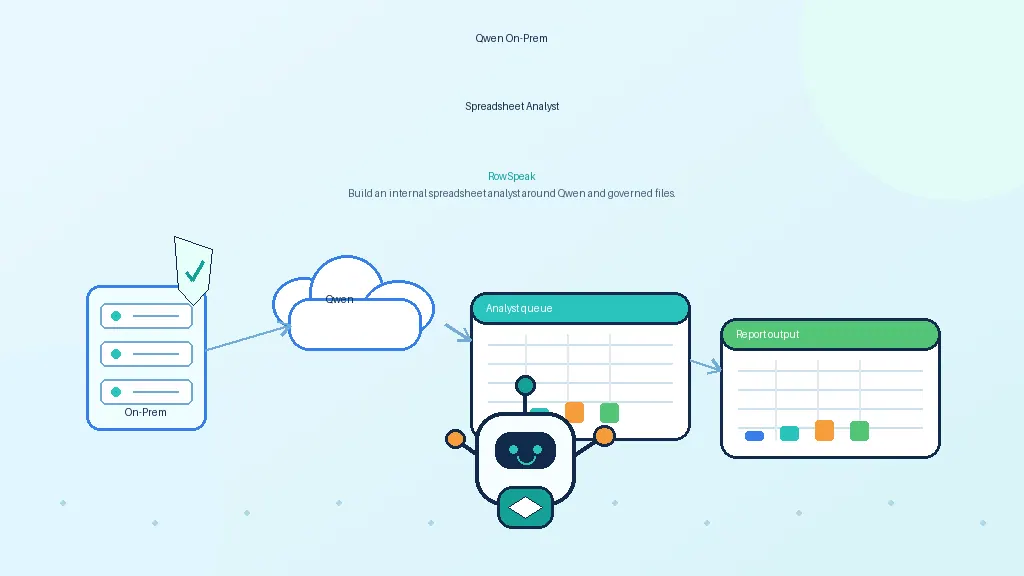

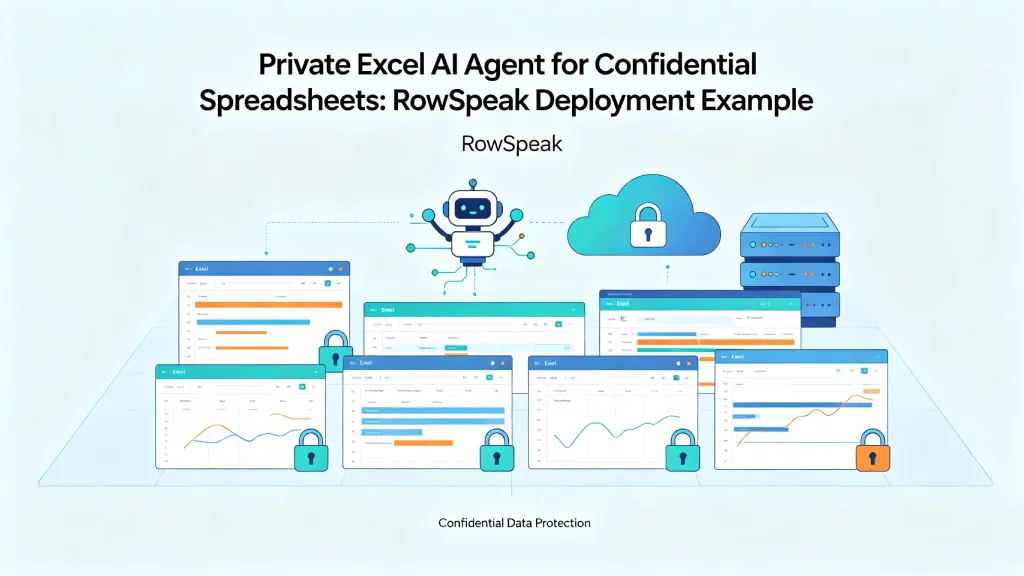

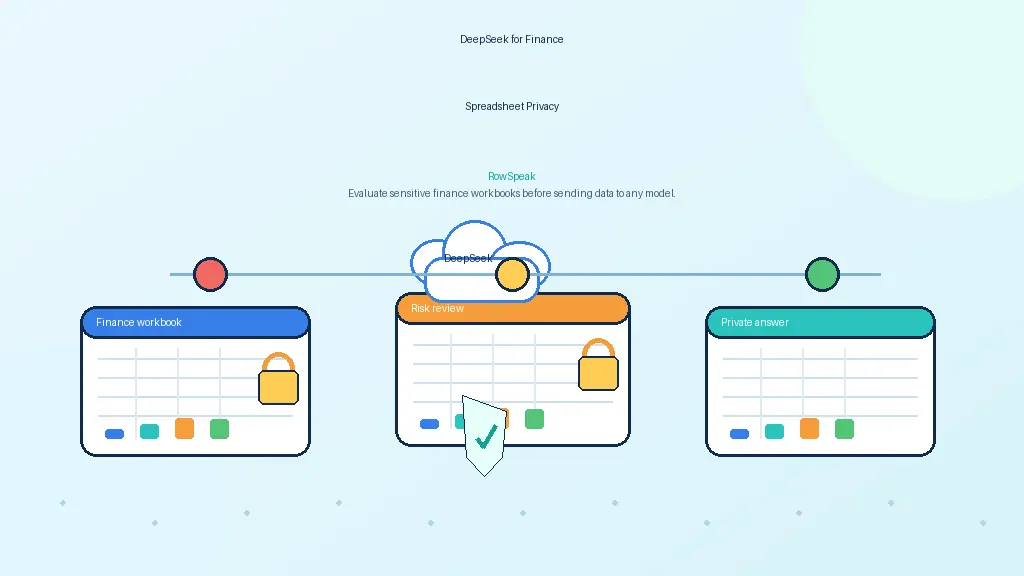

Onde o RowSpeak se encaixa

O RowSpeak não foi feito para substituir o Llama. Ele atua acima de modelos como o Llama como a camada de fluxo de trabalho do assistente de planilha.

Em uma implantação privada, o modelo fornece o raciocínio. O RowSpeak fornece a experiência em torno desse raciocínio: carregar uma planilha, perguntar em linguagem natural, realizar análise de dados de planilha por IA, criar gráficos e produzir explicações prontas para relatórios.

Essa camada é onde reside grande parte do valor corporativo. Ela lida com as partes complexas que um endpoint de modelo bruto não resolve: estrutura da pasta de trabalho, fluxo de trabalho do usuário, embasamento de cálculos e entregas voltadas para o negócio.

Para empresas que avaliam o Llama, a questão estratégica não é apenas "Podemos rodar o modelo?", mas sim "Podemos transformar o modelo em um analista de planilhas governado que nossas equipes realmente usarão?"

Checklist antes de pilotar o Llama para análise privada de planilhas

Antes de começar, responda a estas perguntas:

- Que tipos de planilhas os usuários analisarão?

- Existem abas ocultas, fórmulas, tabelas dinâmicas ou vários arquivos relacionados?

- Quais dados são confidenciais ou regulamentados?

- Onde os arquivos serão armazenados?

- Qual runtime servirá o modelo?

- Qual motor executará os cálculos?

- Como os resultados citarão as linhas, células ou consultas de origem?

- Como o acesso será registrado em log?

- Quem pode ver os arquivos carregados e os relatórios gerados?

- Qual é o plano de contingência quando o modelo estiver incerto?

Se essas perguntas estiverem claras, o Llama pode se tornar uma base sólida para análise privada de planilhas e trabalhos repetíveis, como relatórios de planilhas recorrentes. Se forem ignoradas, o projeto corre o risco de ser apenas mais uma demonstração de chatbot.

Fontes e leituras adicionais

- Meta Llama GitHub: https://github.com/meta-llama

- vLLM OpenAI-compatible server: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Ollama model library: https://ollama.com/library

- llama.cpp: https://github.com/ggml-org/llama.cpp