Le débat opposant les LLM locaux aux API d'IA publiques est souvent trop simpliste.

D'un côté, certains affirment que chaque entreprise devrait exécuter ses modèles localement. De l'autre, on soutient que les services d'IA d'entreprise sont suffisamment sûrs et bien plus simples à exploiter.

Pour les données Excel sensibles, la réponse est plus pragmatique : il faut adapter l'architecture à la sensibilité de la feuille de calcul, à la maturité de vos processus de sécurité et au flux de travail réel de vos utilisateurs.

Une API publique, un service d'IA d'entreprise, un modèle local, un déploiement en VPC privé ou un flux de travail avec anonymisation peuvent tous être pertinents selon la situation.

Pourquoi les données Excel nécessitent une attention particulière

Les feuilles de calcul sont souvent sous-estimées.

Elles contiennent fréquemment des données qui n'ont jamais été intégrées dans un système décisionnel (BI) encadré :

- revenus par client

- salaires et commissions

- prévisions

- budgets

- rapports destinés au conseil d'administration

- conditions fournisseurs

- exports du support client

- registres fiscaux

- anomalies opérationnelles

- informations personnellement identifiables (PII)

Lorsqu'un employé télécharge un tel fichier vers un chatbot, l'entreprise peut perdre le contrôle sur la destination des données, leur durée de conservation, leur accès et la conformité de l'action avec la politique interne.

Le risque n'est pas seulement technique, il est procédural. La plupart des téléchargements de feuilles de calcul s'effectuent en dehors des circuits habituels de gouvernance des données.

Les cinq options principales

1. Chatbot public

C'est la voie la plus simple. Un utilisateur ouvre un chatbot, télécharge un fichier et demande une analyse.

Cela peut convenir pour des données publiques ou synthétiques. C'est risqué pour des fichiers confidentiels, à moins que l'organisation n'ait explicitement approuvé l'outil et l'usage.

Le principal avantage est la rapidité. Le risque majeur est l'exposition incontrôlée des données.

2. API publique

Une API publique offre aux développeurs plus de contrôle qu'un chatbot grand public. Ils peuvent concevoir une application interne, limiter les données envoyées et gérer les instructions (prompts) avec plus de précision.

Cependant, les données quittent toujours l'environnement de l'entreprise. Les conditions d'utilisation, de conservation, de journalisation et de conformité du fournisseur sont alors cruciales.

Pour beaucoup d'entreprises, cette solution est viable après un audit du fournisseur et avec un contrat adapté. Elle ne doit pas être considérée comme sûre par défaut.

3. Service d'IA d'entreprise

Les plateformes d'IA d'entreprise offrent souvent des engagements de confidentialité plus stricts, des contrôles administratifs, du chiffrement, l'assurance que les données ne servent pas à l'entraînement, des options de rétention et une documentation de conformité.

Citons par exemple les offres entreprises d'OpenAI, Microsoft Azure OpenAI, AWS Bedrock, Google Vertex AI ou Anthropic.

C'est souvent le meilleur compromis pour les entreprises qui exigent des modèles de haute qualité sans vouloir gérer leur propre infrastructure GPU.

Le revers de la médaille est que le traitement s'effectue toujours hors des serveurs de l'entreprise, même sous un contrôle renforcé.

4. LLM local

Un LLM local s'exécute sur un ordinateur portable, une station de travail, un serveur ou une infrastructure GPU interne.

L'avantage principal est le contrôle total. Les données restent dans la machine ou le réseau local. C'est utile pour les prototypes, les expérimentations confidentielles ou les usages hors ligne.

Les inconvénients sont réels :

- la qualité du modèle peut être inférieure aux API de pointe

- l'installation peut être instable

- les GPU sont coûteux

- la surveillance est limitée, sauf si vous la développez

- le contrôle d'accès et les journaux d'audit sont à votre charge

- "local" ne signifie pas automatiquement "conforme"

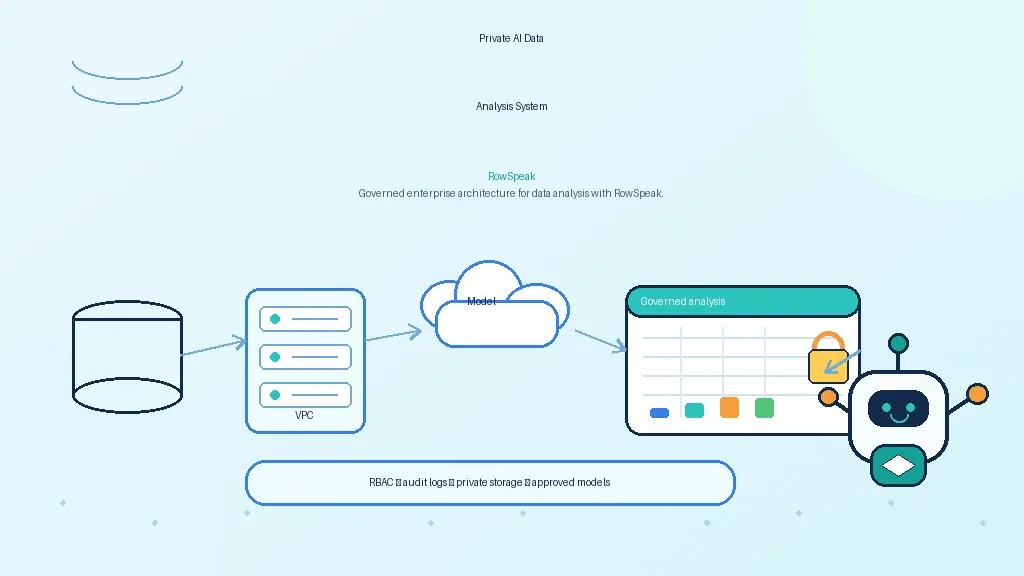

5. VPC privé ou déploiement sur site (on-prem)

C'est la version "entreprise" de l'IA locale.

Le modèle tourne dans un environnement contrôlé, généralement avec une gestion d'identité, de réseau, de stockage et des politiques de sécurité dédiées. L'équipe peut exposer une API interne et la connecter aux applications approuvées.

C'est la voie la plus robuste pour les flux de travail Excel hautement sensibles, mais elle exige une grande maturité opérationnelle.

Un cadre de décision pratique

Utilisez la sensibilité des données comme premier filtre.

| Type de feuille de calcul | Solution d'IA recommandée |

|---|---|

| Données publiques ou exemples | Chatbot public ou API |

| Données internes à faible risque | Service d'IA d'entreprise approuvé |

| Données commerciales confidentielles | API d'entreprise avec contrat, VPC privé ou application interne approuvée |

| Données réglementées ou hautement sensibles | VPC privé, sur site, hors ligne ou flux avec anonymisation |

| Sensibilité inconnue | Ne pas télécharger avant classification |

Posez-vous ensuite la question opérationnelle : qui assurera la maintenance ?

Si l'entreprise n'a pas la capacité de gérer des GPU, de mettre à jour des serveurs de modèles et de surveiller les sorties, un déploiement local peut créer de nouveaux risques. Dans ce cas, un service d'IA d'entreprise bien encadré peut s'avérer plus sûr qu'un modèle local non géré.

Le local n'est pas synonyme de sécurité absolue

Un modèle local peut tout de même laisser fuiter des données si le système environnant est défaillant.

Erreurs courantes :

- stockage des fichiers téléchargés dans un dossier non chiffré

- journalisation de prompts contenant des valeurs sensibles

- accès illimité de tous les utilisateurs à tous les fichiers

- autorisation du code généré à accéder au réseau

- absence de correctifs de sécurité sur la machine hôte

- copie des résultats dans des outils non gérés

- utilisation de modèles ou de paquets provenant de sources non fiables

La confidentialité est une propriété de l'architecture globale, pas seulement de l'emplacement du modèle.

Une API publique n'est pas forcément dangereuse

L'inverse est également vrai.

Les API d'IA d'entreprise peuvent offrir des contrôles robustes. Certains fournisseurs garantissent que les données des clients API ne sont pas utilisées pour l'entraînement. Les fournisseurs de cloud proposent souvent des réseaux privés, de l'IAM, du chiffrement et des journaux d'audit.

La question pertinente doit être précise :

- Quel abonnement ?

- Quel contrat ?

- Quel paramètre de rétention ?

- Quelle région ?

- Quels journaux ?

- Quels utilisateurs ?

- Quelles données Excel ?

Une API publique avec des contrôles d'entreprise peut être acceptable pour de nombreux flux. Un téléchargement sur un chatbot aléatoire ne l'est pas.

À quoi ressemble un flux de travail idéal pour Excel sensible

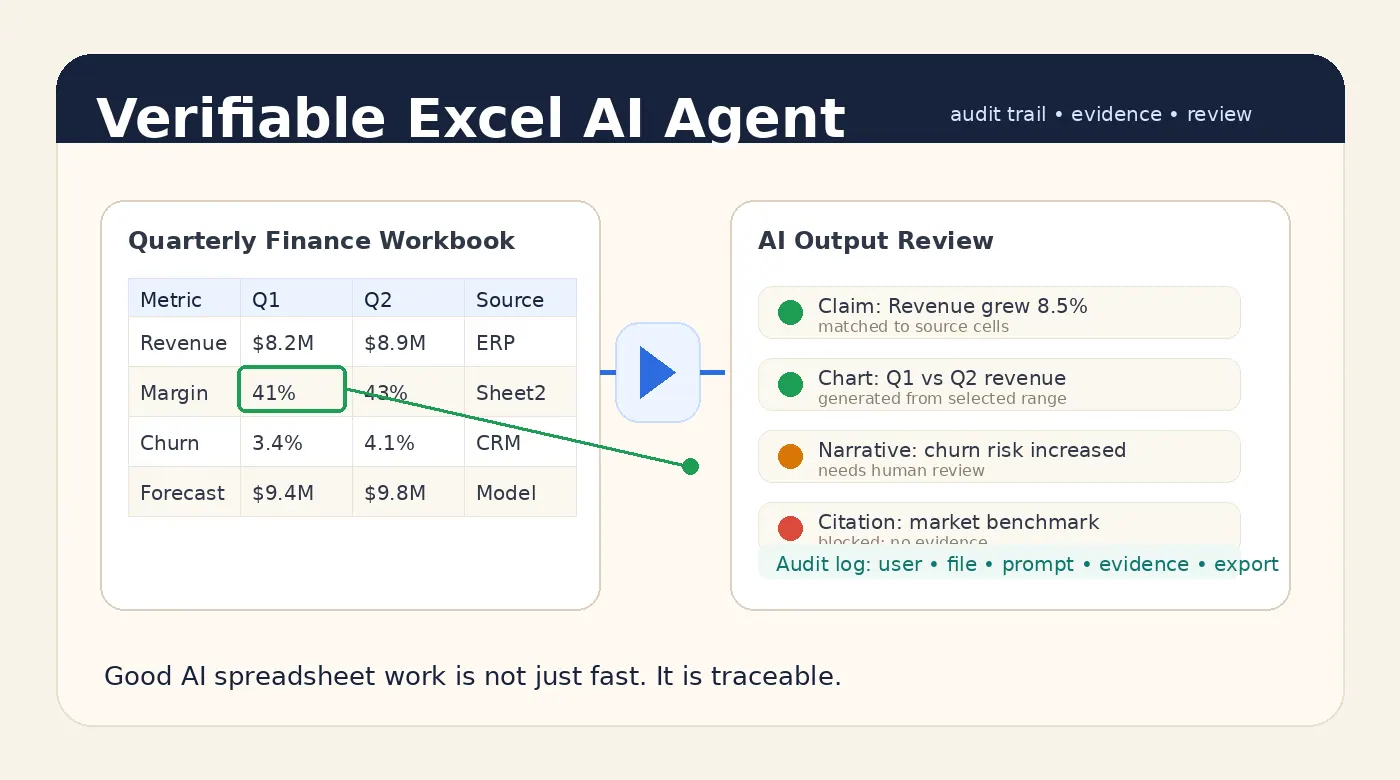

Pour l'analyse de feuilles de calcul sensibles, un bon flux de travail doit :

- classifier les données avant l'analyse

- conserver les fichiers dans un stockage approuvé

- appliquer les permissions utilisateurs

- utiliser des outils déterministes pour les calculs

- n'envoyer que le contexte nécessaire au modèle

- empêcher les fuites de données sortantes

- citer les lignes, feuilles, formules ou requêtes sources

- journaliser les prompts, les outils, les accès et les résultats

- permettre aux administrateurs de contrôler la rétention

- supporter des points de terminaison (endpoints) privés ou approuvés

Cela offre aux équipes un équilibre pratique : l'utilité de l'IA sans les risques du copier-coller incontrôlé.

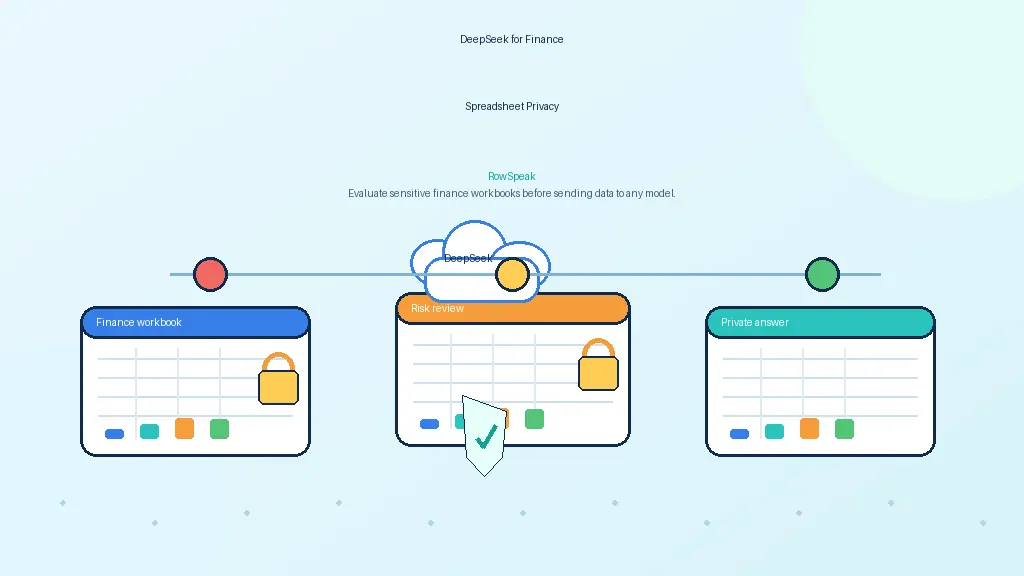

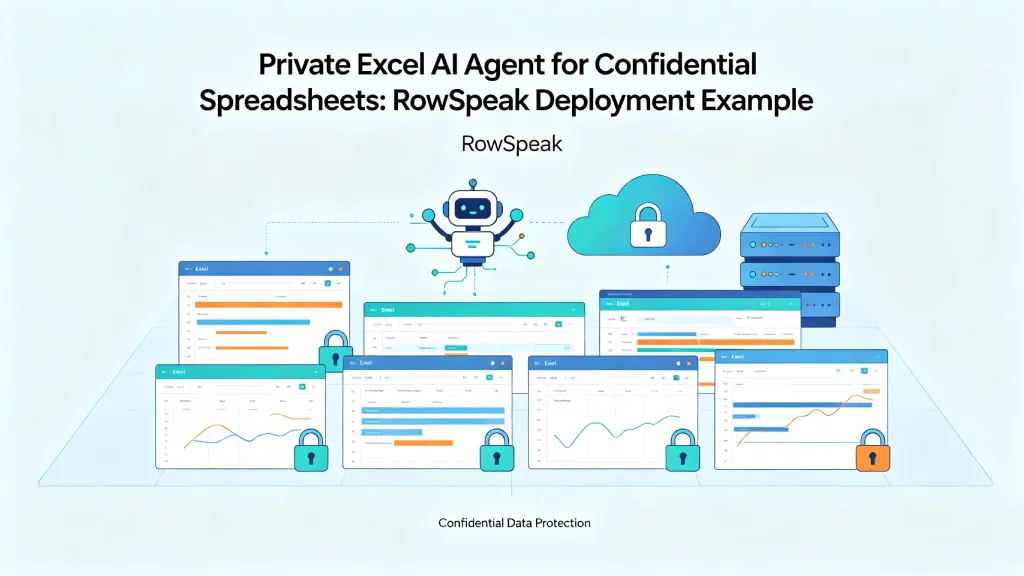

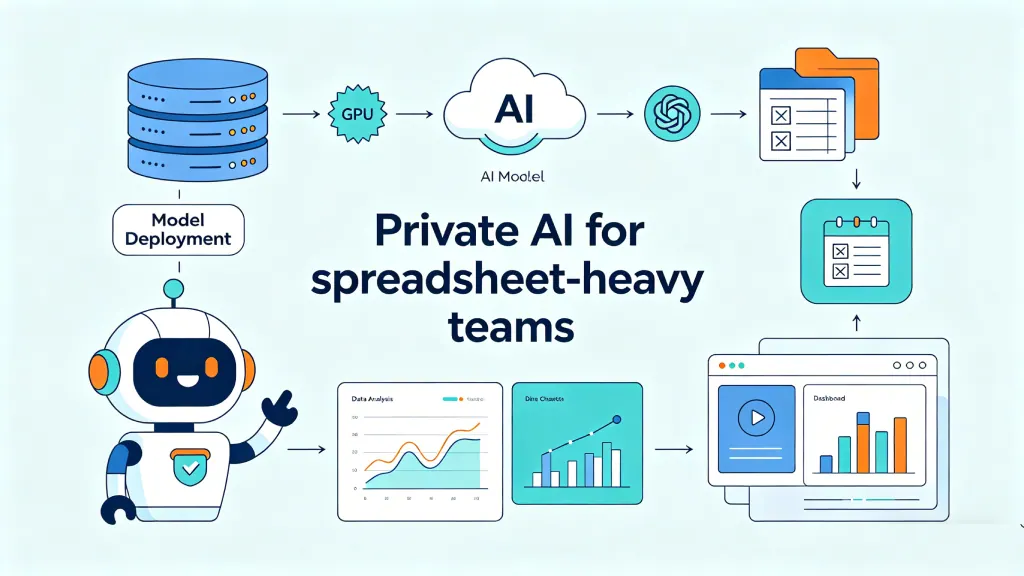

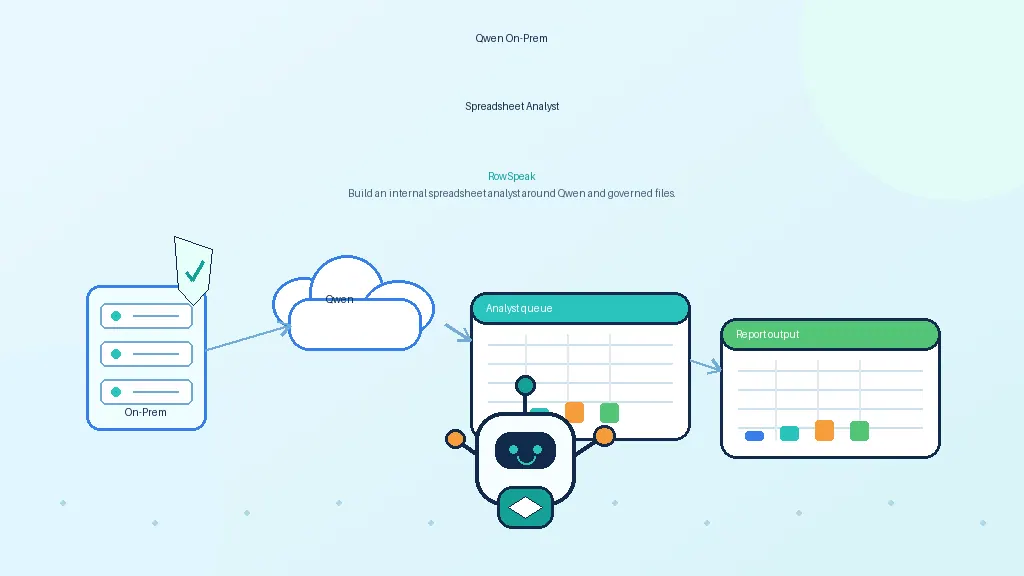

Le rôle de RowSpeak

RowSpeak est une couche de flux de travail pour l'analyse de tableurs. Cela signifie qu'il peut s'interfacer avec différents choix de modèles.

Pour une équipe à faible risque, le modèle peut être une API d'entreprise approuvée. Pour un déploiement sensible, il peut s'agir d'un LLM privé tournant sur l'infrastructure du client. Dans les deux cas, l'expérience utilisateur reste centrée sur la tâche Excel : télécharger les données, poser des questions, générer des graphiques et transformer des fichiers Excel en tableaux de bord via un flux Excel-vers-dashboard.

Le modèle est interchangeable. Le flux de travail gouverné est la partie pérenne. C'est pourquoi cette décision s'inscrit souvent dans une planification d'informatique décisionnelle par l'IA plus large, et non dans une simple sélection de modèle.

Liste de vérification finale

Avant de choisir entre un LLM local ou une API publique pour vos analyses Excel, répondez à ces questions :

- Quel est le champ le plus sensible du classeur ?

- L'outil est-il approuvé pour cette classe de données ?

- Le fournisseur s'entraîne-t-il sur les prompts, les fichiers ou les résultats ?

- Où les données sont-elles traitées et conservées ?

- Pouvez-vous utiliser des échantillons anonymisés à la place ?

- Les utilisateurs ont-ils besoin de permissions au niveau de la ligne ou du fichier ?

- Les calculs sont-ils effectués de manière déterministe ?

- Les réponses sont-elles auditables ?

- Qui assure la maintenance du modèle et de l'infrastructure ?

- Que se passe-t-il si le modèle se trompe ?

La meilleure architecture est rarement la plus idéologique. C'est celle qui apporte une aide analytique réelle tout en respectant le niveau de risque de la feuille de calcul. Si la question principale concerne l'adéquation du fournisseur, il peut être utile de comparer des options familières comme Copilot dans Excel avec des outils de flux de travail privés.

Sources et lectures complémentaires

- Confidentialité entreprise OpenAI : https://openai.com/enterprise-privacy/

- FAQ AWS Bedrock : https://aws.amazon.com/bedrock/faqs/

- Gouvernance des données Google Vertex AI / rétention zéro : https://docs.cloud.google.com/vertex-ai/generative-ai/docs/vertex-ai-zero-data-retention

- Serveur vLLM compatible OpenAI : https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Bibliothèque Ollama : https://ollama.com/library