DeepSeek-V4-Flash est désormais officiel, public et en poids ouverts (open-weight).

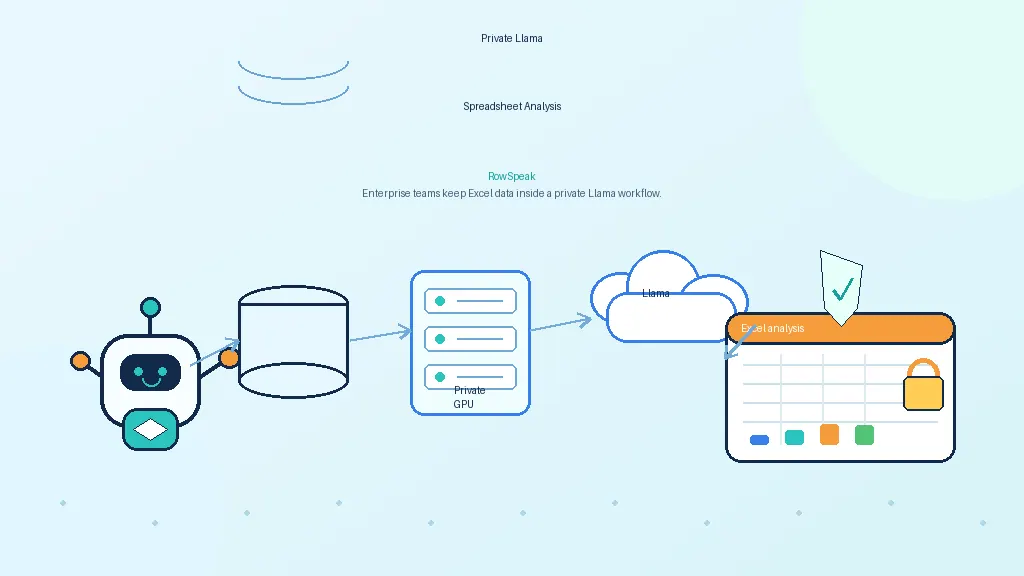

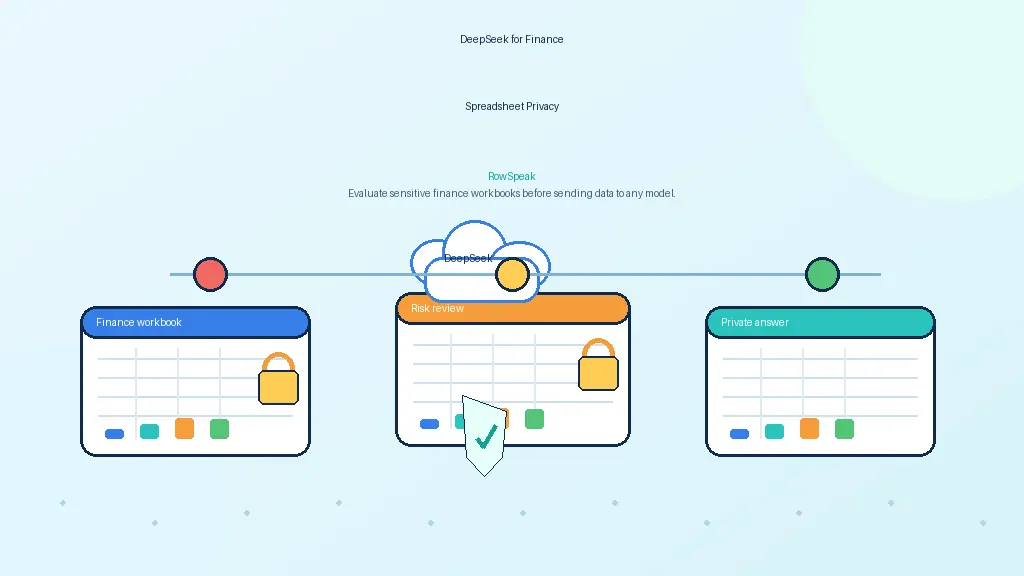

C'est une nouvelle majeure pour un profil d'acheteur très précis : les équipes qui souhaitent une capacité d'IA accrue sans envoyer de données sensibles (comme des feuilles de calcul) vers une API externe.

Si vous évaluez l'utilisation d'une IA privée pour vos rapports financiers, vos classeurs opérationnels, vos exports internes ou vos analyses de données récurrentes, la question n'est plus seulement de savoir si un tel modèle peut tourner sur votre propre infrastructure. La vraie question est de savoir si vous pouvez le transformer en un service interne sécurisé que vos collaborateurs pourront réellement utiliser.

Cet article a été conçu pour vous aider à répondre à cette question.

Plus précisément, il détaille une configuration pratique d'IA privée pour l'analyse interne de feuilles de calcul :

- Exécuter DeepSeek-V4-Flash sur votre propre serveur GPU.

- L'exposer via une API d'inférence privée.

- Valider le fonctionnement du point de terminaison (endpoint) avec des prompts orientés "métier".

- Le connecter à une couche de workflow comme RowSpeak pour que les utilisateurs non techniques puissent analyser des données de tableurs sans avoir à manipuler des appels de modèle bruts.

Il ne s'agit pas ici de "discuter avec un modèle", mais bien de bâtir un serveur d'IA privé capable de soutenir de véritables flux de travail sur des feuilles de calcul internes.

Pourquoi les équipes veulent un serveur d'IA privé pour l'analyse de données

Quand on parle d'auto-hébergement, on présente souvent cela comme un choix idéologique. En réalité, la motivation est généralement opérationnelle et commerciale.

Une équipe finance ne souhaite pas que ses rapports de gestion transitent par une API publique s'ils peuvent l'éviter, surtout lorsque ces fichiers alimentent des workflows de reporting de gestion. Une équipe opérationnelle ne veut pas que ses suivis internes, ses exports de revenus et ses classeurs transversaux complexes quittent leur environnement sécurisé pour être analysés. Enfin, une équipe IT ou sécurité recherche la simplicité : un endpoint de modèle qu'elle peut contrôler, surveiller, auditer et restreindre comme n'importe quel autre système interne.

C'est là que DeepSeek-V4-Flash devient particulièrement attractif.

DeepSeek s'est rapidement imposé dans les discussions sur l'IA privée, car les équipes y voient désormais une base réaliste pour des déploiements internes.

Le modèle est suffisamment performant pour justifier un déploiement, et suffisamment ouvert pour rendre une mise en œuvre privée réaliste.

Si votre usage se limite à du chat grand public, une API hébergée reste probablement l'option la plus simple.

Mais si votre charge de travail réelle ressemble plutôt à ceci :

- Classeurs financiers

- Rapports de ventes hebdomadaires

- Tables BI exportées

- Extractions CSV de systèmes internes

- Feuilles de calcul opérationnelles complexes qui orientent des décisions stratégiques

Alors, la voie du serveur privé devient bien plus pertinente.

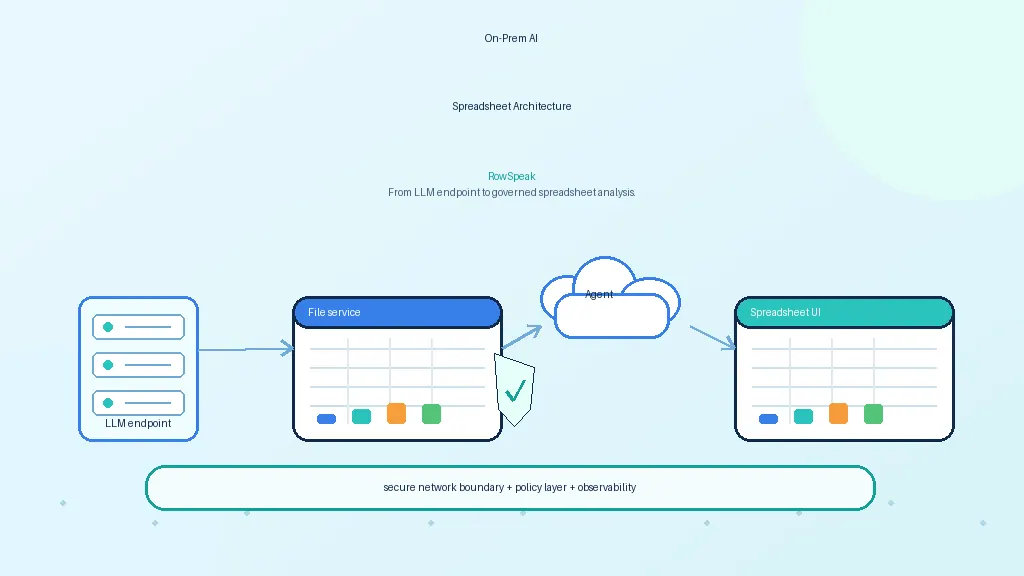

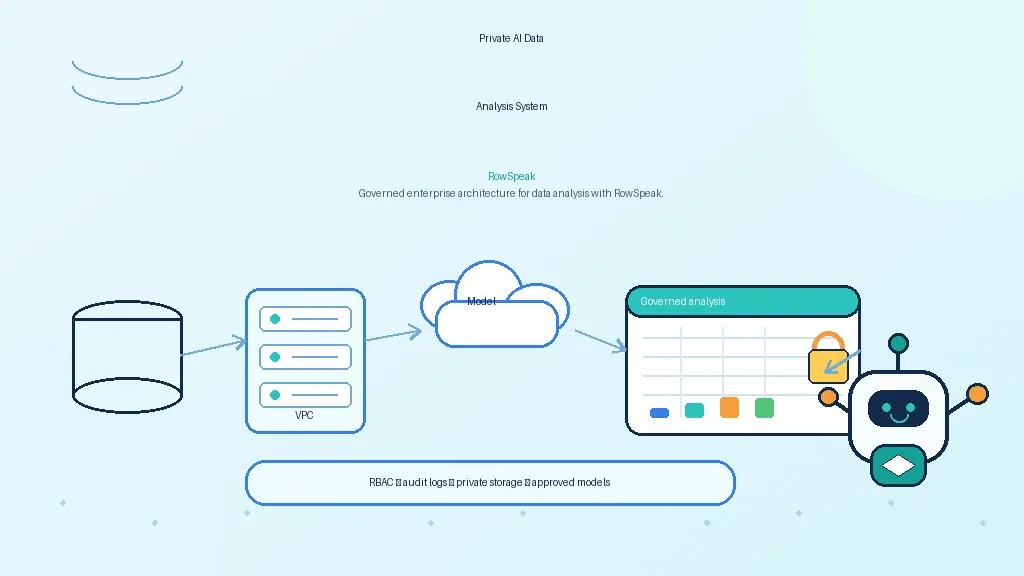

Ce que vous construisez concrètement

La bonne nouvelle est que l'architecture elle-même est simple.

Vous n'avez pas besoin d'une plateforme d'IA géante pour générer de la valeur. Il vous faut quatre éléments :

- Un serveur GPU sous votre contrôle.

- Un runtime de modèle.

- Un point de terminaison (endpoint) API privé.

- Une couche de workflow au-dessus de cet endpoint pour les utilisateurs finaux.

Dans cette configuration :

- DeepSeek-V4-Flash est le modèle.

- vLLM ou Ollama constitue la couche de service (serving layer).

- RowSpeak est la couche de workflow qui transforme l'accès au modèle en tâches d'analyse de données concrètes.

Cette séparation est cruciale car elle permet à chaque couche de rester spécialisée.

Le serveur de modèle gère l'inférence. La couche de workflow gère la réalité complexe de l'utilisation métier : téléchargement de fichiers, contexte des feuilles de calcul et questions en langage naturel, résumés et résultats prêts pour des graphiques.

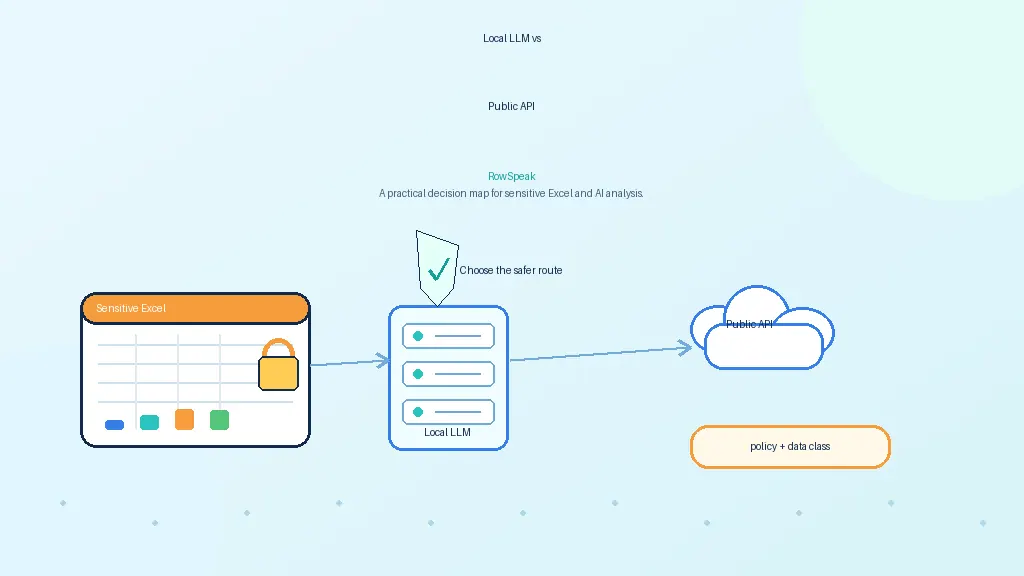

Quelle méthode de déploiement choisir ?

Il existe deux options réalistes, et le bon choix dépend du type de service interne que vous souhaitez opérer.

Option 1 : vLLM

Si vous construisez un endpoint d'IA interne sérieux pour un usage métier répété, c'est la voie que je recommande en priorité.

La raison est simple : vLLM est une pile de service orientée production, et son API compatible OpenAI facilite grandement l'intégration. Si votre objectif est de placer DeepSeek-V4-Flash derrière un workflow d'analyse de données interne, la compatibilité API et le contrôle du déploiement sont essentiels.

Option 2 : Ollama

Ollama est l'option la plus pratique lorsque le packaging du modèle et le support du runtime correspondent à ce que vous voulez déployer.

C'est plus facile à mettre en œuvre, et pour des scénarios internes plus légers ou des preuves de concept (PoC) rapides, c'est un choix judicieux.

Pour résumer la décision en une phrase :

Utilisez vLLM pour un serveur d'IA privé de type production, et utilisez Ollama lorsque la rapidité et la simplicité priment sur le contrôle de l'infrastructure.

Avant de commencer : vérifiez le serveur, pas seulement l'idée

Le matériel exact dont vous avez besoin dépend de l'artefact DeepSeek-V4-Flash choisi, de la précision souhaitée, de la longueur du contexte et de la simultanéité attendue.

C'est pourquoi les conseils génériques du type "il vous faut X GPU" sont souvent trompeurs.

La meilleure approche consiste à partir de l'artefact officiel du modèle et à dimensionner la machine en fonction de ce que vous prévoyez réellement de servir.

Au minimum, votre serveur doit disposer de :

- Un système Linux sous votre contrôle.

- Des GPU NVIDIA.

- Une installation propre des pilotes.

- Un environnement CUDA fonctionnel.

- Python installé.

- Suffisamment de VRAM pour l'artefact du modèle choisi.

Avant toute chose, effectuez une vérification rapide :

nvidia-smi

python3 --version

Cela semble basique, mais c'est indispensable. Un nombre surprenant de problèmes de déploiement ne proviennent pas du modèle, mais de soucis de pilotes, d'environnement ou de préparation de la machine.

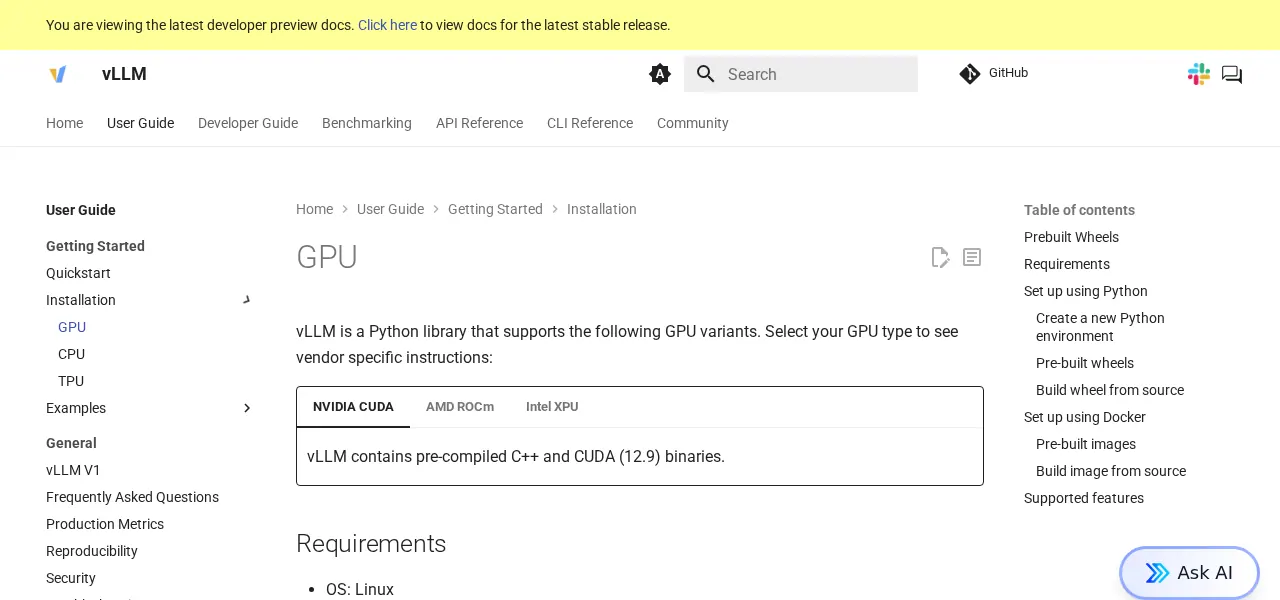

Déploiement avec vLLM

Si vous voulez la voie la plus propre pour un "déploiement réel", commencez ici.

Étape 1 : Installer vLLM dans un environnement propre

python3 -m venv .venv

source .venv/bin/activate

pip install --upgrade pip

pip install vllm

Documentation utile :

Étape 2 : Utiliser l'artefact officiel de DeepSeek

C'est ici qu'un petit raccourci peut causer beaucoup de problèmes par la suite.

Évitez les miroirs aléatoires si possible. Partez de la page de sortie officielle de DeepSeek, puis suivez la collection officielle Hugging Face qui y est liée.

Cela vous garantit une traçabilité propre et réduit les risques de déployer une version incorrecte.

Page de sortie officielle de DeepSeek annonçant V4-Flash dans le cadre du lancement de la Preview de DeepSeek V4.

Étape 3 : Lancer le serveur API

Un lancement classique de vLLM ressemble à ceci :

python -m vllm.entrypoints.openai.api_server --model deepseek-ai/DeepSeek-V4-Flash --host 0.0.0.0 --port 8000

Selon l'artefact du modèle et la machine, vous devrez peut-être ajuster :

- Le parallélisme des tenseurs (tensor parallelism).

- Le type de données (dtype).

- La longueur maximale du modèle.

- L'utilisation de la mémoire GPU.

Mais l'idée de base reste la même : lancez le modèle, exposez l'endpoint et assurez-vous que la couche de service est stable avant de toucher à la partie applicative.

Étape 4 : Tester l'endpoint comme une API, pas comme une démo

Avant de connecter RowSpeak ou tout autre outil, vérifiez que le serveur de modèle répond correctement de manière autonome.

Par exemple :

curl http://VOTRE_IP_SERVEUR:8000/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "deepseek-ai/DeepSeek-V4-Flash",

"messages": [

{"role": "user", "content": "Résume les avantages de l'auto-hébergement d'un LLM pour l'analyse de feuilles de calcul."}

]

}'

Si le serveur renvoie une réponse valide, votre flux d'inférence principal fonctionne.

À ce stade, ne compliquez pas inutilement le test. Vous ne cherchez pas encore à mesurer les performances globales du système, mais simplement à vérifier que l'endpoint est actif, que le modèle se charge correctement et que l'API se comporte comme prévu.

Déploiement avec Ollama

Ollama est la voie la plus légère. Lorsque le packaging correspond, c'est souvent le moyen le plus rapide d'obtenir un déploiement utilisable.

L'important est de ne pas le considérer comme une solution universelle. C'est l'option idéale quand la version exacte de DeepSeek que vous souhaitez est disponible dans un format qu'Ollama peut servir proprement.

Documentation officielle :

Installez-le d'abord :

curl -fsSL https://ollama.com/install.sh | sh

Ensuite, récupérez ou enregistrez le modèle au format supporté par votre installation Ollama, et testez-le directement.

Un test local minimal :

ollama run VOTRE_MODELE_DEEPSEEK

Si vous l'exposez via l'API Ollama, testez d'abord cette API directement.

Testez avec un prompt métier, pas un prompt simpliste

C'est un point souvent sous-estimé.

De nombreux déploiements d'IA privée sont déclarés "opérationnels" parce que quelqu'un a demandé à l'endpoint de dire bonjour, de résumer un paragraphe ou d'écrire une blague. Cela ne vous dit presque rien sur l'utilité réelle du système pour le travail interne qui vous importe.

Si votre objectif est l'analyse de données, le test le plus pertinent consiste à utiliser le type de prompt que vos équipes finance, opérations ou reporting IA utiliseraient réellement.

Par exemple :

J'ai un tableau de ventes hebdomadaires avec des colonnes pour la région, le commercial, le chiffre d'affaires, les unités et la marge.

Identifie les régions les moins performantes, les commerciaux dont la marge baisse, et recommande trois graphiques pour une synthèse destinée à la direction.

Ce type de test est bien plus révélateur. Il vous indique si le modèle est simplement "en vie" ou s'il est capable de soutenir une analyse de données interne de manière réellement utile pour l'entreprise.

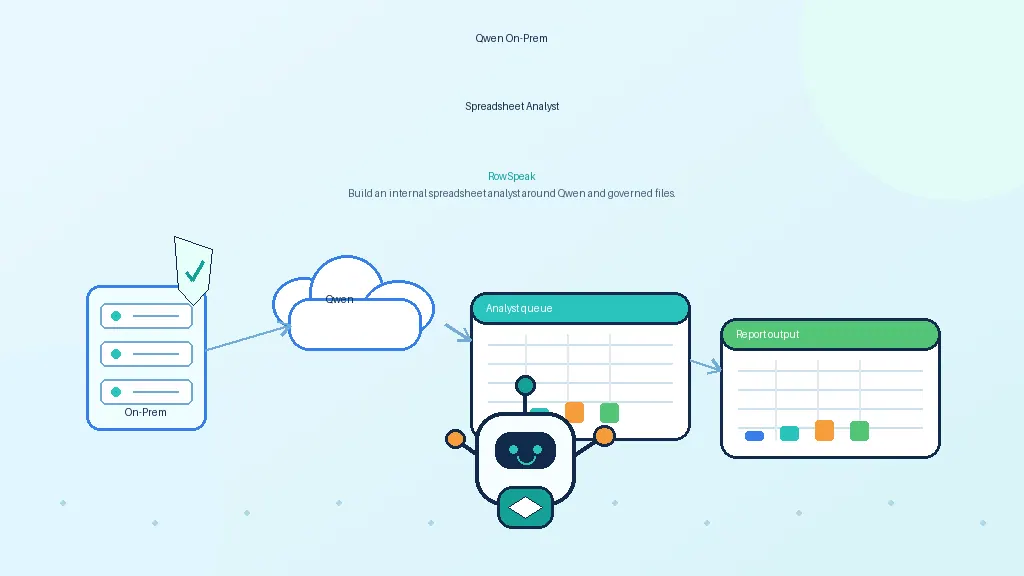

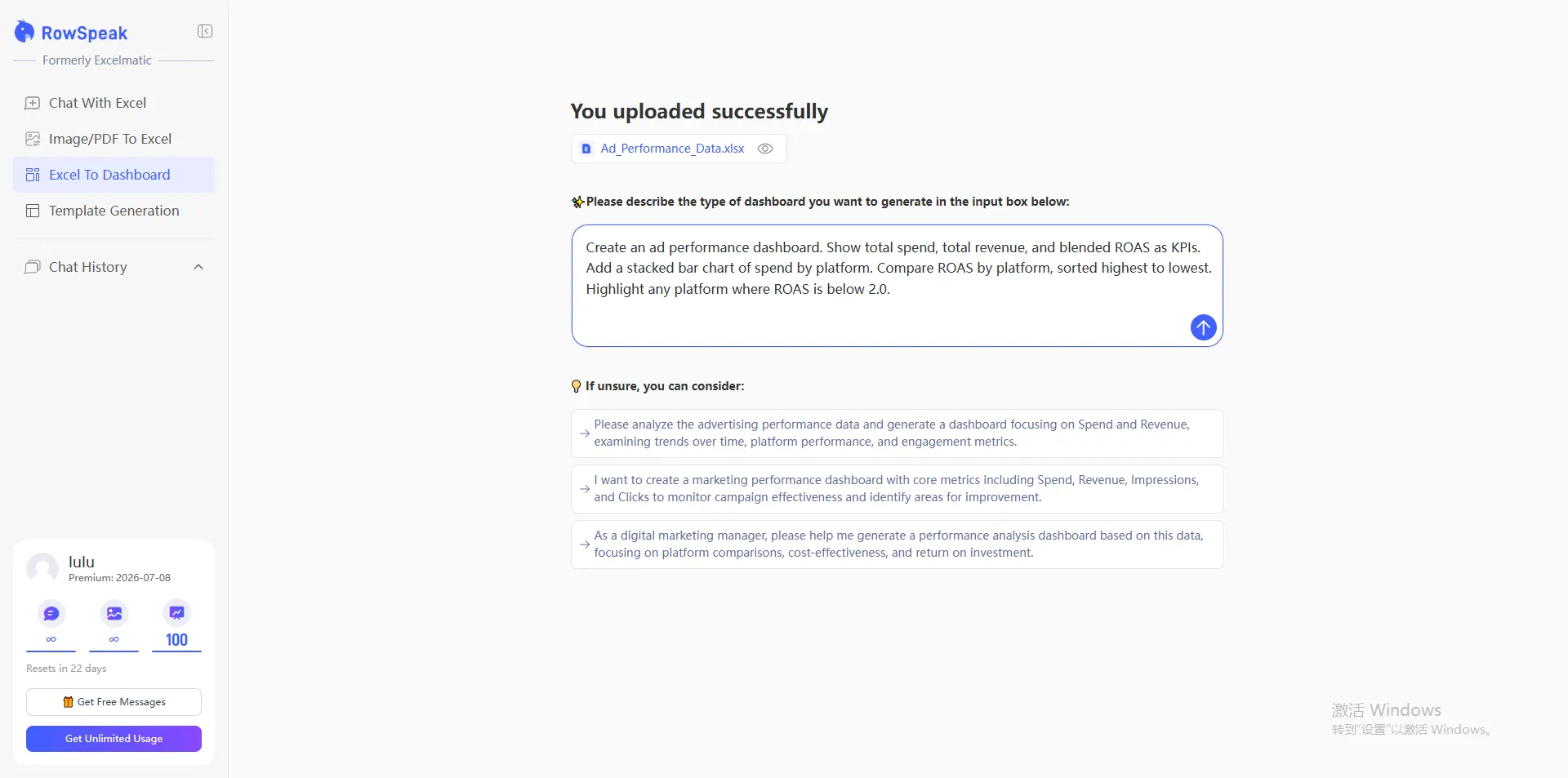

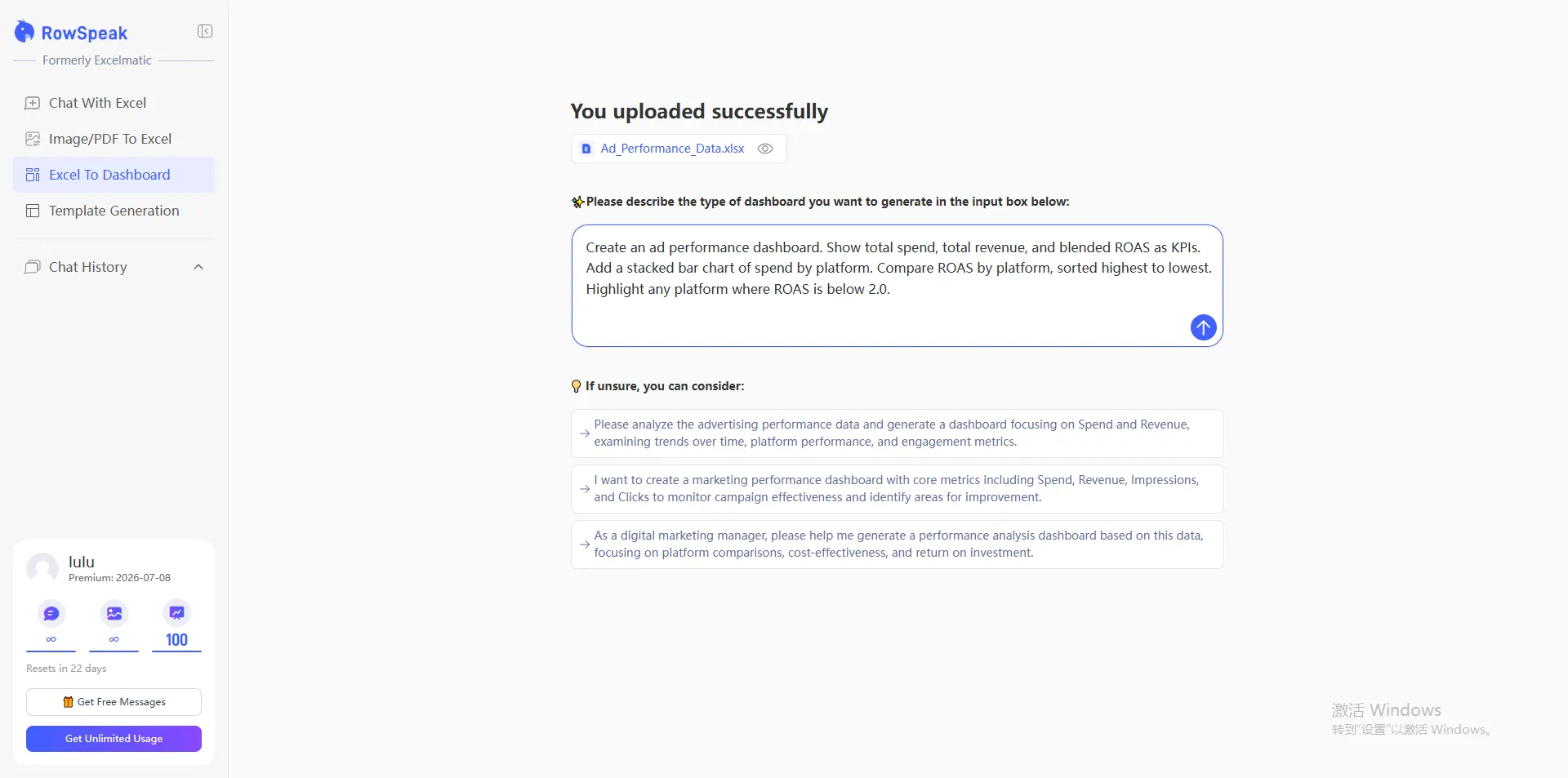

Le rôle de RowSpeak

Une fois que l'endpoint du modèle privé fonctionne, RowSpeak devient la couche qui rend l'ensemble du système utilisable par les équipes.

Au lieu de forcer les utilisateurs à penser en termes de requêtes d'inférence brutes, RowSpeak leur offre un flux de travail structuré autour des fichiers et des tâches d'analyse de données.

Cela signifie qu'ils peuvent :

- Télécharger des feuilles de calcul.

- Poser des questions d'analyse en langage naturel.

- Générer des résumés.

- Créer des sorties orientées graphiques.

- Traiter des données métier complexes plus naturellement.

C'est l'idée centrale de cet article :

La valeur n'est pas de "discuter avec un CSV".

La valeur réside dans la capacité à prendre des données internes complexes, à les router via un serveur d'IA privé que vous contrôlez, et à transformer les résultats en livrables exploitables pour le reporting généré par IA, l'aide à la décision et les workflows internes.

![]()

Validation finale : ce qui compte vraiment

Avant de considérer le déploiement comme terminé, vérifiez les points cruciaux pour un déploiement interne réel :

- L'endpoint reste-t-il stable sous des requêtes répétées ?

- La latence est-elle acceptable pour un usage interne réel ?

- Le nom du modèle est-il correctement configuré dans l'application ?

- Les règles réseau et les contrôles d'accès sont-ils corrects ?

- Les analyses et les graphiques générés sont-ils réellement utiles sur des tâches de tableur réelles ?

Ce dernier point est celui que l'on oublie trop souvent.

Un déploiement d'IA privée n'est pas réussi simplement parce que le serveur tourne. Il est réussi quand les utilisateurs internes peuvent compter sur lui pour leur travail quotidien sur les données, sans envoyer d'informations sensibles hors de votre environnement.

![]()

L'essentiel à retenir

DeepSeek-V4-Flash est désormais officiel, public et en poids ouverts. Si vous souhaitez exploiter une IA privée pour l'analyse interne de données, la voie la plus propre consiste à le déployer sur votre propre serveur GPU avec vLLM (ou Ollama selon vos besoins), à vérifier l'API avec des prompts métier, puis à connecter une couche de workflow comme RowSpeak.

Ensuite, dans vos variables d'environnement, réglez orchestrator_model=deepseek-v4-flash. Vous pourrez alors utiliser RowSpeak pour l'analyse de données interne et la génération de graphiques sans jamais faire transiter votre travail par une API de modèle publique.

FAQ

DeepSeek-V4-Flash est-il adapté aux déploiements d'IA privée ?

Oui, si votre objectif est de faire tourner un modèle performant dans votre propre environnement pour des cas d'usage internes comme l'analyse de données, le support au reporting ou les workflows opérationnels. Les équipes choisissent DeepSeek-V4-Flash car il offre une option de modèle puissante sans exposer les données sensibles à une API publique.

Dois-je utiliser vLLM ou Ollama pour un déploiement interne ?

Pour un serveur d'IA interne de type production, privilégiez vLLM. Pour une preuve de concept rapide ou un déploiement local plus simple, Ollama peut convenir. En pratique, beaucoup d'équipes utilisent Ollama pour l'exploration et vLLM pour l'opérationnalisation.

Que dois-je tester avant de valider le déploiement ?

Ne vous contentez pas d'une réponse du serveur. Testez la stabilité de l'endpoint, la latence, la validité des contrôles d'accès et l'utilité réelle des résultats sur des tâches d'analyse de données concrètes provenant de vos équipes finance ou opérations.

S'agit-il vraiment d'analyse de données ou juste de chat généraliste ?

Pour la plupart des entreprises, la valeur ne réside pas dans le chat générique. Elle réside dans l'utilisation d'un serveur d'IA privé pour aider les équipes à traiter des feuilles de calcul, des exports CSV et des rapports structurés sans que ces données ne quittent l'environnement de l'entreprise.

Quelle est la place de RowSpeak dans cette architecture ?

RowSpeak est la couche de workflow située au-dessus de l'endpoint du modèle privé. Au lieu de demander aux utilisateurs d'interagir avec une API brute, il propose une interface dédiée aux tableurs pour les téléchargements, les questions, les résumés et la création de graphiques.

Besoin d'un déploiement privé pour votre équipe ?

Si vous souhaitez utiliser l'IA pour l'analyse interne de données sans envoyer d'informations sensibles vers une API publique, RowSpeak peut vous aider à transformer un modèle auto-hébergé en un workflow interne opérationnel.

Une configuration entreprise type peut inclure :

- Des options de déploiement privé ou sur site (on-premise).

- La connexion à votre propre endpoint de modèle.

- Des flux de travail d'analyse dédiés aux feuilles de calcul.

- Un support pour les équipes finance, opérations et reporting.

- Des contrôles alignés sur vos exigences de sécurité des données internes.

Si vous évaluez un déploiement d'IA privée et recherchez une solution concrète — pas seulement une démo de modèle — contactez RowSpeak pour discuter de votre projet.