De nombreuses équipes se posent aujourd'hui une question simple : est-il possible d'utiliser Llama pour analyser des feuilles de calcul sans envoyer de fichiers confidentiels à un service d'IA public ?

La réponse courte est oui, mais avec une nuance importante. Llama peut servir de couche de raisonnement au sein d'un système privé d'analyse de données, mais il ne doit pas être considéré comme le système complet.

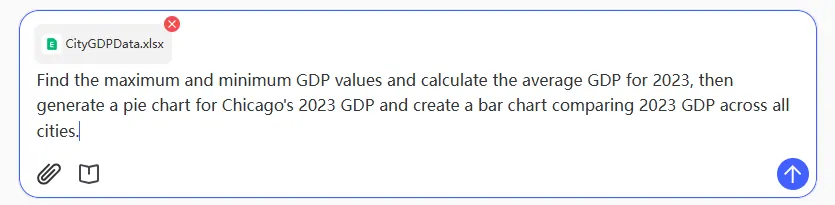

Un modèle peut expliquer des tendances, générer des formules, écrire du SQL, suggérer des graphiques et transformer des questions métier complexes en un plan d'action. Cependant, le travail sur les feuilles de calcul en entreprise nécessite également l'analyse de classeurs, des calculs déterministes, des vérifications de permissions, des journaux d'audit et un workflow que les équipes financières ou opérationnelles peuvent réellement utiliser.

Cette distinction est cruciale. La plupart des projets pilotes d'IA sur tableurs échouent parce que l'équipe demande au modèle d'être à la fois la base de données, le calculateur, la couche de sécurité et l'analyste.

Pourquoi les entreprises s'intéressent à Llama pour l'analyse de feuilles de calcul

Llama est attractif car il peut être déployé dans des environnements contrôlés par l'entreprise. Meta maintient des dépôts officiels Llama sur GitHub, et les modèles Llama sont largement supportés par les infrastructures d'inférence auto-hébergées.

Pour une entreprise manipulant des données sensibles, cela ouvre une voie intéressante :

- Exécuter le modèle dans un VPC privé ou un environnement sur site (on-prem).

- L'exposer via une API interne.

- Conserver les classeurs dans un stockage approuvé.

- Éviter les copier-coller sauvages dans des chatbots publics.

- Construire un analyste IA interne qui respecte les règles de l'entreprise.

Les cas d'utilisation sont généralement concrets et non expérimentaux.

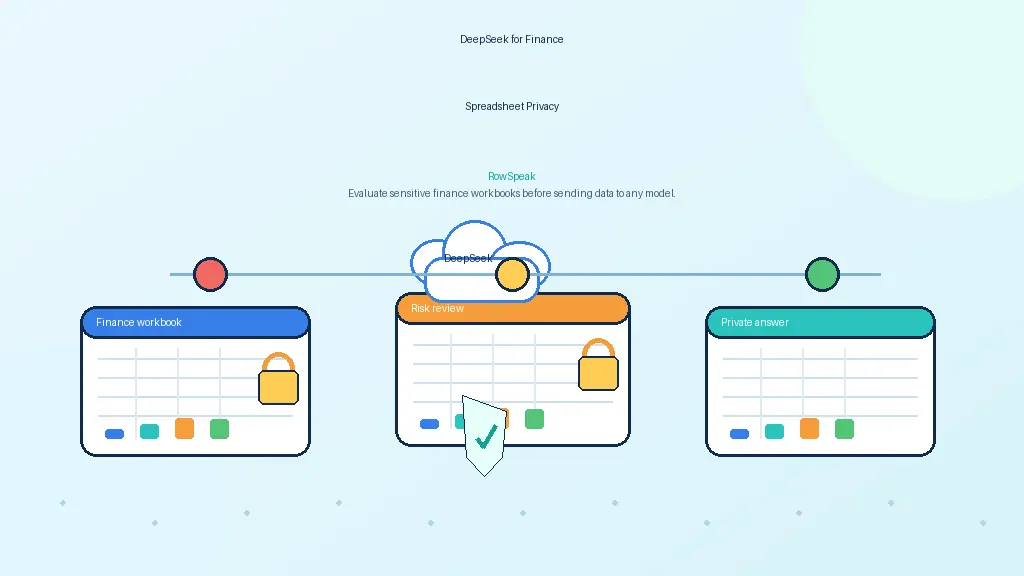

Une équipe finance veut comprendre pourquoi la marge brute a varié par région. Une équipe des opérations commerciales souhaite résumer les changements de pipeline à partir d'un export hebdomadaire. Une équipe de reporting a besoin d'un projet de commentaire avant une réunion de direction. Ce sont précisément les types de workflows où l'IA peut faire gagner du temps, mais où l'exposition des données est un enjeu majeur.

Ce que Llama fait bien

Pour l'analyse de feuilles de calcul, Llama est utile lorsque la tâche implique du langage, du raisonnement ou de la planification de workflow.

Il peut aider à :

- Interpréter la question d'un utilisateur en langage naturel.

- Identifier les colonnes et les métriques pertinentes.

- Générer des formules Excel ou du SQL.

- Expliquer un écart ou une tendance.

- Suggérer des graphiques pour un rapport.

- Synthétiser les résultats d'un calcul.

- Rédiger des commentaires de gestion.

- Transformer une question vague en un plan d'analyse structuré.

Par exemple, un utilisateur pourrait demander :

Quelle catégorie de produits a causé la baisse de marge au dernier trimestre, et quel graphique devrais-je utiliser dans le rapport de direction ?

Un bon système d'IA peut utiliser Llama pour interpréter la requête, décider quels champs sont importants, appeler un outil de calcul et expliquer le résultat en langage clair.

L'expression clé ici est « appeler un outil de calcul ».

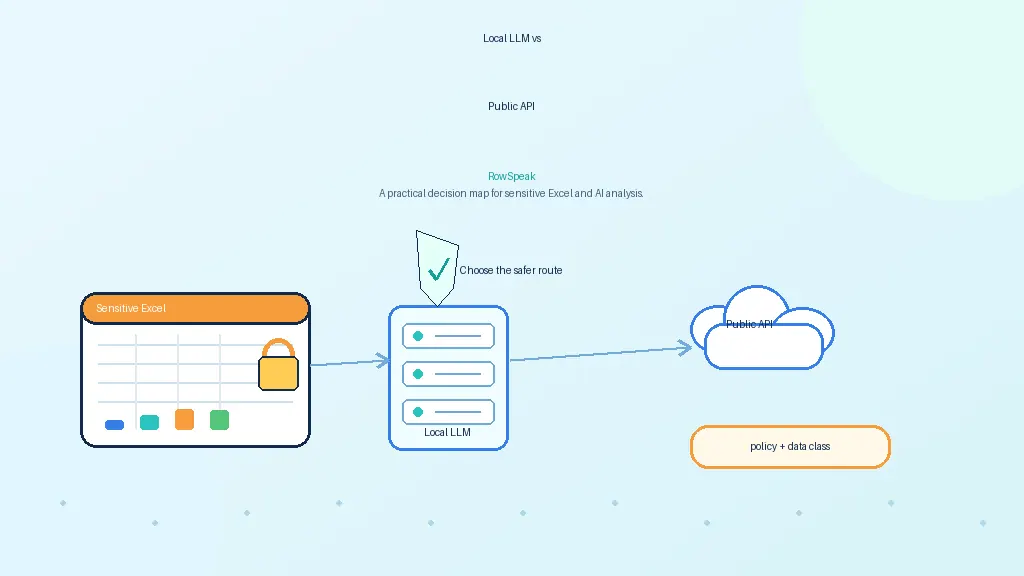

Ce que Llama ne doit pas faire seul

Un système d'analyse ne devrait pas demander à Llama de calculer des totaux en lisant des milliers de lignes directement dans un prompt. C'est lent, coûteux et peu fiable.

Les LLM peuvent halluciner des chiffres. Ils peuvent ignorer des lignes masquées, confondre des colonnes aux noms similaires ou produire une explication plausible à partir d'un contexte incomplet.

Cela ne rend pas Llama inadapté. Cela signifie que l'architecture doit être honnête sur les forces du modèle.

Utilisez Llama pour la compréhension de l'intention, le raisonnement, la génération de code ou de requêtes, et l'explication. Utilisez des systèmes déterministes pour l'arithmétique et les opérations sur les données.

Ces systèmes déterministes peuvent inclure :

- SQL

- DuckDB

- pandas ou Polars

- Un moteur de formules compatible Excel

- Une couche sémantique BI

- Une requête d'entrepôt de données (warehouse) gouvernée

Le modèle planifie et explique. La couche de calcul exécute.

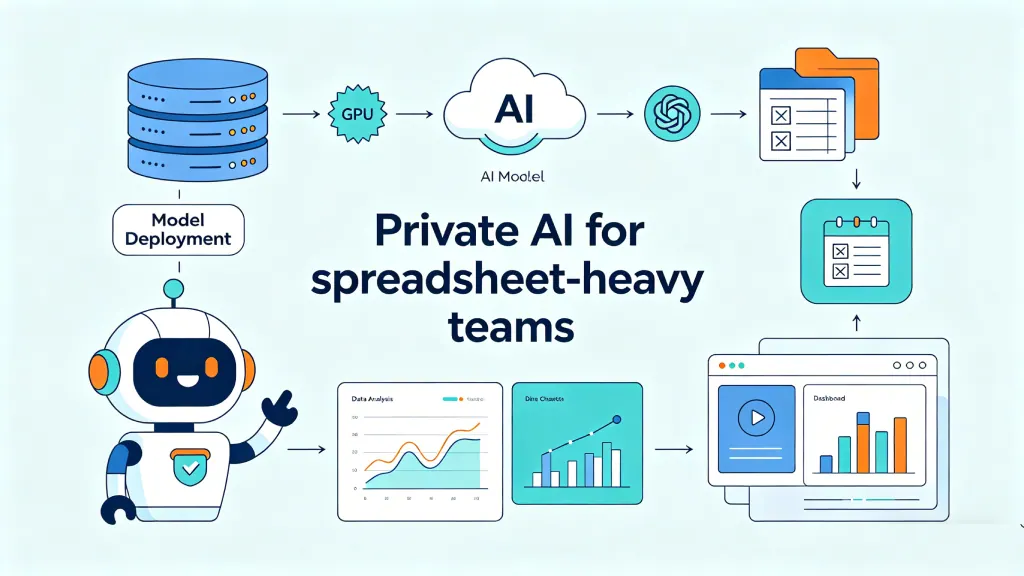

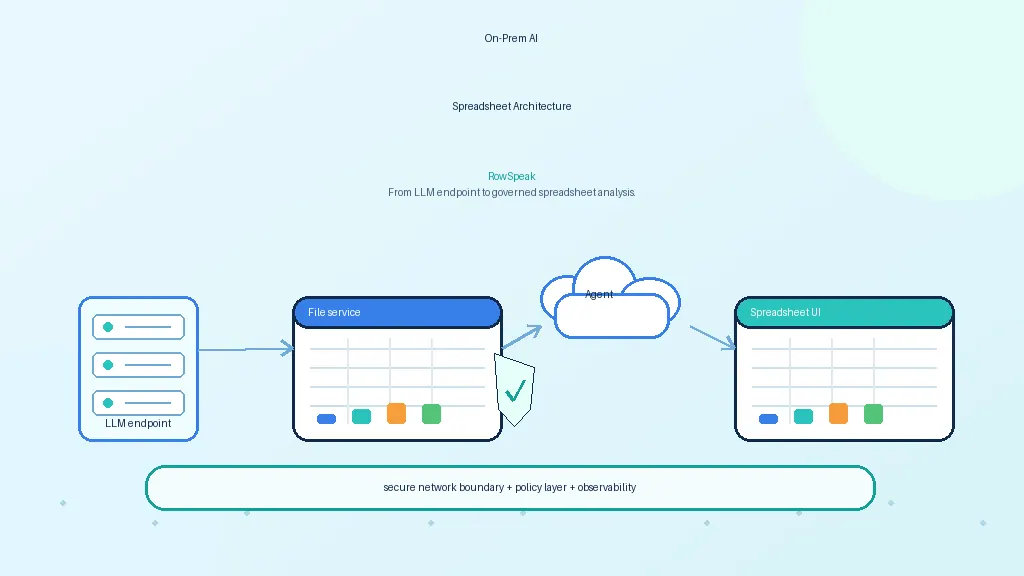

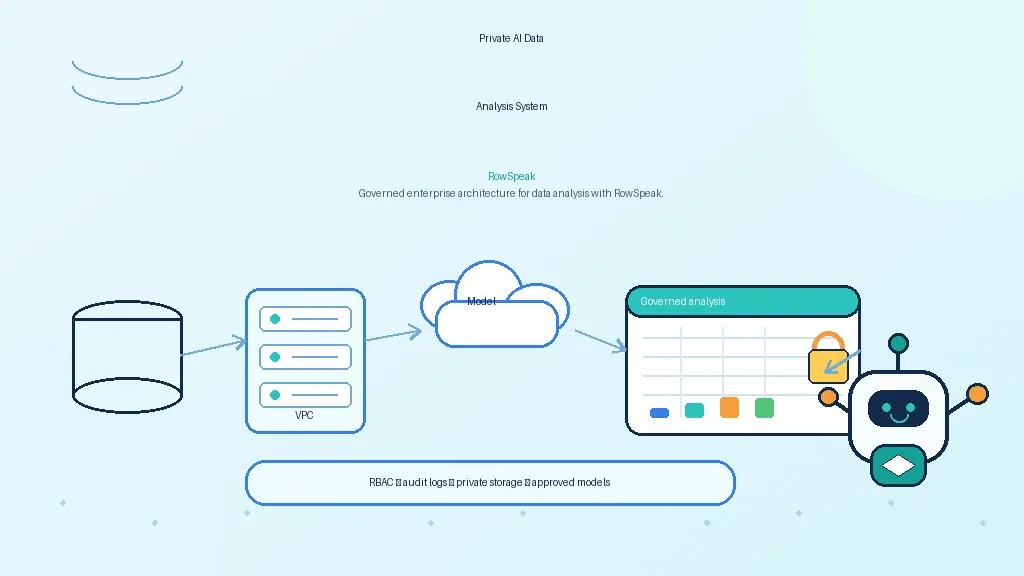

Une architecture privée pratique

Un système privé d'analyse de feuilles de calcul basé sur Llama nécessite généralement ces couches :

Ingestion privée de fichiers

Les classeurs, CSV et exports sont téléchargés dans l'environnement de l'entreprise.Compréhension du classeur

Le système extrait les feuilles, les colonnes, les formules, les plages nommées, les types de données et la structure des tableaux.Couche de calcul

Les calculs sont effectués via SQL, Python, des formules de tableur ou un autre moteur déterministe.Point de terminaison du modèle (Endpoint)

Llama s'exécute via un serveur d'inférence privé.Couche de workflow

Les utilisateurs posent des questions, consultent les résultats, créent des graphiques et génèrent des rapports sans appeler directement l'API du modèle.Couche de gouvernance

Le système applique les permissions, journalise l'accès aux données, contrôle la rétention et enregistre quelle réponse a été produite à partir de quelles données.

C'est pourquoi le modèle seul ne suffit pas. Llama est puissant, mais les utilisateurs métier ne veulent pas d'un simple endpoint /v1/chat/completions. Ils veulent une expérience d'analyste.

vLLM, Ollama ou llama.cpp ?

Le choix du moteur d'exécution dépend de l'état d'avancement du projet.

Ollama est idéal pour les tests locaux et les prototypes rapides. Il est facile à lancer et parfait pour valider les prompts et les idées de workflow.

vLLM est plus adapté lorsque l'équipe a besoin d'un service GPU en production, de traitement par lots (batching) et d'une API compatible OpenAI. Le projet vLLM documente un serveur compatible OpenAI, ce qui facilite la connexion de l'infrastructure de service de modèles aux couches applicatives.

llama.cpp est utile pour l'inférence locale quantifiée, les expérimentations sur CPU ou Apple Silicon, et les environnements contraints.

Pour l'analyse de feuilles de calcul en entreprise, le parcours classique est simple : prototyper avec Ollama, valider le workflow, puis passer à vLLM ou une autre pile de production pour le déploiement interne sérieux.

Le problème de la précision est soluble, à condition de bien concevoir le système

La précision de l'IA appliquée aux tableurs ne provient pas d'une demande de « prudence » accrue au modèle, mais de son ancrage dans des outils et des preuves tangibles.

Un analyste privé de feuilles de calcul devrait :

- Inspecter le schéma avant de répondre.

- Poser des questions de clarification lorsque les colonnes sont ambiguës.

- Exécuter les calculs en dehors du modèle.

- Retourner des références aux lignes, feuilles ou requêtes sources.

- Afficher des tableaux intermédiaires si nécessaire.

- Séparer les faits de l'interprétation.

- Conserver un journal des formules, SQL ou code générés.

Cela rend la réponse vérifiable. Un analyste financier peut voir d'où vient le chiffre. Une équipe informatique peut voir quelles données ont été consultées. Un manager peut faire confiance au processus plutôt qu'à un résumé opaque.

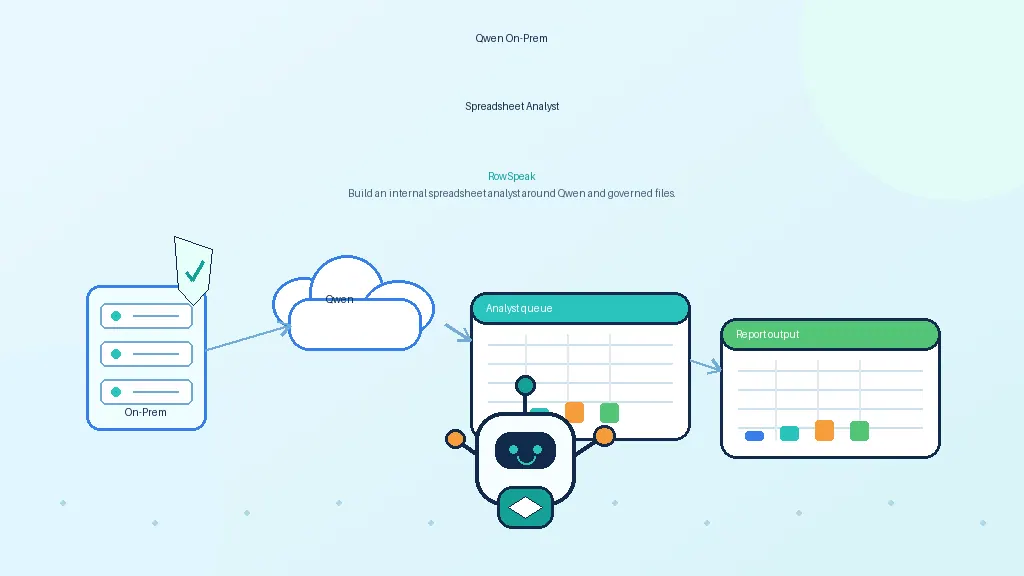

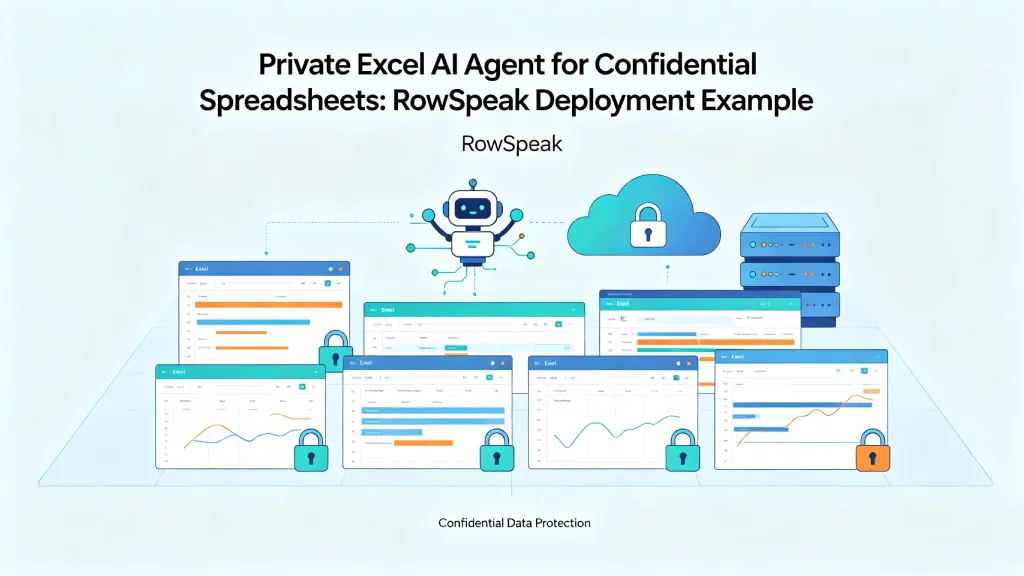

La place de RowSpeak

RowSpeak n'est pas destiné à remplacer Llama. Il se positionne au-dessus de modèles comme Llama en tant que couche de workflow d'assistant tableur.

Dans un déploiement privé, le modèle fournit le raisonnement. RowSpeak fournit l'expérience autour de ce raisonnement : télécharger un tableur, poser des questions en langage naturel, exécuter une analyse de données par IA, créer des graphiques et produire des explications prêtes pour les rapports.

C'est dans cette couche que réside une grande partie de la valeur pour l'entreprise. Elle gère les aspects complexes qu'un simple endpoint de modèle ne résout pas : structure du classeur, workflow utilisateur, ancrage des calculs et résultats orientés métier.

Pour les entreprises évaluant Llama, la question stratégique n'est pas seulement « Pouvons-nous exécuter le modèle ? », mais plutôt « Pouvons-nous transformer ce modèle en un analyste de données gouverné que nos équipes utiliseront réellement ? »

Checklist avant de piloter Llama pour l'analyse privée de tableurs

Avant de commencer, répondez à ces questions :

- Quels types de feuilles de calcul les utilisateurs vont-ils analyser ?

- Y a-t-il des feuilles masquées, des formules, des pivots ou plusieurs fichiers liés ?

- Quelles données sont confidentielles ou réglementées ?

- Où les fichiers seront-ils stockés ?

- Quel moteur d'exécution (runtime) servira le modèle ?

- Quel moteur effectuera les calculs ?

- Comment les résultats citeront-ils les lignes, cellules ou requêtes sources ?

- Comment l'accès sera-t-il journalisé ?

- Qui peut voir les fichiers téléchargés et les rapports générés ?

- Quelle est la solution de repli lorsque le modèle est incertain ?

Si ces points sont clairs, Llama peut devenir une base solide pour l'analyse privée de feuilles de calcul et les tâches répétitives comme le reporting périodique sur tableur. Si ces points sont ignorés, le projet restera une simple démonstration de chatbot.

Sources et lectures complémentaires

- GitHub Meta Llama : https://github.com/meta-llama

- Serveur vLLM compatible OpenAI : https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Bibliothèque de modèles Ollama : https://ollama.com/library

- llama.cpp : https://github.com/ggml-org/llama.cpp