許多團隊目前都在問一個簡單的問題:我們能否在不將機密文件傳送到公開 AI 服務的情況下,使用 Llama 來分析試算表?

簡短的回答是:可以,但有一個重要前提。Llama 可以作為私有試算表分析系統內部的推理層,但不應將其視為整個系統。

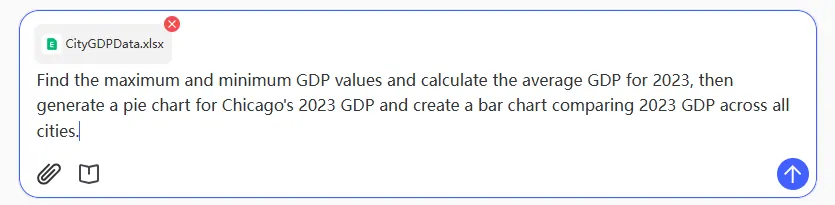

模型可以解釋趨勢、生成公式、編寫 SQL、建議圖表,並將雜亂的業務問題轉化為執行計畫。但企業級的試算表工作還需要活頁簿解析、確定性計算、權限檢查、稽核日誌,以及一般財務或營運團隊真正能使用的使用者工作流。

這種區分至關重要。大多數 AI 試算表試點項目之所以失敗,是因為團隊要求模型同時擔任資料庫、計算機、安全層和分析師的角色。

為什麼企業對使用 Llama 進行試算表分析感興趣

Llama 的吸引力在於它可以在公司控制的環境中運行。Meta 在 GitHub 上維護官方 Llama 儲存庫,且 Llama 模型在各種自託管推論堆疊中得到廣泛支援。

對於擁有敏感試算表資料的公司來說,這開啟了一條實用的路徑:

- 在私有 VPC 或地端(On-prem)環境中執行模型

- 透過內部 API 提供服務

- 將活頁簿保留在核准的儲存空間內

- 避免將資料隨意複製貼上到公開聊天機器人

- 建立一個遵循公司規則的內部 AI 分析師

這些使用場景通常是務實的,而非實驗性質。

財務團隊想知道為什麼各區域的毛利發生了變化;銷售營運團隊想從每週匯出的資料中總結管道(Pipeline)變化;報告團隊希望在管理會議前從活頁簿中獲得評論草稿。這些正是 AI 可以節省時間的工作流,但同時也是資料外洩風險極高的場景。

Llama 擅長什麼

在試算表分析中,當任務涉及語言、推理或工作流規劃時,Llama 非常有用。

它可以協助:

- 解讀使用者的自然語言問題

- 識別可能的欄位和指標

- 生成 Excel 公式或 SQL

- 解釋差異(Variance)或趨勢

- 為報告建議圖表

- 總結計算結果

- 起草管理評論

- 將模糊的問題轉化為結構化的分析計畫

例如,使用者可能會問:

上一季哪個產品類別導致毛利下降?我應該在主管報告中使用什麼圖表?

一個優秀的 AI 系統可以使用 Llama 來解讀請求、決定哪些欄位重要、調用計算工具,並用通俗易懂的語言解釋結果。

關鍵字在於「調用計算工具」。

Llama 不應單獨處理的事項

試算表模型不應要求 Llama 透過閱讀提示詞(Prompt)中的數千行資料來計算總計。這樣做既緩慢、昂貴且不可靠。

大型語言模型(LLM)可能會產生數字幻覺。它們可能會遺漏隱藏行,混淆名稱相似的欄位,或者根據不完整的上下文給出看似合理的解釋。

這並不代表 Llama 不適用,而是意味著架構必須誠實地面對模型擅長的部分。

使用 Llama 進行意圖理解、推理、程式碼或查詢生成以及解釋。使用確定性系統進行算術和資料運算。

這些確定性系統可能包括:

- SQL

- DuckDB

- pandas 或 Polars

- 相容 Excel 的公式引擎

- BI 語義層

- 受控的倉儲查詢

模型負責計畫與解釋,運算層負責計算。

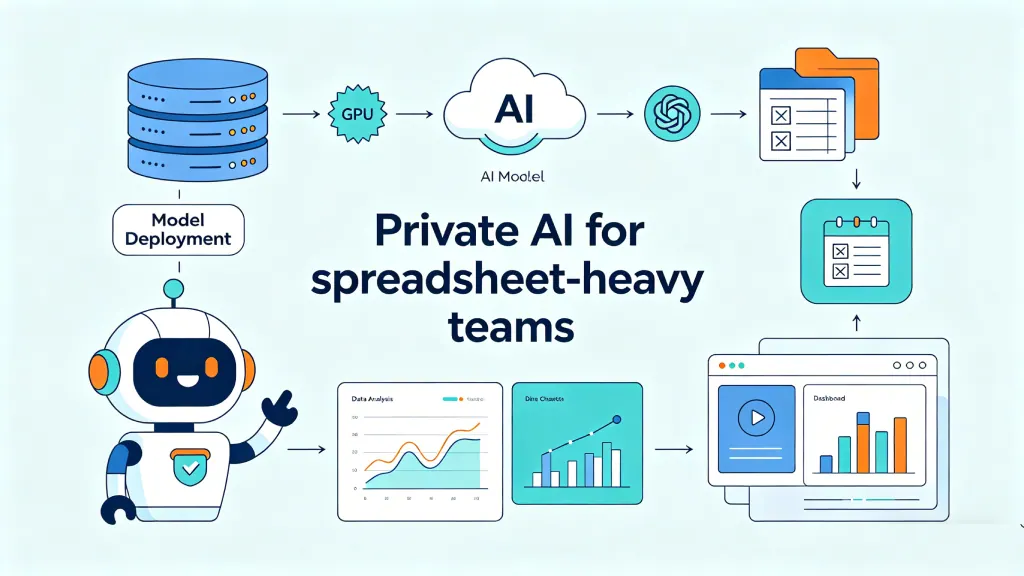

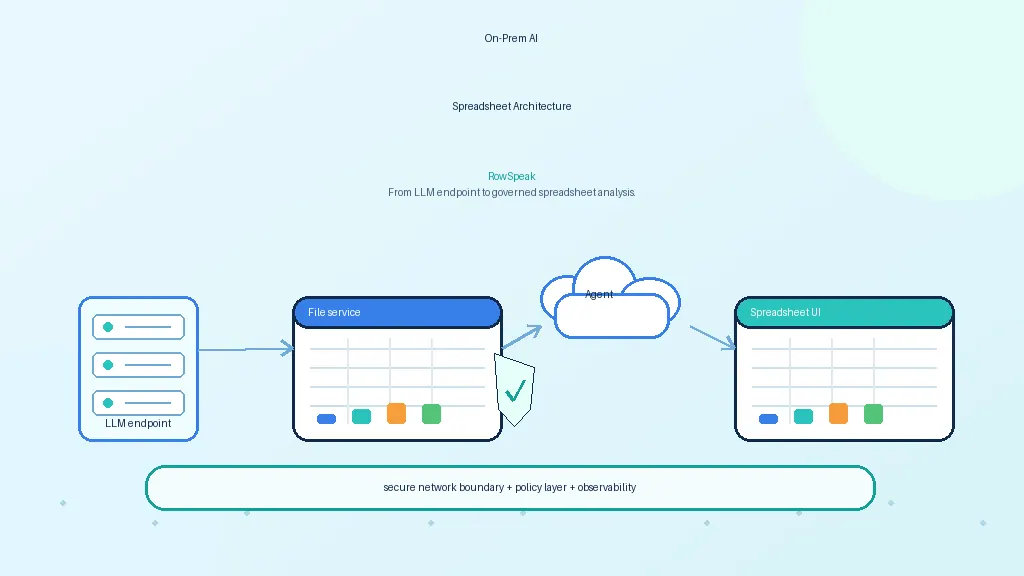

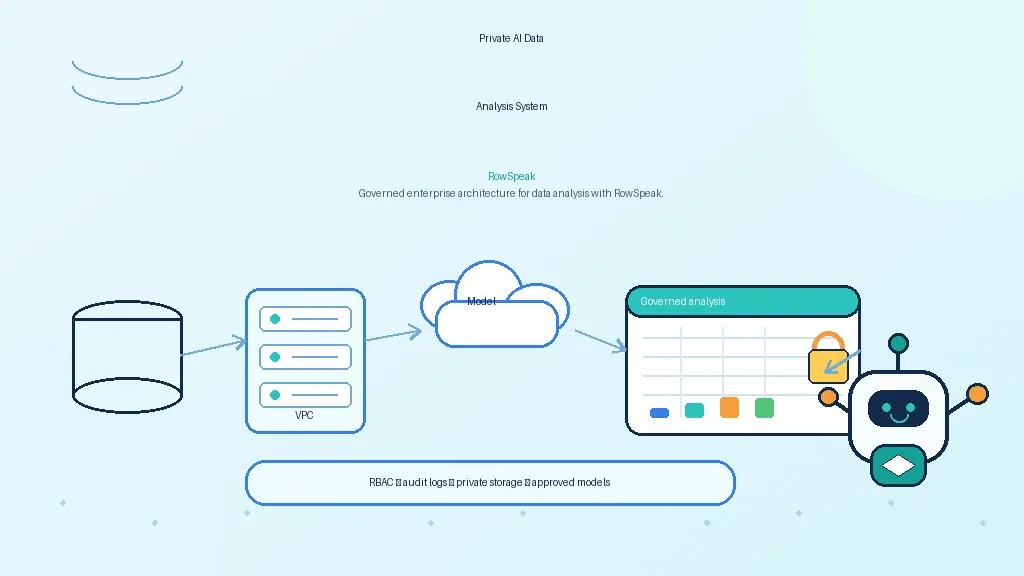

實用的私有架構

一個私有的 Llama 試算表系統通常需要以下層級:

- 私有檔案攝取 活頁簿、CSV 和匯出檔案上傳至公司環境內部。

- 活頁簿理解 系統提取工作表、欄位、公式、具名範圍、資料類型和表格結構。

- 運算層 透過 SQL、Python、試算表公式或其他確定性引擎執行計算。

- 模型端點 Llama 透過私有推論伺服器執行。

- 工作流層 使用者提出問題、查看輸出、建立圖表並生成報告,而無需直接調用模型 API。

- 治理層 系統強制執行權限、記錄資料存取、控制保留期,並記錄哪個答案是由哪些資料產生的。

這就是為什麼單靠模型是不夠的。Llama 或許強大,但企業使用者需要的不是原始的 /v1/chat/completions 端點,他們需要的是分析師的體驗。

vLLM、Ollama 還是 llama.cpp?

選擇哪種執行環境取決於專案階段。

Ollama 適用於本地測試和快速原型開發。它易於執行,非常適合驗證提示詞和工作流構想。

vLLM 當團隊需要生產級 GPU 服務、批次處理和相容 OpenAI 的 API 時,它是更好的選擇。vLLM 專案提供了相容 OpenAI 的伺服器文件,使模型服務基礎設施更容易連接到應用層。

llama.cpp 適用於量化本地推論、CPU 或 Apple Silicon 實驗以及受限環境。

對於企業試算表分析,常見的路徑很簡單:先用 Ollama 製作原型,驗證工作流,然後將正式的內部部署遷移到 vLLM 或其他生產級服務堆疊。

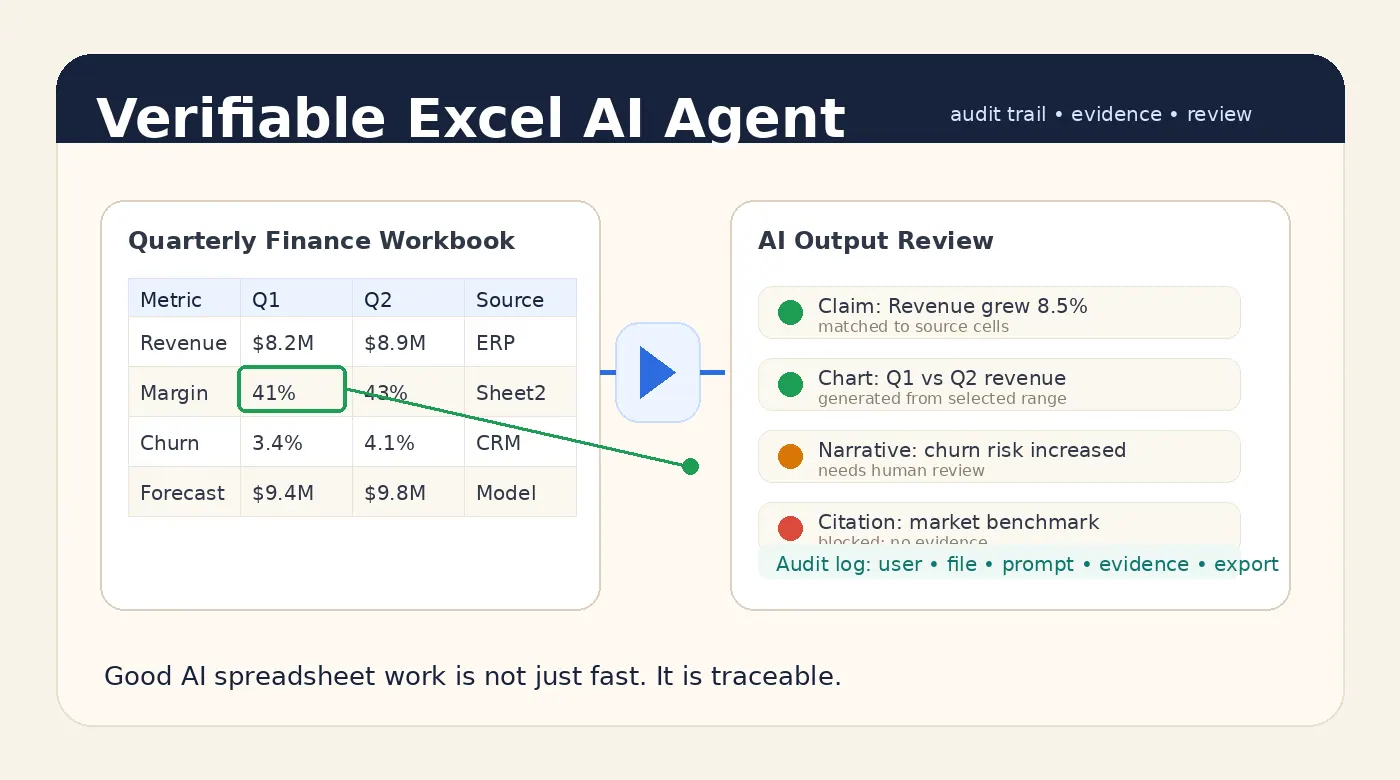

準確性問題是可以解決的,前提是你要有針對性的設計

試算表 AI 的準確性並非來自於要求模型「更細心」,而是來自於將模型錨定(Grounding)在工具和證據中。

一個私有試算表分析師應該:

- 在回答前檢查 Schema(架構)

- 當欄位模糊時提出澄清問題

- 在模型外部執行計算

- 返回資料行、工作表或查詢引用

- 在有用時顯示中間表格

- 將事實與解釋分開

- 保留生成的公式、SQL 或程式碼日誌

這使得答案是可審查的。財務分析師可以看到數字的來源;IT 團隊可以看到存取了哪些資料;管理者可以比信任黑盒總結更信任這個過程。

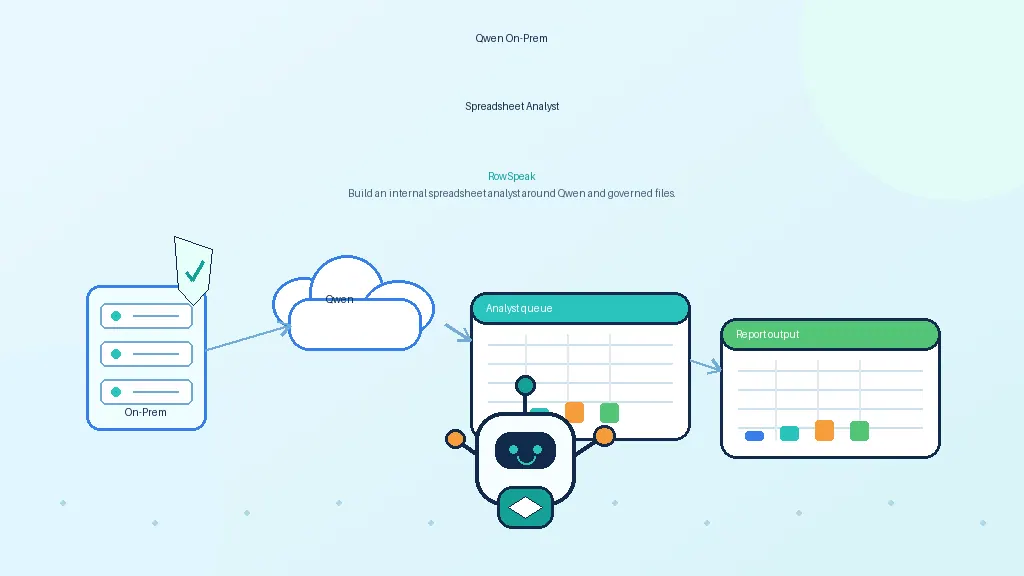

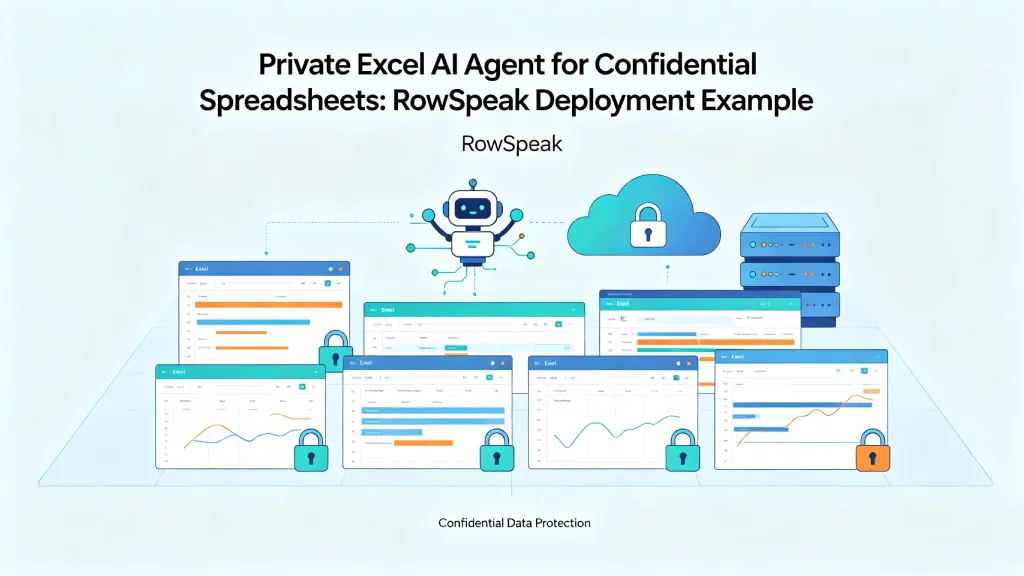

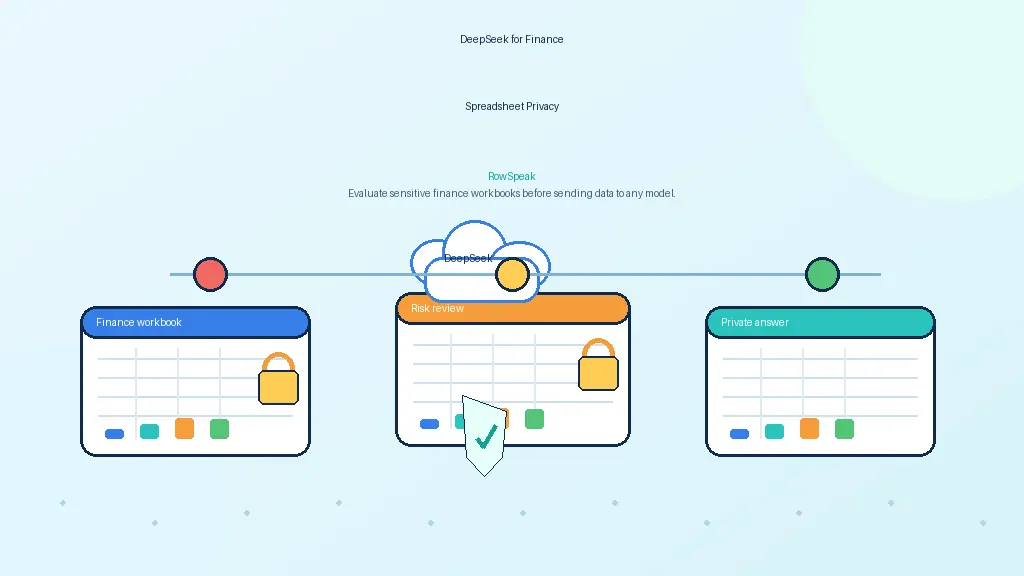

RowSpeak 的定位

RowSpeak 並非旨在取代 Llama。它位於 Llama 等模型之上,作為試算表助手工作流層。

在私有部署中,模型提供推理能力。RowSpeak 則圍繞該推理提供完整體驗:上傳試算表、使用自然語言提問、執行 AI 試算表資料分析、建立圖表並生成可供報告使用的解釋。

這一層正是許多企業價值所在。它處理了原始模型端點無法解決的繁瑣部分:活頁簿結構、使用者工作流、計算錨定以及面向業務的輸出。

對於評估 Llama 的公司來說,策略性問題不僅是「我們能執行這個模型嗎?」,而是「我們能否將這個模型轉化為團隊真正會使用的、受控的試算表分析師?」

試點私有試算表分析 Llama 前的清單

在開始之前,請回答以下問題:

- 使用者將分析哪種類型的試算表?

- 是否有隱藏的工作表、公式、樞紐分析表或多個相關檔案?

- 哪些資料是機密或受監管的?

- 檔案將儲存在哪裡?

- 將使用哪個執行環境來提供模型服務?

- 哪個引擎將執行計算?

- 輸出將如何引用來源行、儲存格或查詢?

- 存取行為將如何記錄?

- 誰可以查看上傳的檔案和生成的報告?

- 當模型不確定時,備案計畫是什麼?

如果這些問題都有明確答案,Llama 就能成為私有試算表分析和可重複工作(如定期試算表報告)的強大基礎。如果忽視這些問題,專案就只會變成另一個聊天機器人展示。

來源與延伸閱讀

- Meta Llama GitHub: https://github.com/meta-llama

- vLLM OpenAI-compatible server: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Ollama model library: https://ollama.com/library

- llama.cpp: https://github.com/ggml-org/llama.cpp