DeepSeek-V4-Flash 現已正式發布,不僅公開且提供開放權重(open-weight)。

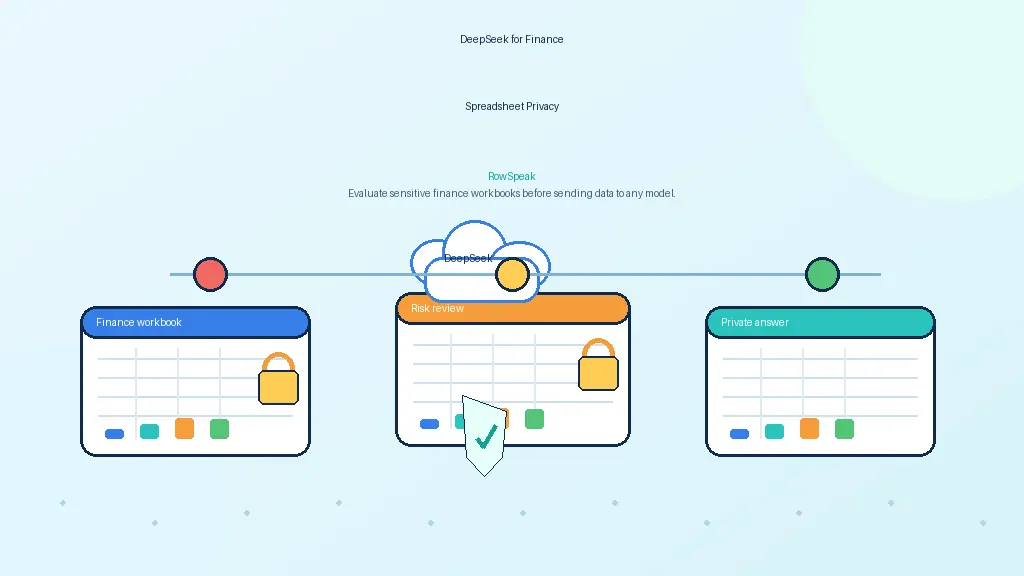

這對於一類特定的用戶來說至關重要:那些希望在不將敏感的試算表數據傳送到外部 API 的情況下,獲得更強大 AI 能力的團隊。

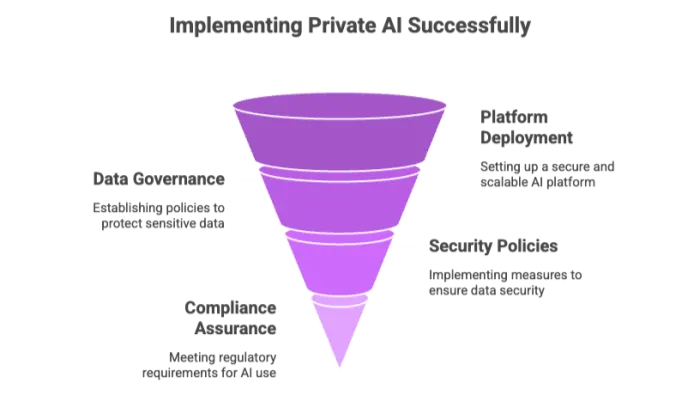

如果你正在評估用於財務報告的私有 AI、營運工作簿、內部數據導出或定期試算表分析,問題已不再僅僅是這類模型能否在你的基礎設施上運行。真正的關鍵在於,你是否能將其轉化為一個安全且員工真正能使用的內部服務。

這篇文章旨在協助你達成這一目標。

具體而言,本文將引導你完成一個用於內部試算表分析的實用私有 AI 設置:

- 在你自己的 GPU 伺服器上運行 DeepSeek-V4-Flash

- 將其封裝為私有推論 API

- 驗證該端點在業務場景提示詞下的運作情況

- 將其連接到像 RowSpeak 這樣的工作流層,讓非技術用戶可以分析試算表數據,而無需處理原始的模型調用

這篇文章並非關於「與模型聊天」,而是關於構建一個能支援真實內部試算表工作流的私有 AI 伺服器。

為什麼團隊需要私有 AI 伺服器來進行試算表分析

當人們談論「自託管」(self-hosting)時,聽起來往往像是某種意識形態。但實際上,其動機通常是出於營運和商業考量。

財務團隊不希望董事會報告的試算表流經公共 API,尤其是當這些文件支援管理報告工作流時。營運團隊不希望內部的追蹤表、營收導出數據和複雜的跨部門工作簿離開其受控環境。而 IT 或安全團隊通常想要更簡單的東西:一個他們可以像控制其他內部系統一樣進行控制、監控、審計和限制的模型端點。

這正是 DeepSeek-V4-Flash 的吸引力所在。

DeepSeek 已迅速成為私有 AI 討論的核心,因為團隊現在將其視為內部 AI 部署的可靠基礎。

它的性能強大到值得部署,且足夠開放,使私有 AI 的落地變得現實。

如果你的使用場景只是休閒聊天,託管 API 可能仍是較簡單的選擇。

但如果你的實際工作負載更接近以下情況:

那麼,私有伺服器的路徑就會顯得更具吸引力。

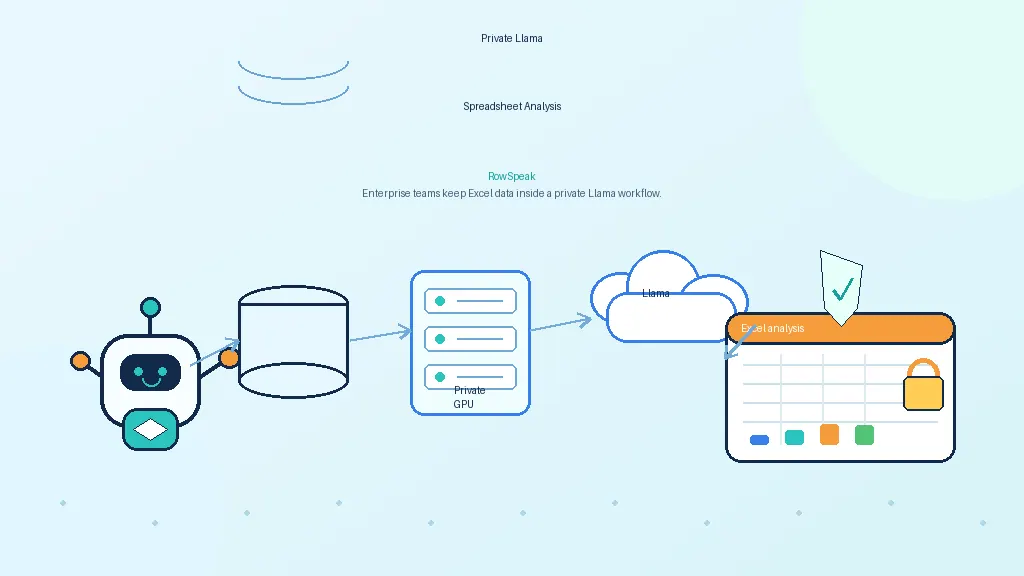

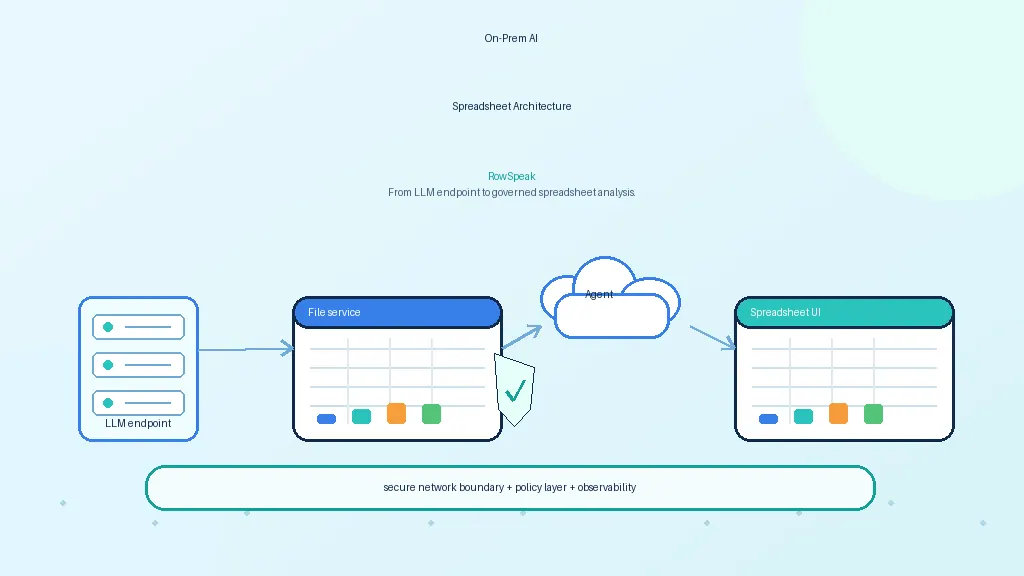

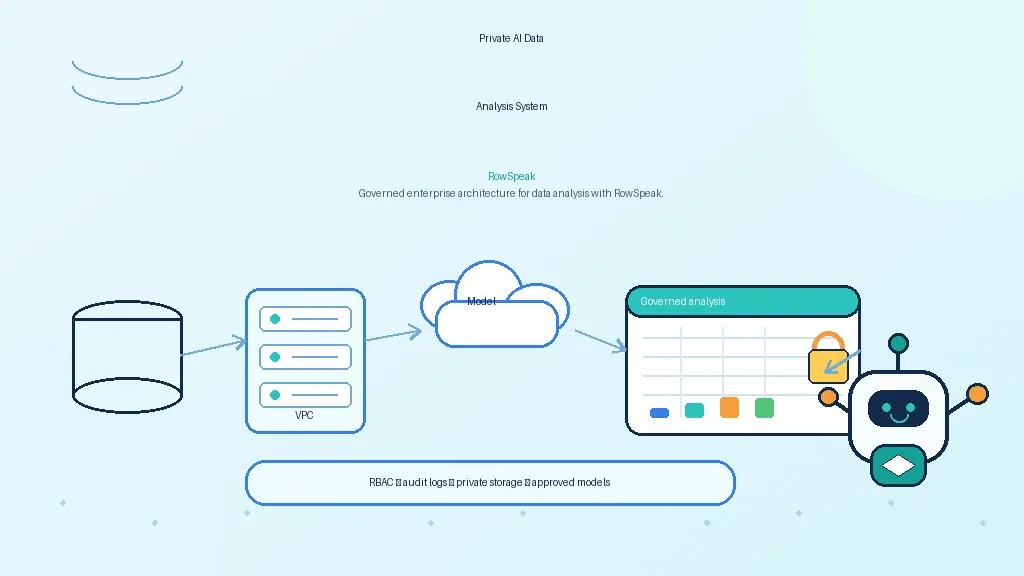

你實際在構建什麼

好消息是,架構本身非常簡單。

你不需要一個龐大的 AI 平台來產生價值。你只需要四個要素:

- 一台受你控制的 GPU 伺服器

- 模型運行環境(Model Runtime)

- 私有 API 端點

- 位於端點之上、供實際用戶使用的工作流層

在這種設置中:

- DeepSeek-V4-Flash 是模型本身

- vLLM 或 Ollama 是服務層(Serving Layer)

- RowSpeak 是工作流層,將模型訪問轉化為試算表分析任務

這種分離至關重要,因為它能讓每一層保持專注。

模型伺服器處理推論。工作流層則處理商業使用的複雜現實:文件上傳、試算表上下文與自然語言提問、摘要生成以及可直接用於圖表的輸出。

哪種部署路徑最合適?

這裡有兩條切實可行的路徑,正確的選擇取決於你打算運行的內部服務類型。

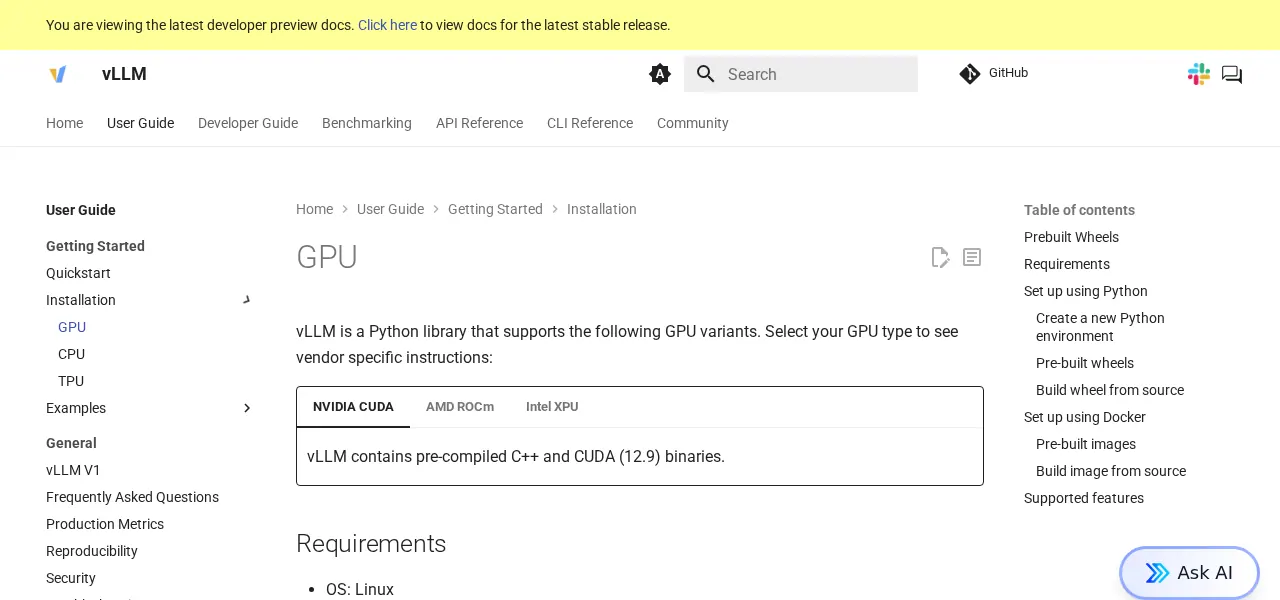

選項 1:vLLM

如果你是為了重複的業務需求而構建嚴謹的內部 AI 端點,我會首推這條路徑。

原因很直接:vLLM 是面向生產環境的服務棧,其與 OpenAI 兼容的 API 讓整合變得更簡潔。如果你的目標是將 DeepSeek-V4-Flash 置於內部試算表分析工作流之後,API 的兼容性和部署控制權就非常重要。

選項 2:Ollama

當模型封裝和運行環境支援符合你的部署需求時,Ollama 是更方便的選擇。

它更容易上手,對於輕量級的內部場景或快速的原型驗證(PoC)來說,是一個明智的選擇。

但如果我必須用一句話總結這個決策,那就是:

當你需要生產級別的私有 AI 伺服器時,請使用 vLLM;當速度和簡便性比基礎設施控制更重要時,請使用 Ollama。

開始之前:檢查伺服器,而不僅僅是想法

你具體需要的硬體取決於你選擇的 DeepSeek-V4-Flash 模型版本、所需的精度(Precision)、上下文長度以及預期的併發量。

這就是為什麼通用的「你需要 X 張 GPU」建議往往具有誤導性。

更好的方法是從官方模型權重文件出發,根據你實際計劃提供的服務來規劃機器規格。

你的伺服器至少應具備:

- 受控的 Linux 系統

- NVIDIA GPU

- 安裝完善的驅動程式

- 運作正常的 CUDA 環境

- 已安裝 Python

- 足夠容納所選模型版本的 VRAM

在進行任何操作之前,請先執行基本檢查:

nvidia-smi

python3 --version

這聽起來很基礎,但非常值得一做。令人驚訝的是,許多部署問題根本不是模型問題,而是驅動程式、環境配置或簡單的機器準備錯誤。

使用 vLLM 部署

如果你想要最乾淨的「正式部署」路徑,請從這裡開始。

第一步:在乾淨的環境中安裝 vLLM

python3 -m venv .venv

source .venv/bin/activate

pip install --upgrade pip

pip install vllm

實用文檔:

第二步:使用官方 DeepSeek 模型權重

這是一個「走捷徑可能會導致後續大麻煩」的地方。

如果可以,請避免從隨機的鏡像站點開始。請從 DeepSeek 官方發布頁面開始,然後遵循其連結的官方 Hugging Face 集合。

這能確保來源可靠,並降低部署錯誤版本的風險。

DeepSeek 官方發布頁面,宣佈 V4-Flash 作為 DeepSeek V4 預覽版發布的一部分。

第三步:啟動 API 伺服器

典型的 vLLM 啟動命令如下:

python -m vllm.entrypoints.openai.api_server --model deepseek-ai/DeepSeek-V4-Flash --host 0.0.0.0 --port 8000

根據模型版本和機器性能,你可能還需要調整:

- 張量並行(tensor parallelism)

- 數據類型(dtype)

- 最大模型長度(max model length)

- GPU 顯存利用率(GPU memory utilization)

但基本思路是一樣的:啟動模型,暴露端點,並在觸及應用端之前確保服務層穩定。

第四步:像測試 API 一樣測試端點,而非當作 Demo

在連接 RowSpeak 或其他工具之前,請先驗證模型伺服器本身是否能正確回應。

例如:

curl http://YOUR_SERVER_IP:8000/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "deepseek-ai/DeepSeek-V4-Flash",

"messages": [

{"role": "user", "content": "Summarize the benefits of self-hosting an LLM for spreadsheet analysis."}

]

}'

如果伺服器返回了有效的回應,說明核心服務路徑已通。

此時,請克制過度複雜化測試的衝動。你還不需要對整個系統進行基準測試,你只需確認端點已上線、模型加載正確,且 API 的行為符合應用程式的預期。

使用 Ollama 部署

Ollama 是更輕量級的路徑,當封裝匹配時,它是啟動可用部署最快的方式。

重要的是不要將其視為萬能方案。只有當你需要的 DeepSeek 版本能以 Ollama 支援的格式流暢運行時,它才是正確的選擇。

官方文檔:

首先安裝:

curl -fsSL https://ollama.com/install.sh | sh

然後拉取或註冊你的 Ollama 設置支援的模型格式,並在嘗試整合到任何地方之前直接進行測試。

最簡單的本地測試如下:

ollama run YOUR_DEEPSEEK_MODEL

如果你是透過 Ollama API 暴露服務,請先直接測試該 API。

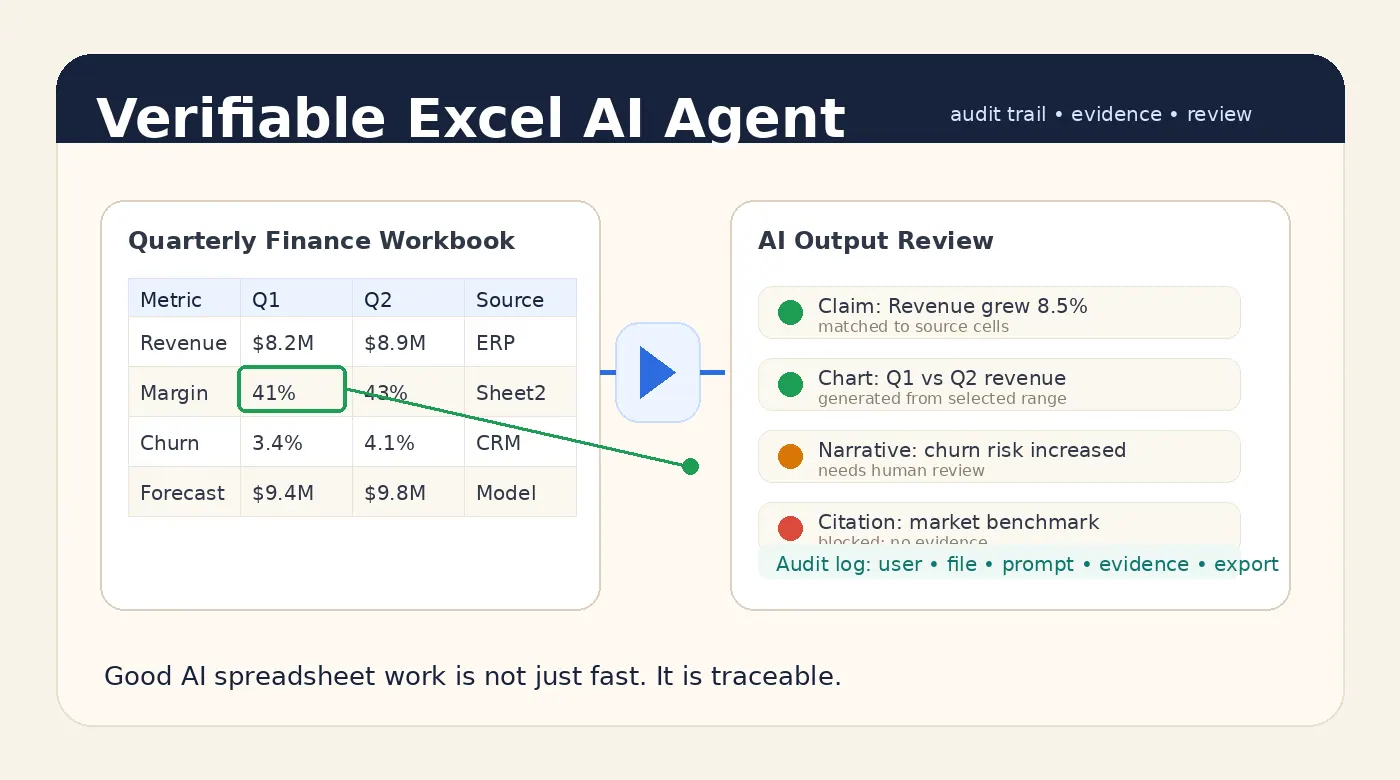

使用業務提示詞測試,而非玩具提示詞

這一部分很容易被低估。

許多私有 AI 部署被宣告「成功」,僅僅是因為有人讓端點打了個招呼、總結了一個段落或寫了個笑話。這幾乎無法告訴你該系統對於你真正關心的內部工作是否有用。

如果你的目標是試算表分析,更聰明的測試是使用財務、營運或 AI 報告團隊真正關心的提示詞。

例如:

我有一份每週銷售試算表,包含地區、業務代表、營收、銷量和毛利等欄位。

請找出表現最差的地區,識別毛利下降的業務代表,並為執行摘要推薦三個圖表。

這類測試更具揭示性。它能告訴你模型是否僅僅是「活著」,還是它能以對業務真正有用的方式支援內部試算表分析。

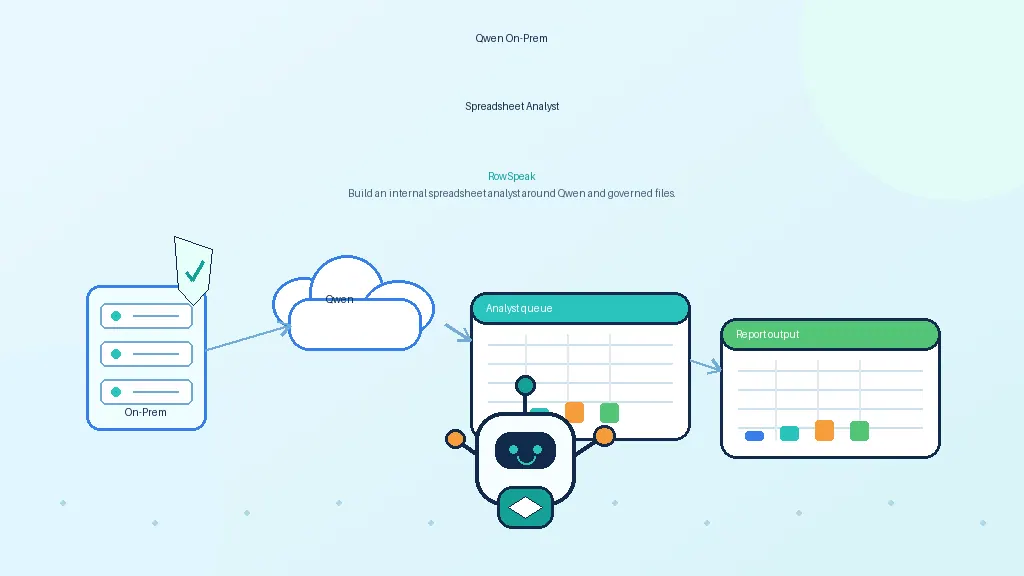

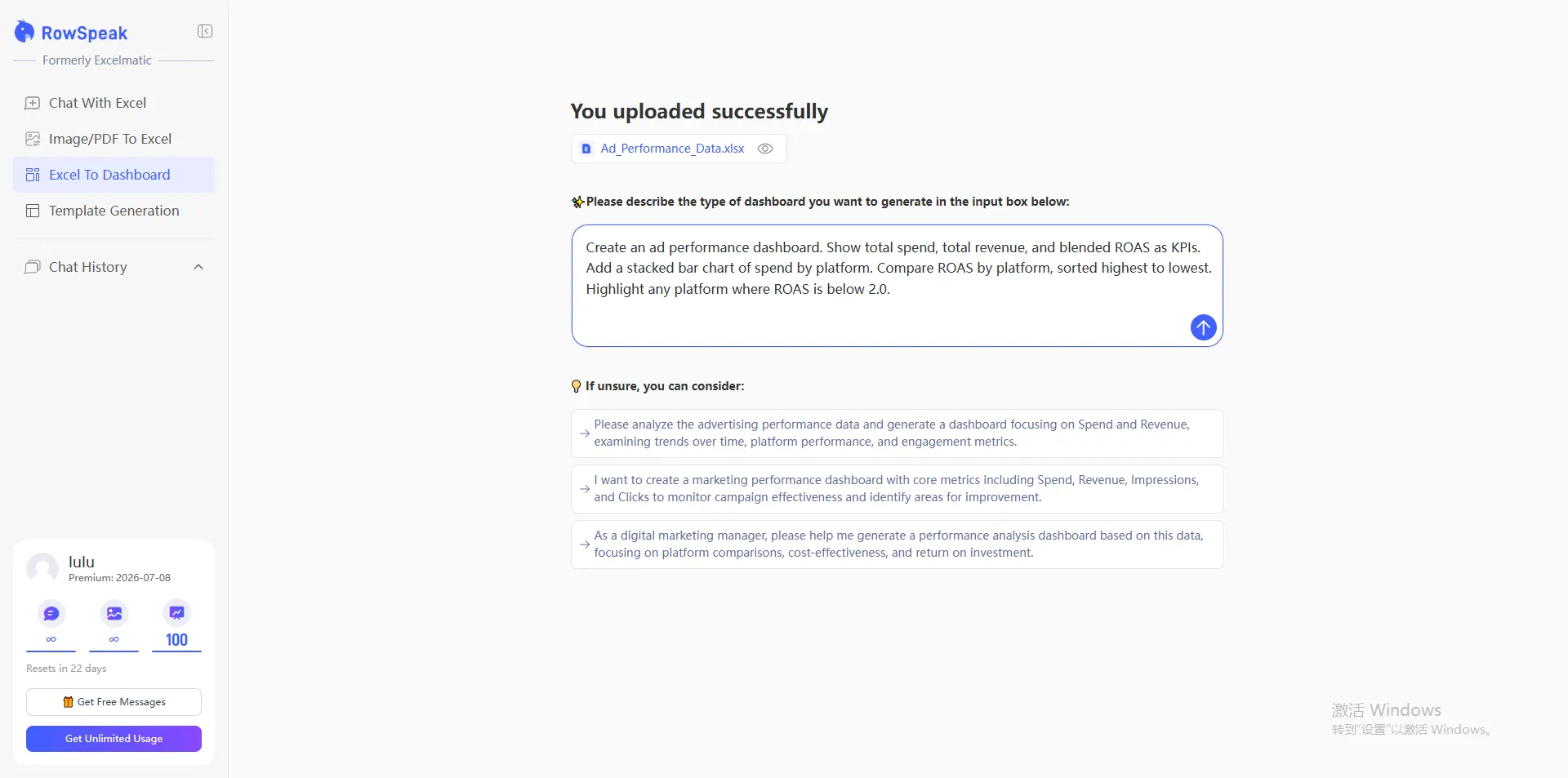

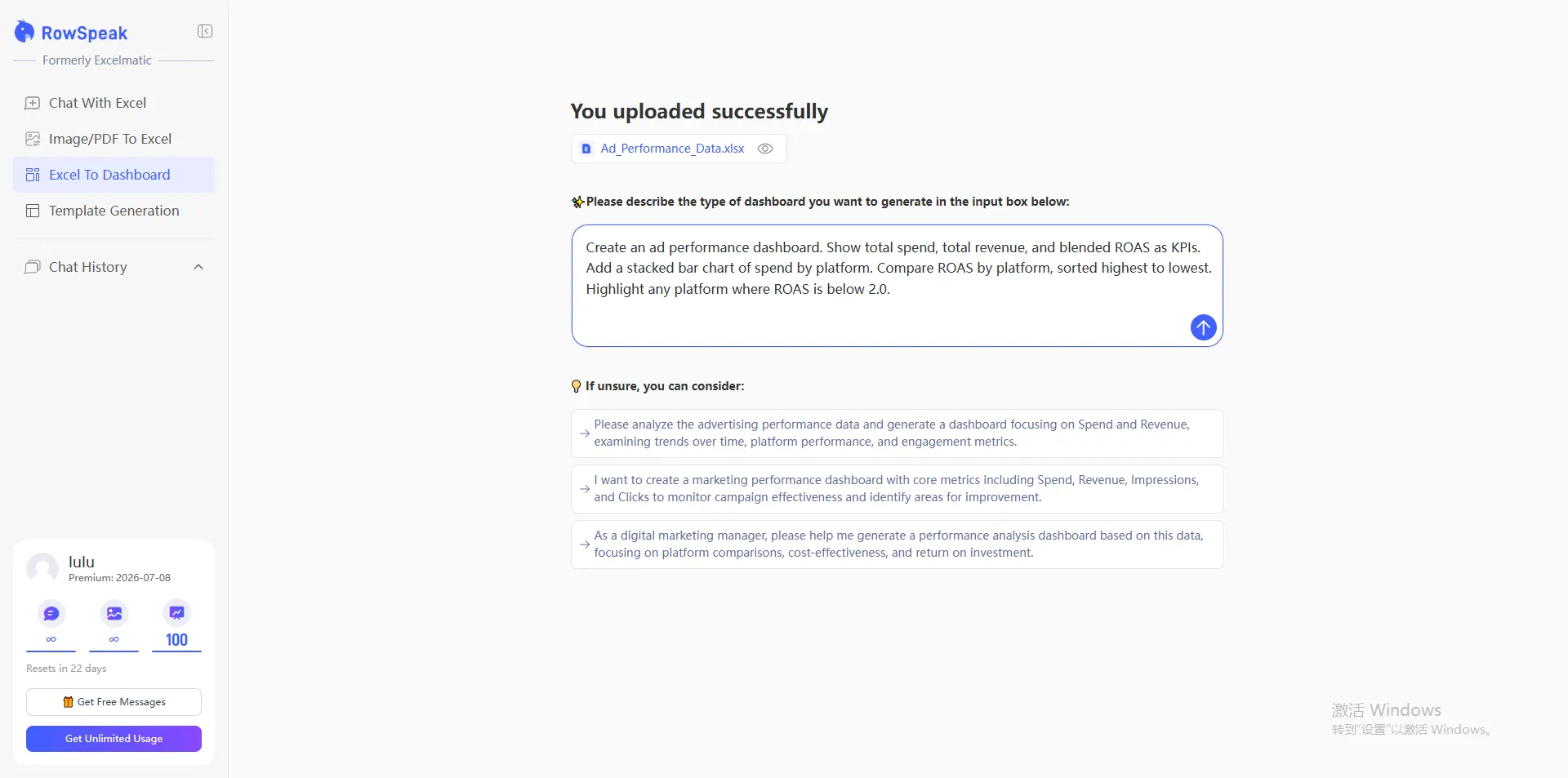

RowSpeak 的定位

一旦私有模型端點運作正常,RowSpeak 就成為讓整個系統對實際團隊可用的關鍵層。

RowSpeak 不要求用戶思考原始的推論請求,而是圍繞文件和試算表分析任務為他們提供工作流。

這意味著他們可以:

- 上傳試算表

- 用自然語言提出分析問題

- 生成摘要

- 創建圖表導向的輸出

- 更自然地處理複雜的業務數據

這是整篇文章中最重要的框架:

價值不在於「與 CSV 聊天」。

價值在於獲取雜亂的內部試算表數據,透過你控制的私有 AI 伺服器進行處理,並將結果轉化為人們在 AI 生成報告、決策支援和內部工作流中真正能使用的產出。

![]()

最終驗證:什麼才是真正重要的

在宣佈部署完成之前,請檢查真實內部推廣中真正重要的事項:

- 端點在重複請求下是否保持穩定?

- 延遲對於真實內部使用是否可以接受?

- 應用程式中的模型名稱配置是否正確?

- 網路規則和訪問控制是否正確?

- 分析和圖表輸出在真實的試算表任務中是否真的有用?

最後一點是人們最常忽略的。

私有 AI 部署的成功不僅僅在於伺服器正在運行。只有當內部用戶可以依賴它進行真實的試算表工作,且無需將敏感數據傳送到環境之外時,它才算成功。

![]()

最短行動建議

DeepSeek-V4-Flash 現已正式發布、公開且提供開放權重。如果你想運行私有 AI 進行內部試算表分析,最清晰的路徑是先在自己的 GPU 伺服器上使用 vLLM(或在合適的情況下使用 Ollama)進行部署,使用業務風格的提示詞驗證 API,然後在上方連接像 RowSpeak 這樣的工作流層。

接著,在你的環境變數中設置 orchestrator_model=deepseek-v4-flash,你就可以使用 RowSpeak 進行內部數據分析和圖表生成,而無需將工作傳送到公共模型 API。

常見問題

DeepSeek-V4-Flash 適合私有 AI 部署嗎?

是的——如果你的目標是在自己的環境中運行一個能力強大的模型,用於試算表分析、報告支援或營運工作流等內部場景。團隊選擇 DeepSeek-V4-Flash 的主要原因在於,它提供了一個更強大的模型選項,而無需強迫敏感的內部數據流經公共模型 API。

我應該使用 vLLM 還是 Ollama 進行內部部署?

如果你想要一個生產級別的內部 AI 伺服器,請從 vLLM 開始。如果你想要更快的原型驗證或更簡單的本地部署路徑,Ollama 會是一個不錯的選擇。在實踐中,許多團隊使用 Ollama 進行探索,並使用 vLLM 進行正式營運。

在宣佈部署成功之前,我應該測試什麼?

不要止步於「伺服器有回應」。測試端點是否穩定、延遲是否可接受、訪問控制是否正確,以及輸出結果對於財務、營運或報告團隊的真實試算表分析任務是否真的有用。

這真的是關於試算表分析,還是只是通用聊天?

對於大多數企業買家來說,價值不在於通用聊天。價值在於使用私有 AI 伺服器協助內部團隊處理試算表、CSV 導出、報告和其他結構化業務數據,而不會將這些工作暴露在公司環境之外。

RowSpeak 在這個架構中扮演什麼角色?

RowSpeak 是位於私有模型端點之上的工作流層。它不要求用戶與原始模型 API 互動,而是為他們提供一個專注於試算表的介面,用於上傳、提問、摘要和圖表輸出。

您的團隊需要私有部署嗎?

如果你想在不將敏感數據傳送到公共模型 API 的情況下,為內部試算表分析運行 AI,RowSpeak 可以協助你將自託管模型轉化為可用的內部工作流。

典型的企業設置可以包括:

- 私有或地端(on-prem)部署選項

- 連接到你自己的模型端點

- 專注於試算表的分析工作流

- 支援財務、營運和報告團隊

- 符合內部數據安全要求的控制措施

如果你正在評估私有 AI 的落地並希望找到一條可行的路徑——而不僅僅是模型演示——請聯繫 RowSpeak 討論你的使用場景。